當 ChatGPT 廣告 正式出現在對話介面裡,生成式 AI 的商業模式也邁入了全新的階段。對使用者、品牌與整體數位廣告產業而言,這不只是介面多了一塊「贊助內容」,而是關於信任、隱私與權力分配的大型實驗。

ChatGPT 廣告是怎麼推出的?

目前廣告首先鎖定美國的免費方案與低價訂閱層級,較高階的付費方案則暫時不顯示廣告,形成「付費免廣告、免費看廣告」的典型分層模式。

平台同時宣稱幾個關鍵原則:

- 廣告不會影響 ChatGPT 回答內容

- 廣告會被清楚標示為「贊助」或類似標記

- 廣告與「自然回答」在版面上有視覺區隔

- 廣告主只會看到彙總的成效數據,而非個別對話內容

這些設計,目的在降低「演算法被廣告商買走」的疑慮,維持 ChatGPT 作為問答工具的基本信任。

為什麼 ChatGPT 需要廣告?

生成式 AI 的營運成本非常高:模型訓練需要大量算力,日常推論同樣燒錢。單靠訂閱與企業合約,短期內很難完全消化成本。

在此情況下,導入 ChatGPT 廣告有幾個明顯理由:

- 補貼免費用戶成本:讓免費或低價方案得以持續存在

- 分散營收來源:避免過度依賴單一企業大客戶

- 向廣告市場要預算:傳統搜尋與社群廣告預算龐大,AI 對話廣告是一塊全新的戰場

站在營運角度,這個選擇幾乎是必然;真正的問題在於:廣告進來之後,體驗與信任會不會被稀釋。

使用者最擔心什麼?信任與干擾

當「回答問題」與「投放廣告」同時發生,風險自然隨之而來,特別是對 ChatGPT 廣告 的以下三點擔憂最強烈:

1. 回答是否會被廣告利益扭曲?

- 推薦產品時,模型會不會偏向出價較高的廣告主?

- 在多種解法中,是否優先引導到能下廣告的解決方案?

即便平台宣稱「廣告不影響回答」,只要缺乏透明機制與外部審查,疑慮就很難完全消失。

2. 對話流暢度被打斷

與搜尋引擎不同,對話式介面強調的是「沉浸感」與「連貫性」。若 ChatGPT 廣告插入方式過於突兀,將讓使用者覺得:

- 注意力被強行切走

- 對話轉為「半服務、半推銷」

- 長時間使用的意願下降

3. 個人化=被追蹤?

AI 廣告若是依照對話內容、過往互動來「個人化」,難免讓人聯想到被全程監控。

即使平台保證不會把對話內容提供給廣告主,多數人仍會懷疑:

「那麼,用來訓練模型的資料、用來算廣告匹配的訊號,到底有多『匿名』?」

ChatGPT 廣告目前的設計細節

從已公開資訊來看,目前的 ChatGPT 廣告 策略大致包含幾個設計方向:

1. 以對話主題為基礎的情境匹配

例如:

- 使用者詢問烹飪與菜單,可能出現食材宅配或料理包廣告

- 問職涯與技能學習,可能出現線上課程或工具軟體廣告

這種「意圖導向」的廣告,比傳統只看年齡、地區的投放更精準,也更容易被接受——前提是標示清楚、不中斷主要回答。

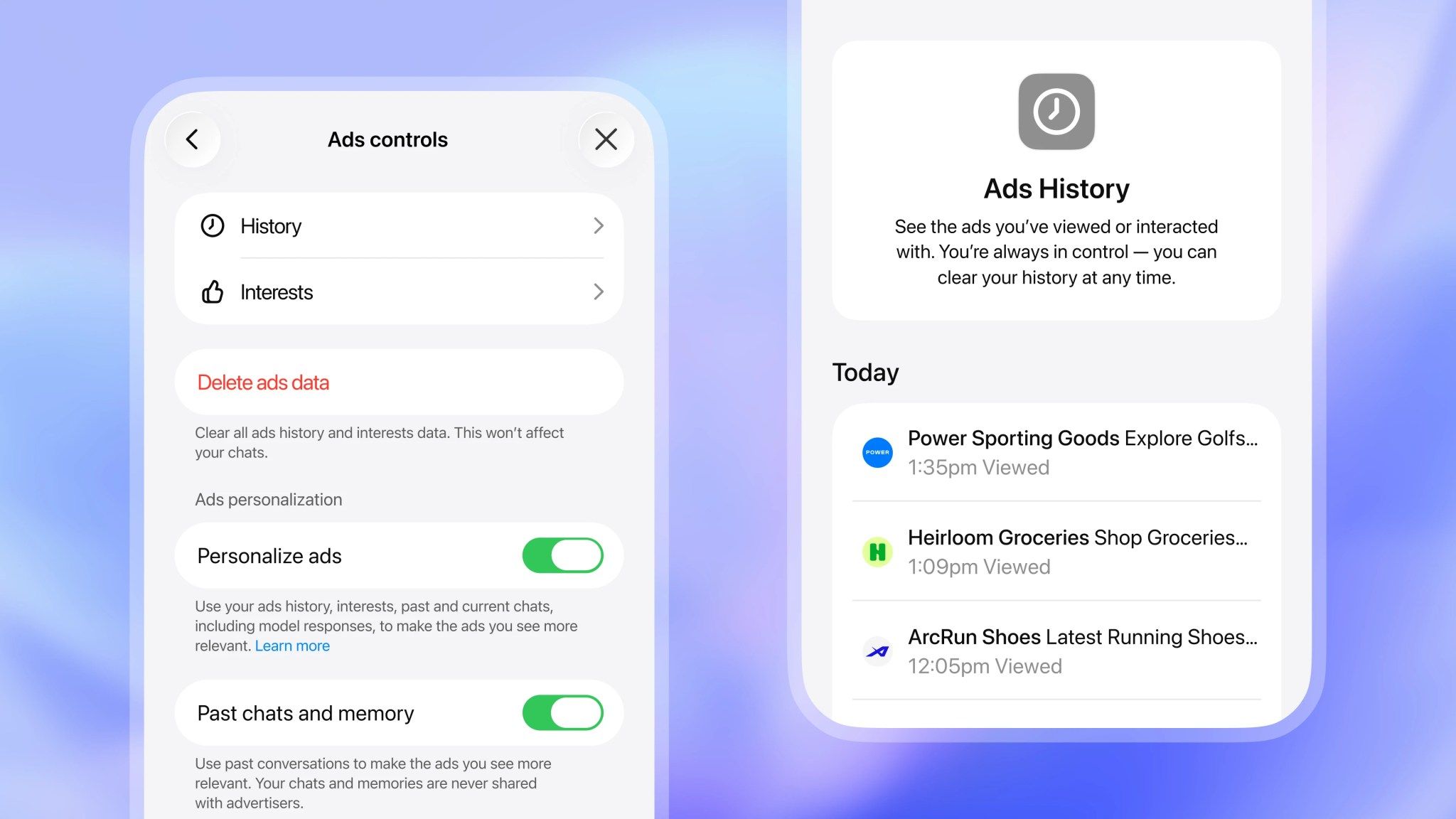

2. 使用者控制權:關閉、檢視、清除

平台聲稱會提供一套完整的控制面板,包含:

- 檢視曾互動過的廣告紀錄

- 清除廣告個人化紀錄

- 調整個人化程度甚至關閉特定類型的廣告

- 對單一廣告給予負評或檢舉

若這些控制真實且易用,能實際降低部分隱私與干擾疑慮。

3. 對未成年與敏感議題的保護

廣告不會對 18 歲以下使用者顯示,也不會貼近健康、心理健康、政治等敏感主題。

這不只是道德考量,同時也是在為未來更嚴格的 AI 與廣告監管預先鋪路。

競爭者已經開打「廣告話語戰」

有趣的是,ChatGPT 廣告 還沒全面鋪開,競爭對手已經率先在品牌戰中下重手。對手以電視廣告和行銷內容嘲諷「在 AI 對話中塞廣告」會破壞體驗,暗示自己走的是「更純粹、更不被商業綁架」的路線。

這種公關戰有兩個效果:

- 提前在大眾心中種下「AI+廣告=有問題」的印象

- 迫使領先者在廣告體驗與透明度上必須更謹慎

換句話說,ChatGPT 廣告 不僅是商業策略,更是整個 AI 品牌戰的一部分。

對廣告主與行銷人的新戰場

從行銷角度來看,ChatGPT 廣告 其實極具吸引力,甚至可能是下一個高成長通路:

- 高意圖情境:使用者主動尋找解決方案,比滑社群時被動看到廣告更接近「要下決定的那一刻」。

- 對話式互動:未來不排除出現「點擊廣告後,接續在同一個聊天裡進行諮詢、試用或導購」,縮短轉換流程。

- 內容深度結合:如果設計得好,廣告可以是補充資訊,而不是單純的橫幅或貼片。

但要注意的是,這種威力越大,對倫理與合規的要求就越高。例如:

- 能不能在心理壓力大、情緒脆弱的對話中推銷商品?

- 能不能根據使用者的弱點(例如財務焦慮)設計極具說服力的廣告話術?

如果產業沒有自律,很可能換來更嚴格的監管與公眾反彈。

AI 廣告需要新一代「使用者保護標準」

傳統網路廣告的規範(如標示贊助、禁止特定類型投放)已不足以完全涵蓋生成式 AI 的情境。對於 ChatGPT 廣告,我認為至少需要出現以下幾個新標準:

1. 模型獨立性審查

- 建立第三方機制,定期檢測在有/無廣告出價的情況下,模型回答是否有統計上顯著偏移。

- 一旦發現偏移,需公開修正方案與時間表。

2. 對話脈絡敏感度限制

- 當系統偵測到使用者處於心理危機、重大健康議題、法律糾紛等情境時,應自動關閉所有商業廣告。

- 對於未成年人對話,應採預設最保守模式。

3. 使用者透明儀表板

不只是簡單的「廣告偏好」,而是:

- 讓使用者看到系統是「基於哪些訊號」判斷並投放某則廣告

- 清楚說明這些訊號是否會被用於模型訓練

- 提供一鍵下載與刪除所有廣告相關資料的能力

這樣的透明度,才有可能重新建立對 AI 廣告的信任。

結論:在效率與信任之間畫出清楚邊界

ChatGPT 廣告 的出現,幾乎可以被視為生成式 AI 商業化的分水嶺:

- 對平台來說,它是彌補龐大成本、擴大普及的必要手段;

- 對廣告主來說,它是高意圖、高轉換的新通路;

- 對使用者來說,它可能是體驗被稀釋的開始,也可能是更精準、更有用的資訊入口。

關鍵不在於「要不要廣告」,而在於「怎麼做廣告」:

- 有沒有堅守回答的中立與獨立?

- 有沒有給使用者足夠的知情權與選擇權?

- 有沒有對未成年與弱勢族群提供額外保護?

- 有沒有建立可以被外部檢驗的透明機制?

接下來數年,ChatGPT 廣告 將會不斷調整與擴張。身為使用者,你可以主動檢查與調整個人廣告設定,學會辨識贊助與自然內容的差異;身為品牌與行銷人,你可以選擇走向負責任的 AI 廣告實踐,而不是只追求短期轉換;而監管機構與產業組織,也應儘早制定針對 AI 對話廣告的新規範。

如果我們能在效率與信任之間畫出清楚邊界,AI 對話廣告未必是壞消息,反而可能讓更多人以更可負擔的方式接觸到強大的生成式 AI 工具。

#ChatGPT廣告 #生成式AI #AI行銷 #數位廣告 #隱私保護

追蹤以下平台,獲得最新AI資訊:

Facebook: https://www.facebook.com/drjackeiwong/

Instagram: https://www.instagram.com/drjackeiwong/

Threads: https://www.threads.net/@drjackeiwong/

YouTube: https://www.youtube.com/@drjackeiwong/

Website: https://drjackeiwong.com/

![[AI學堂] HeyGen AI 三大更新實測:Sora 2 直連生成、Video Agent、UGC 廣告+Lip-Sync 翻譯(2025)](https://drjackeiwong.com/wp-content/uploads/2025/10/20251014-YT-2.jpg)