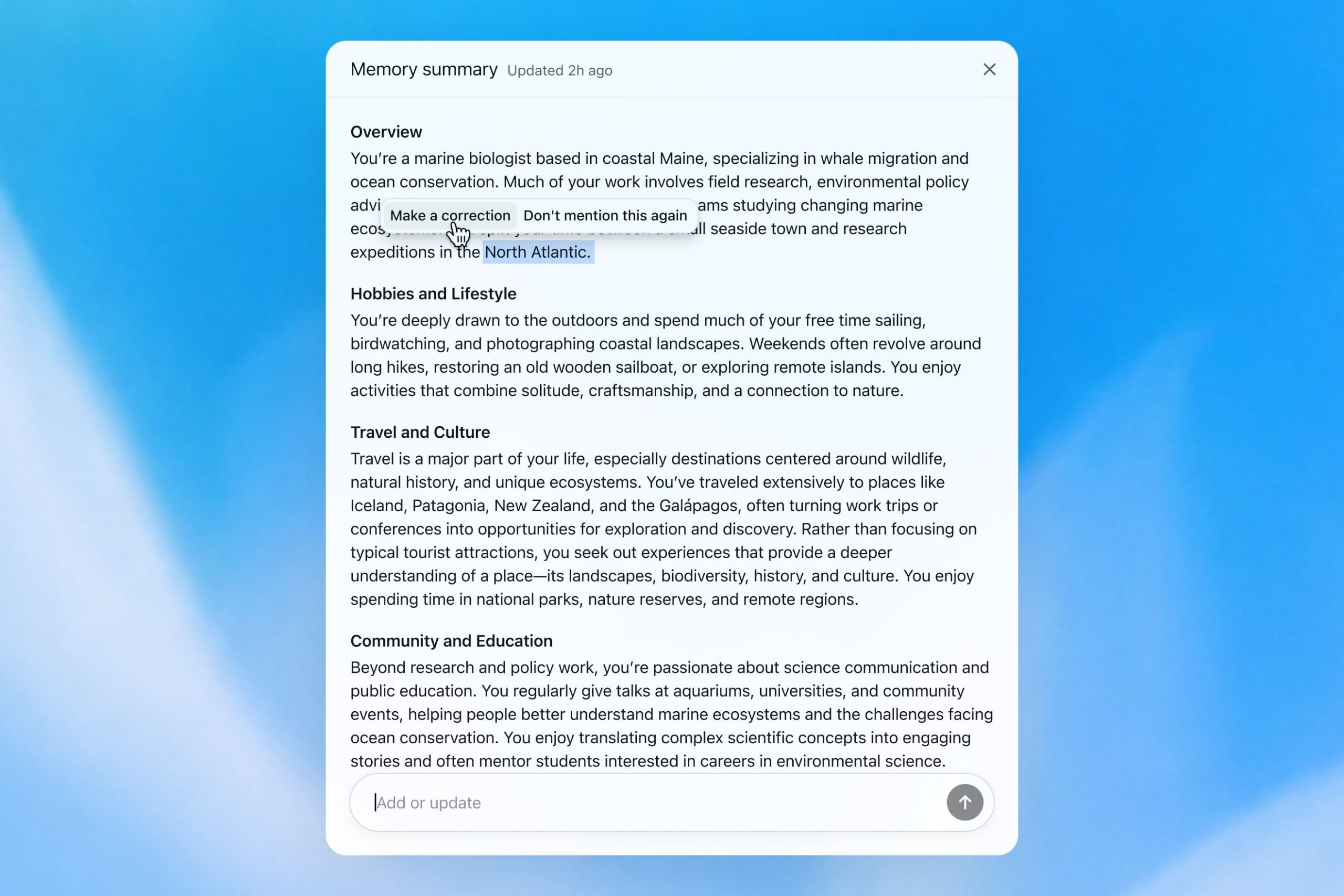

OpenAI 最近推出了 ChatGPT 記憶功能的最新版本——Dreaming V3。這不是一次小修小補,而是從根本上改變了 AI 如何「記住」你。過去我們習慣手動告訴 ChatGPT 自己的偏好、語氣或常用格式,但 Dreaming V3 的主打亮點,就是讓這一切變成自動化。 簡單講,Dreaming V3 的核心能力,是它會在你與 ChatGPT 的對話過程中,主動觀察你的表達習慣、重複出現的需求,甚至是你對特定主題的偏好,然後自動把它們整理成偏好的記憶條目。換句話說,你不用再像以前那樣,三不五時就提醒 ChatGPT「請用繁體中文回答」、「請用條列式回覆」,因為它自己會學起來。 這次更新最值得注意的 2 個升級點 1. 偏好自動化提取,不用再手動設定 這是最有感的改變。以前...

DeepSeek 官方正式確認,旗艦 API 模型 DeepSeek V4-Pro 將在目前促銷期結束後,永久降價 75%。這個幅度不只是短期優惠,而是價格結構的根本性改變。對許多依賴 API 的開發者、新創團隊,甚至是正在評估模型成本的中大型企業來說,這都意味著一件事:過去因為價格而卻步的高階模型,現在已經進入可以長期使用的價格帶。 降價 75% 到底代表什麼? 先拆解數字本身。DeepSeek V4-Pro 原本的 API 定價,在同級旗艦模型中屬於中高水位,主要競爭對手包括 GPT-4o 與 Claude 3.5 Sonnet 等。降價...

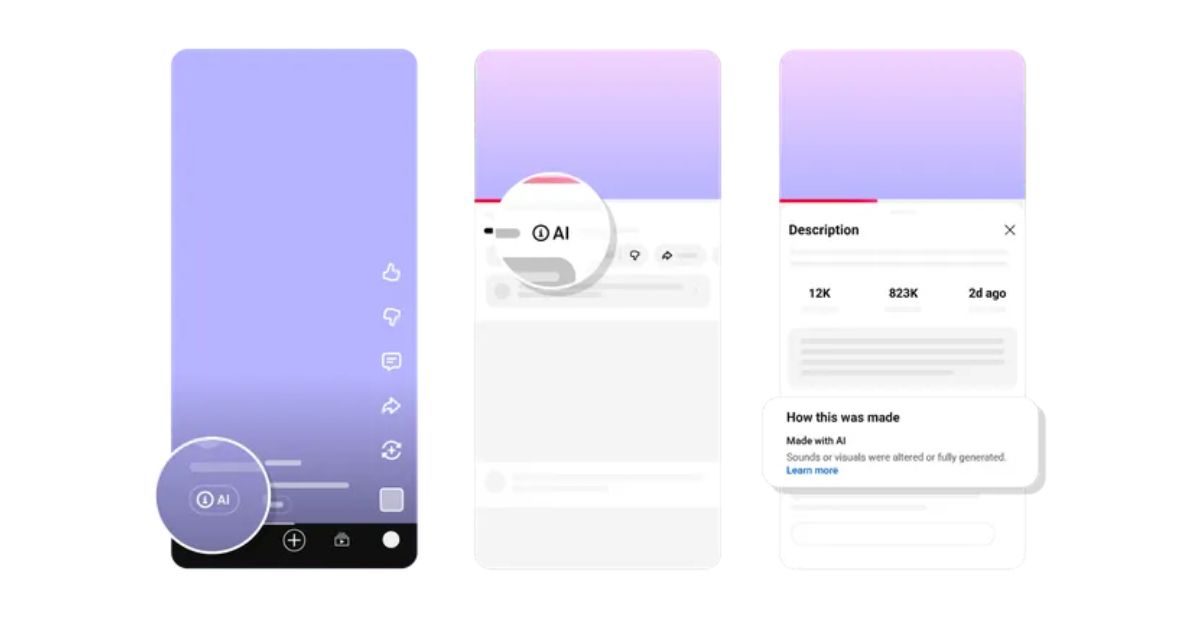

YouTube 在 2026 年 5 月底宣布了一項重大更新:AI 內容偵測機制正式上線,並伴隨更醒目的標籤系統。這不是一個「建議遵守」的指引,而是平台層級的主動偵測加上強制標示。對創作者而言,這意味著過去靠自我宣告的時代已經結束;對觀眾來說,未來看到影片時,平台會直接告訴你這段內容是否由 AI 生成或輔助完成。這項政策的核心,並非打壓 AI 工具的使用,而是讓「誰做了什麼」這件事,變得無法迴避。 這次更新到底改了什麼? 過去 YouTube 要求創作者在後台上傳影片時,主動標示是否包含「經修改的真實內容」或「完全由 AI 生成的內容」。但實際情況是,許多人選擇不標示,或者根本搞不清楚哪些情況需要標示。新的機制有兩個關鍵變化: 自動偵測取代純自願申報:YouTube 開始利用內部模型掃描上傳的影片,若偵測到高度疑似 AI 生成的片段(例如語音合成、臉部置換、純生成畫面),系統會主動標記,並要求創作者在發佈前確認。 標籤更醒目、直接:過去小小的「Altered or synthetic...

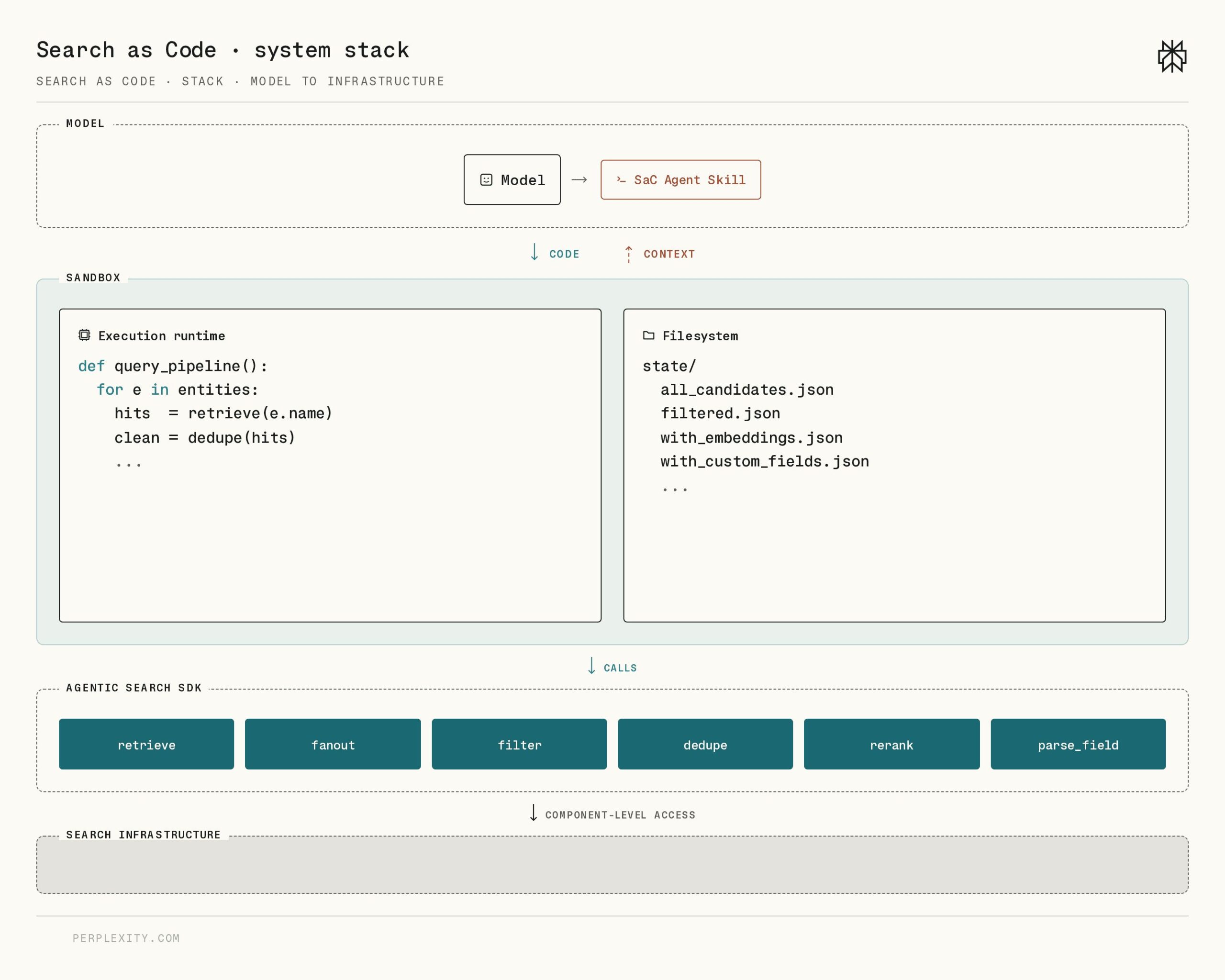

搜尋引擎與 AI 的整合,這幾年一直在玩同一件事:把自然語言問題拆解成多輪 tool calling,再串回答案。Perplexity 最近推出的 Search as Code,直接把這個過程砍掉重練——它不再讓 AI 一輪一輪去問工具,而是直接產生一段 Python pipeline code,一次搞定搜尋、過濾、摘要、分析,然後才回答。這不是一個小更新,而是把搜尋從「對話式」推向「程式化」的關鍵一步。 Search as Code 到底改了什麼 傳統的做法是:你問一個問題,AI 先判斷要呼叫哪個搜尋 API,得到結果後再決定要不要再問一次,不斷來回。這種 multi-turn tool calling...

Microsoft 最近低調發布了一款名為 Scout 的個人助理,這個名字你可能還不熟悉,但它很可能代表著 Microsoft 在 AI 助理領域一次重要的路線調整。Scout 並不是那種什麼都能做的通用型大模型,而是一款從設計之初就向經典工具 OpenClaw 致敬的產品。這裡說的「致敬」不是視覺風格的模仿,而是它的核心邏輯:精準、專注、以任務為中心,並且強調與使用者建立的是一對一的信任關係,而不是一個什麼都想插一腳的萬能服務檯。 這次 Scout 到底新在哪裡? Scout 最大的亮點不是它的對話能力有多強,而是它的操作模式徹底改變了。它不再像 Copilot 那樣嵌入在 Sidebar 裡等待指令,而是以一個獨立存在、隨時待命但不過度干擾的姿態出現。具體來說,有幾個最值得注意的升級點: 第一,行為學習機制。Scout 會記錄你在特定場景下的重複性操作,例如你每週一早上固定會打開 Outlook、檢查 Calendar、然後在...

OpenAI 近日為 Codex 加入三項重要更新:辦公室工作專用外掛、Sites 功能、以及支援所有文件的 Annotations。這代表 Codex 正式從「程式開發助理」跨入「辦公室生產力工具」領域。本文將深入分析這三項功能到底帶來了什麼改變,以及它們對實際工作流程的具體影響。 這次 Codex 到底更新了什麼? 過去 Codex 被定位為 AI 程式設計助手,主要協助開發者補齊程式碼、除錯或轉換語言。然而,這次的三項更新徹底改變了這個角色定位。 首先,辦公室工作專用外掛讓 Codex 可以直接與常見的企業協作工具(如 Slack、Trello、Notion 等)整合。意思是,你不用再手動將 AI 的輸出複製貼到這些平台,而是可以直接在 Codex...

Gemini / Google Slides AI 開始支援一鍵美化 PPT、生成 infographic 及 cover slide。今次我用一份普通 AI 培訓 proposal 草稿做實測,看看它能否將 bullet points、raw data 和 timeline 變成更專業的簡報視覺,同時觀察它在中文字、可編輯性與資料準確性上的限制。

如果一直有在關注 AI 代理工具的發展,應該會記得 OpenAI 的 Codex 在去年展示過一項讓人印象深刻的 Computer Use 功能——它能直接操控桌面應用程式,像是人類一樣點擊按鈕、填寫表單、切換視窗。只是這個功能一直只限 macOS 版本使用,Windows 用戶只能乾瞪眼。現在這道牆終於打破了,Windows 版 Codex 正式開放 Computer Use,而且不只是單純移植,還帶了幾項值得注意的改進。 本文不會從 AI 代理的歷史開始講起,也不會花篇幅討論企業 IT 治理策略。我們直接把焦點放在:這次 Windows...

如果你最近在 Threads 上滑文,可能已經注意到有人開始在貼文或回覆中「呼叫」一個叫 @meta.ai 的帳號。這不是什麼新的迷因帳號,而是 Meta 正式在 Threads 測試的 AI 互動功能。簡單來說,你只要在串文中輸入 @meta.ai 並加上問題,它就會直接在回覆中生成背景脈絡、新聞懶人包或內容推薦。這件事看起來只是多了一個標記功能,但實際上,它代表 Meta 正嘗試把 AI 由「工具」變成「社交平台的原生一部分」。 這篇文章不會跟你談什麼 AI 倫理、資料治理那些宏觀大道理。我們要聚焦的是:這個功能實際上做了什麼、它與過去我們在社群平台使用 AI 的體驗有什麼不同,以及這對一般 Threads 用戶來說,到底值不值得馬上試用。這才是你現在最該關心的切入點。...

OpenAI 奧特曼認錯:AI 不會消滅白領工作,我當初的預測錯在哪裡 OpenAI 執行長 Sam Altman 最近在公開場合做了一個值得記下來的表態。他承認自己幾年前對 AI 衝擊就業的判斷出錯了,當初他公開講過「AI 會先消滅入門白領工作」,但至今這個場景並沒有發生。他修正後的觀點是:AI 不對造成什麼就業末日,真正的影響不是取代人,而是改變工作的形態和分配方式。 這件事之所以值得重視,不是因為一個科技大佬出來認錯很稀奇,而是他的修正方向,恰好點破了目前市場上普遍存在的誤解。如果你一直在擔心 AI 會讓你失業,或正在因為這個焦慮而亂學一堆工具,這篇文章可以幫你重新看清楚真正該關注的重點在哪裡。 當初的預測為什麼錯了 Altman 當初的邏輯其實很直覺:AI 擅長處理重複性、結構化的文字與資料任務,而白領入門級工作的核心就是這類任務——整理報表、回覆郵件、生成標準文件、做基本分析。所以他推論,這些職位會最先被取代。 但他忽略了一件事:企業實際運作中,「入門白領工作」從來不只是任務的總和。新手之所以有價值,不是因為他能做那幾件雜事,而是因為他能在做雜事的過程中理解公司流程、建立人際網絡、累積判斷直覺。AI 可以取代「做那件事」的動作,但它無法取代「透過做那件事來理解組織」的過程。 換句話說,企業真正需要的不是把任務完成,而是讓一個人用這些任務作為媒介,逐漸長成一個能獨立判斷的員工。AI 可以加快任務完成的速度,但它沒辦法加速一個人的成長路徑。 AI...

當團隊決定「從 ChatGPT 轉向 Claude」,真正的工作往往不是註冊新帳號,而是把既有的知識、流程、權限、提示詞、整合工具與風險控管一起搬過去,並確保產出品質不掉、合規不破、成本不失控。 很多公司會在兩種情境下啟動遷移:一是更重視文字一致性、長文件理解與輸出風格控制;二是法務/資安要求更嚴,必須把資料流、使用規範與可追溯性做得更完整。不論你屬於哪一種,以下提供一套可落地的「從 ChatGPT 轉向 Claude」遷移流程、風險管理與應用策略。 先釐清:你要遷移的是「模型」還是「工作系統」? 遷移前先把目標講清楚,避免最後變成情緒化的工具更換。 個人使用者:重點通常是寫作/摘要品質、長文處理、語氣穩定、以及日常工作效率。 團隊/企業:重點會變成權限控管、資料外流風險、審計需求、與既有系統(文件、客服、工單、CRM、內部知識庫)的整合成本。 產品/工程團隊(API):重點是可預測性(輸出穩定度)、延遲、成本、速率限制、以及模型版本策略。 把遷移定義成「工作系統」會更務實:提示詞只是冰山一角,更關鍵的是你怎麼評估品質、怎麼控管資料、怎麼讓使用者習慣改變。 盤點差異:ChatGPT 與 Claude 可能影響你的三件事 你不需要比規格表,但要知道差異會落在「流程」哪一段。 長文件與脈絡維持:若你大量處理會議逐字稿、長篇報告、合約、研究資料,Claude 的長脈絡能力常被拿來當遷移理由。但你仍需要測試:同一份文件在不同切分方式下,結論是否一致。 工具與工作流整合方式:你若高度依賴某些既有外掛、特定平台內建功能、或特定 API 介面(例如工具呼叫、結構化輸出),遷移不是「換模型」而是「重做連接點」。...

一項由北京大學等機構進行的研究測試了七大頂尖 AI 模型在學術誠信上的表現,結果出乎意料:這些被認為聰明絕頂的模型,在面對學術相關問題時,出現錯誤或誤導性回答的比例超過三成。這個數字的意義不在於 AI「會出錯」——這大家都知道——而在於出錯的類型與場景,直接衝擊到學術研究與高等教育中最基本的信任環節。 不是簡單的答錯,而是帶有包裝的錯誤 大部分人對 AI 出錯的印象停留在「胡亂編造答案」或「一本正經說瞎話」。但這份研究顯示的情況更棘手:受測模型在面對學術題目時,並非直接給出明顯荒謬的答案,而是用嚴謹的語氣、完整的段落、甚至引用虛構的文獻,來包裝一個錯誤的結論。 這種有說服力的錯誤,比明顯的錯誤更危險。 以一個實際測試情境為例:當研究者詢問「某個統計方法在樣本數小於 30 時應如何修正」,幾個主流模型給出了看似專業的操作步驟,但裡面混入了早已被學界淘汰的建議。對不熟悉該領域的使用者來說,這些步驟看起來完全合理,一不小心就會被帶入錯誤的分析方向。 哪些場景最容易踩雷 這項測試針對的是學術場景,而非一般日常問答。測試範圍包括文獻引用的真實性、研究方法的合理性、數據解讀的邏輯、以及學術倫理判斷等。七個受測模型在這些題目上整體出錯率超過 30%,而且有幾個特定類型的題目,錯誤率甚至逼近五成。 第一類高錯誤率題目:虛構文獻。當研究者要求模型提供「支持某些論點的最新研究」,模型經常編造出聽起來很合理但實際上根本不存在的論文,包括偽造的作者姓名、期刊名稱與發表年份。這對剛入門的研究生尤其危險,他們可能直接拿這些假文獻來支撐自己的研究背景,釀成無心之過。 第二類高錯誤率題目:跨領域的類比推導。模型擅長在單一領域內操作,一旦題目需要結合兩個以上領域的知識,出錯率明顯飆升。例如將生物統計的方法直接套用到社會科學數據時,模型往往忽略不同領域的基本假設差異,給出看似通用、實則謬誤的建議。 為什麼超過三成這個數字值得警惕 三成的出錯率,意味著你每問三個學術相關問題,就很可能得到一個有問題的答案。對一個正在寫文獻回顧的研究者來說,這個風險不是能不能接受的問題,而是完全不應該存在的。學術界賴以運作的根基,是引用可驗證、結論可複現。如果 AI 模型輸出的內容無法確保基本正確性,它就無法成為可靠的學術助手,反而會淪為造假加速器。 這也帶出一個更根本的問題:目前的 AI 模型在訓練階段,對於「正確性」的優化權重,遠遠低於對於「流暢度」與「合理性」的優化。模型被訓練成一個擅長講話的人,而不是一個擅長核實的人。這在寫詩或生成廣告文案時沒有問題,但在學術領域,這就是結構性的缺陷。...