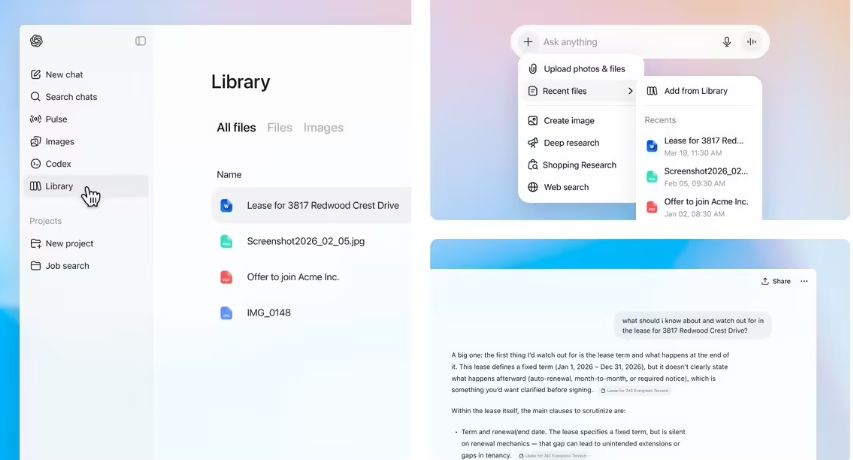

ChatGPT 近期推出「圖庫」雲端功能,主打自動保存你在對話中產生或上傳的檔案與影像,並且能在不同對話間快速調用。這看似只是「多一個存檔位置」,但對內容產製、設計協作、行銷素材管理與知識工作者的日常流程,影響其實很直接:你不再需要回去翻舊對話找附件,也更容易把 ChatGPT 變成一個可持續累積的「素材工作台」。 「圖庫」到底解決了什麼痛點? 以往使用 ChatGPT 做內容或設計輔助,常見情境是: 你在某次對話中產出圖片、簡報、表格或草稿,隔天要再用卻找不到原本那段對話 同一份素材要在不同任務中重複上傳(耗時、版本容易亂) 團隊內部要對齊「這張圖是最新版嗎?」常常靠人工命名或丟到另一個雲端硬碟才安心 「圖庫」把這些問題收斂成一件事:把對話內的檔案與影像從『一次性附件』,提升為『可重複使用的資產』。當你能跨對話即時調用素材,很多工作就會從「每次重做」變成「持續迭代」。 內容行銷與品牌團隊:素材迭代速度會明顯變快 對內容行銷來說,最常被浪費時間的不是寫,而是「找」。例如: 文章用的主視覺、資訊圖表、短影音封面圖 不同渠道需要的尺寸版本(1:1、4:5、16:9) 同一組活動的 EDM 圖檔、Banner、社群貼文視覺 有了圖庫後,你可以在新對話直接叫出先前用過的視覺,請 ChatGPT: 依不同渠道快速改尺寸與版面(並保留一致的品牌元素) 針對同一張圖產出多版本文案與 CTA,做...

OpenAI 宣布關閉 Sora(其文字生成影片能力的代表性產品/研究方向),對內容創作圈與 AI 影音工具鏈是一個明顯訊號:生成式影片不只拚技術突破,更同時受制於成本、版權、濫用風險與商業模式的現實拉扯。 以下以「你可能已經用過、正在評估導入、或只是關注趨勢」三種角度,拆解這件事的意義與接下來該做的準備。 Sora 曾被期待解決什麼問題? 生成式影片的痛點不在「能不能做出畫面」,而在「能不能穩定、可控、可交付」。Sora 之所以引起關注,核心是它承諾把文字指令轉成更長、更一致的影片,並在鏡頭語言、物件一致性、運鏡與情境連貫上往「可用於商業流程」推進。 對行銷與內容團隊來說,這類工具常見期待包括: 快速產出分鏡概念與提案影片:在前期就把想法視覺化,縮短溝通成本。 大量版本測試:同一個腳本快速生成多版本素材,做 A/B 測試或在不同平台投放。 降低外包與拍攝門檻:把一部分成本從拍攝、棚拍、場地轉移到後製與合規。 當這樣的「可交付」期待被按下暫停鍵,影響的不只是單一產品,而是整個工作流程的規劃方式。 為什麼會關閉?從產業常見因素推測 官方公告通常會給出方向性理由,但外界更關心的是:這是短期調整,還是策略轉向?在不假設細節的前提下,生成式影片產品被關閉常見原因大致落在四類: 運算成本與延遲壓力 影片生成比圖像更吃算力與時間,若要做到可商用的穩定性,成本可能難以用現有訂閱或授權模式回收。 安全與濫用風險門檻更高 影片更容易被用於仿冒、造假、誤導式剪輯。即使有浮水印、內容審核、身份驗證,仍可能難以滿足監管與平台規範的要求。 版權與資料來源爭議...

Gemini 在香港「全面開放」的意義,不只是多了一個 AI 聊天工具可用,而是 Google 把 Gemini 的核心體驗(多模態理解、與 Google 服務的整合、以及進階方案)更完整地帶到本地市場。對香港讀者而言,最直接的改變是:更容易以日常帳戶直接使用、以繁體中文完成工作流程,並在學習、辦公、內容創作與開發上,有更低門檻的 AI 助手可選。 以下用一篇懶人包,帶你由「怎樣開通」到「怎樣用得值」,同時把常見限制與風險講清楚。 香港用戶現在能用到哪些 Gemini 形式? 一般用戶在香港最常接觸的 Gemini 入口,大致分成三類: Gemini 網頁版:適合快速問答、寫作、摘要、翻譯、整理資料。 手機 App(Android /...

生成式 AI 不只是多了一個「更會寫作的工具」,而是把「如何學習、如何工作、如何被評估」整套規則都推進重算。對正處在升學、實習、第一份工作交界的 Z 世代而言,這波改變帶來明顯的兩面性:一邊是效率與門檻下降的機會,另一邊是能力被稀釋、被取代或被誤解的焦慮。 Z 世代為何特別「有感」? Z 世代多半在數位環境中長大,對工具更新的接受度高,也更習慣用搜尋、社群與短內容快速補洞。但生成式 AI 讓「取得答案」變得太容易,學校與公司開始更在意「你怎麼得出答案、能不能負責」,導致 Z 世代面臨一種新型壓力:即使你做得更快,別人也會懷疑你是不是「靠 AI」。 更關鍵的是,Z 世代經常同時扮演兩種身分: – 在校生:成績、作業、作品集被 AI 重新定義。 – 職場新鮮人:工作流程與技能要求在一年內可能就翻新。 這使他們比其他世代更常遇到「規則尚未定型」的轉換期。 教育端:從「禁止」走向「可驗證的使用」...

在生成式 AI 進入主流應用後,OpenAI 與 Anthropic 的競爭早已不只是「模型誰更強」。兩家公司的路線之爭,正延伸到三個更關鍵的戰場:AI 監管話語權、品牌與廣告攻防、以及雲端與企業採購鏈的權力重分配。理解這場角力,能幫你看清未來幾年 AI 產品會怎麼被管、怎麼被賣,以及誰最可能成為企業與政府的「預設供應商」。 兩種路線:產品擴張 vs. 安全治理 OpenAI 的強項在於把模型快速產品化並規模化:從 ChatGPT 的大眾化入口、到企業版與開發者 API 生態,主打「先把市場做大」。這條路線的優點是迭代速度快、資料回饋多、開發者黏著度高;風險則在於外溢影響也更快出現,例如錯誤資訊、提示注入(prompt injection)、資料外洩與版權爭議等,都會在大規模使用下被放大。 Anthropic 的敘事更偏向「安全與可控」:以憲法式 AI(Constitutional AI)等概念,強調模型行為可被規範、可稽核、可降低有害輸出。這種定位對企業法務、合規團隊與政府機關特別有吸引力,因為他們要的不是炫技,而是可預期、可證明、可承擔。 這裡的關鍵不是誰比較道德,而是:...

在「AI 幫你寫程式」逐漸變成日常之後,下一個痛點很快浮現:你不可能永遠坐在電腦前。當需求臨時變更、CI 失敗、線上出現告警、或你只想在通勤時把一段重構思路記下來,傳統流程往往只剩「先記在備忘錄,回到桌面再做」這種低效率選項。 Claude Code Remote Control 行動版的核心價值,就是把 Claude Code 從「只能在固定工作站使用的 AI 編程工具」,推進到「可跨裝置操控的開發工作流」。手機不再只是訊息通知器,而是能在你離開座位時,依然維持開發節奏的控制台。 這不是把 IDE 搬到手機,而是把「決策與推進」搬到手機 很多人聽到行動版,第一直覺是「在手機上寫程式」。但真正有用的情境,往往不是長時間輸入程式碼,而是: 快速理解狀態:目前改了哪些檔案、測試失敗原因、PR 討論重點、下一步該做什麼。 下指令推進任務:請 Claude 針對某段差異做風險評估、產生修補、補測試、更新文件、整理 commit 訊息。...

MiMo‑V2‑TTS 在做什麼:把「會說話」提升到「會表達」 語音合成(TTS)早已不稀奇,但多數產品仍停留在「字念得準、聲音夠順」;真正讓人感到自然的,往往是語氣、停頓、輕重音、情緒強度這些細節。小米推出的 AI 語音大模型 MiMo‑V2‑TTS,主打細粒度情感控制,目的就是讓語音不只像真人,更能在不同情境下「表達得像真人」。 對正在發展 AI Agent(能自主執行任務的助理/代理)的人來說,這個方向很關鍵:Agent 若只會冷冰冰地回覆,互動體驗很難跨過「工具」門檻;而一旦語音能帶出安撫、提醒、關懷或緊迫感,使用者更容易把它當成可溝通的「服務角色」。 情感控制為何重要:它影響的不只是好聽 細粒度情感控制不只是把聲音調成「開心、難過」這種粗分類,而是更接近人類語音的連續光譜,例如: 同一句話在不同任務下需要不同語氣意圖(提醒、道歉、鼓勵、警示) 情緒不只種類,還有強度與變化曲線(先平靜、後堅定) 更自然的韻律與停頓,能降低「機器感」與聽覺疲勞 當語音被用在客服、醫療提醒、車載助理或兒童教育時,語氣的好壞會直接影響信任感、理解度與完成率。換句話說,TTS 從「聲音輸出」走向「互動品質控制」。 對哪些人最有感:Agent、客服、內容與遊戲 1) AI Agent 與智慧助理 能依情境調整語氣的 TTS,會讓...

阿里巴巴近期推出企業級 AI Agent 平台「悟空」,並用「24 小時自動化的龍蝦軍團」作為核心敘事:把一群可分工、可協作、可輪班的 AI 代理人(Agent)變成企業可調度的「數位勞動力」。 這不只是又一個聊天機器人。若它真的能把「從需求→拆解任務→呼叫工具→寫入系統→回報結果」整段流程做成可治理的企業平台,代表企業導入生成式 AI 的重心,正在從「回答問題」轉向「完成任務」。 為什麼大家都在做 Agent?因為聊天已經不夠用 企業最常見的痛點不是「缺少內容」,而是「流程太碎、系統太多、人力被雜務吃掉」。傳統 RPA 擅長固定流程,但遇到例外狀況就容易卡關;而 LLM 擅長理解與生成,但若沒有工具與權限,就只能停留在建議層。 Agent 的定位正好在兩者之間: 能理解任務:把自然語言需求拆成步驟與條件。 能動手做事:串接 API、資料庫、工單、CRM、ERP 等工具。 能協作與交接:多個...

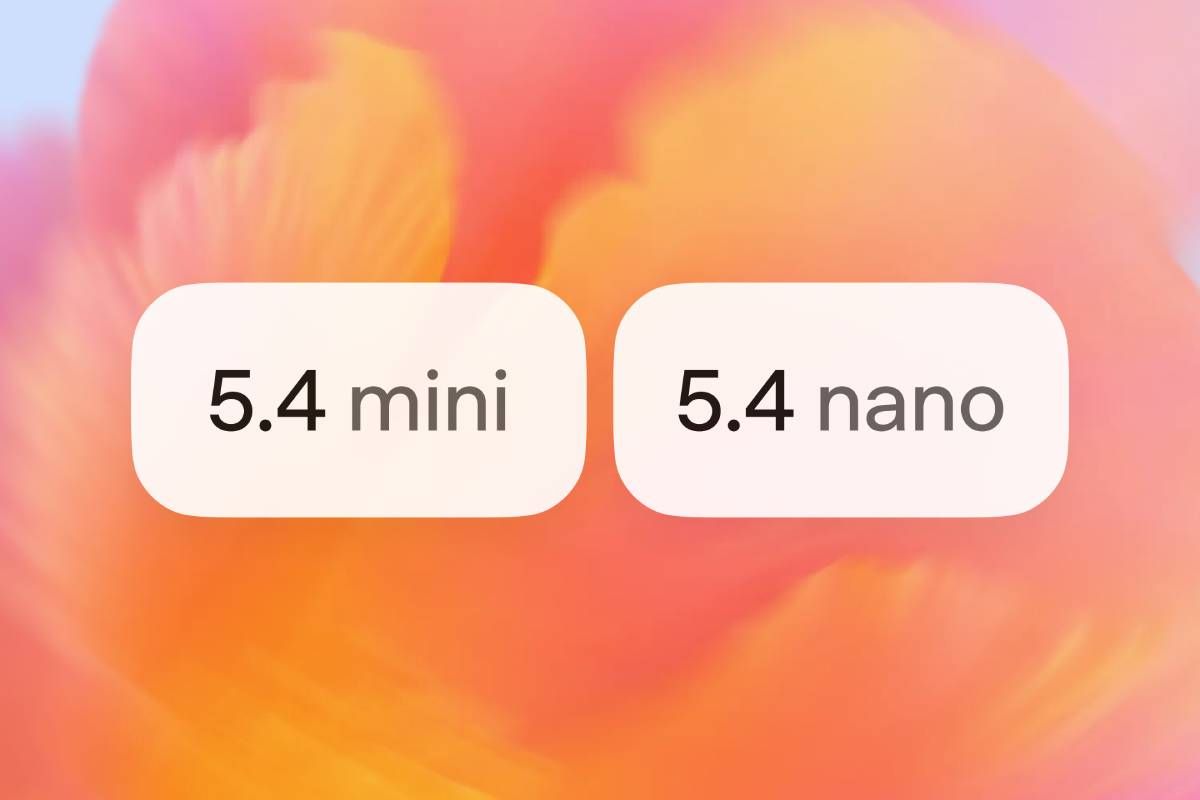

OpenAI 近期推出兩款全新小型模型 GPT-5.4 mini 與 GPT-5.4 nano,主打「速度提升 2 倍」且在多數任務上「表現直逼旗艦級」。這不是單純的規格更新,而是把生成式 AI 的重心,從「追求最強」拉回到「更快、更穩、更便宜、更好整合」的現實需求。 對多數產品與內容團隊來說,真正卡住的往往不是模型不夠聰明,而是 延遲、成本、併發量、可控性。mini 與 nano 的出現,代表 OpenAI 正在把「可大規模落地」視為優先目標。 小模型為什麼突然變得關鍵? 當 AI 從試用走向正式上線,你會很快遇到三個痛點: 延遲:客服、即時助理、推薦與搜尋輔助,使用者對「等一下」的容忍度極低。 成本:高頻率、長對話、多人同時使用的場景,最終會變成帳單問題。...

小紅書近期針對所謂「AI 託管」帳號加強治理,重點不在於「不能用 AI」,而是鎖定一類更具破壞性的做法:用系統自動生成內容、批量發佈,甚至模擬真人互動(自動留言、私訊、追蹤、按讚),讓帳號看起來像真實使用者在經營,實際上卻是機器在跑流程。 這波行動傳遞的訊號很明確:平台要保住內容生態的可信度與互動品質,而「自動化+偽裝真人」被視為踩到紅線。 什麼是「AI 託管」?為何平台特別敏感 在行銷圈或代營運圈,「託管」常被包裝成省時、省人力:你只要付費,系統或外包團隊就能替你完成選題、產文、發佈與互動。但當這套流程高度自動化、並以「模擬真人」為目標時,問題就不只是內容品質,而是信任機制被濫用。 常見高風險特徵包括: 內容端:大量同質化模板文、關鍵字堆疊、改寫拼貼、批量日更,且缺乏真實使用情境或個人經驗。 互動端:短時間內異常密集按讚/留言/追蹤、留言語意空泛但頻率極高、跨帳號互刷。 營運端:一人(或一套系統)同時控制多帳號、固定時段機械式發文、IP/裝置行為不自然。 平台對「AI 輔助」通常相對寬容,但對「AI 代替真人身份與社交行為」會更嚴格,因為它直接影響推薦系統判斷與使用者信任。 為什麼現在出手更重:推薦機制與商業信任正在被侵蝕 小紅書的核心價值建立在「種草」:使用者相信這是來自真人的經驗分享與生活選擇。若大量 AI 託管帳號用低成本灌入內容,再配合假互動把熱度拱上去,會產生三個後果: 使用者看到的不是好內容,而是被操作的熱度:推薦流一旦被灌水,優質創作者反而更難被看見。 品牌投放的衡量失真:看似曝光、互動漂亮,但轉換與口碑可能是空的,最後傷害的是平台廣告與商業合作的信任。 詐騙與灰產更容易寄生:假人設、假心得、假客服式私訊導流,往往與不透明交易風險綁在一起。 因此,治理「AI 託管」並非單純反 AI,而是反對利用自動化去偽造社群關係。...

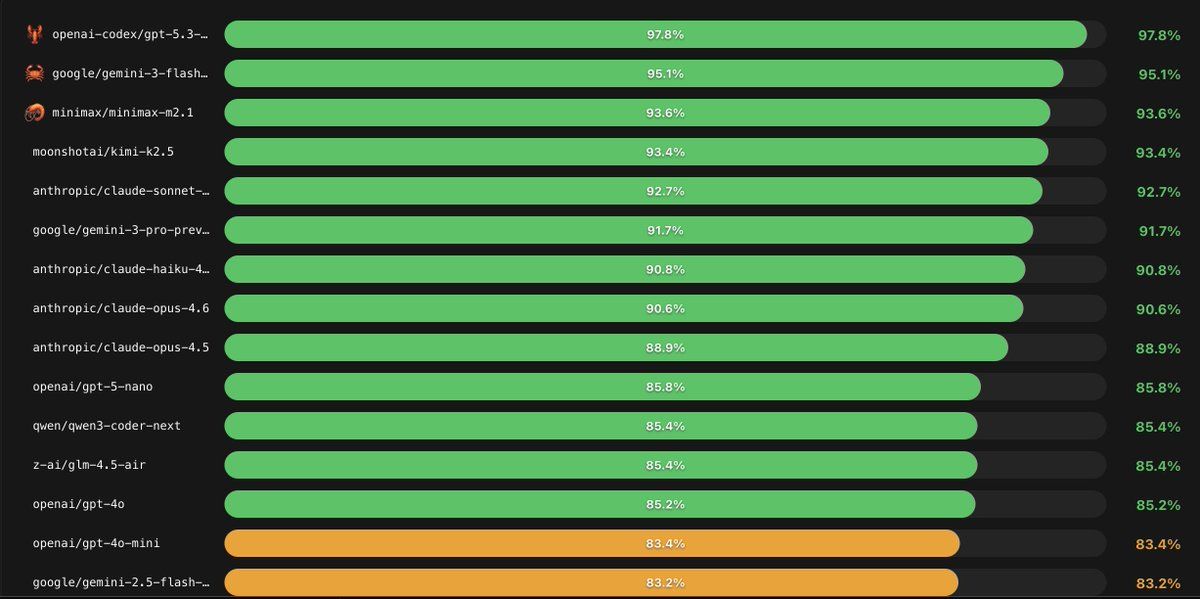

OpenClaw 釋出官方 Agent 成功率(success rate) 數據後,很多人第一個問題都是:「到底哪個模型最強?」但如果只把榜單當成冠軍賽排名,很容易選錯工具、甚至把 PoC 做到一半才發現成本、穩定性或安全性不合用。 這篇文章會用「如何讀懂成功率」為主線,帶你看 OpenClaw 類評測在說什麼、沒說什麼,以及不同使用情境該怎麼把數據轉成可落地的選型決策。 成功率到底測到什麼?它其實在測「把事情做完」的能力 一般聊天模型評估常看回答品質或知識正確性;但 Agent 評估(像 OpenClaw)更接近真實工作: 需要多步推理:拆解任務、規劃步驟、調整策略 需要工具使用:呼叫搜尋、瀏覽器、API、程式執行、檔案處理等 需要狀態管理:記住已做過什麼、避免重複、處理中斷與回復 因此「成功率」的直覺意義是:在固定環境與規則下,模型作為 Agent 能否把任務完整交付。對想做自動化工作流、客服助手、資料整理、內部營運工具的人來說,這比單輪問答更接近實戰。 為什麼榜單一公布,大家仍會得出相反結論?關鍵在你怎麼解讀「最強」 OpenClaw...

香港網絡安全中心近期就名為 OpenClaw、外號「龍蝦」的工具/框架提出警告,特別強調其帶來的網絡風險可能「遠超」一般人對聊天式 AI 的想像。這類提醒值得重視,原因不在於「AI 一定更危險」,而是工具形態不同:聊天式 AI 多半停留在內容生成與對話層面;而可被用於自動化流程、整合外部資源、呼叫系統功能的工具,一旦落入不當使用情境,影響面就會更貼近真實攻擊鏈。 在不少攻擊事件中,真正造成損失的往往不是單一漏洞,而是「偵察 → 釣魚/入侵 → 橫向移動 → 權限提升 → 資料外洩或勒索」的連鎖動作。若某些工具能降低這些步驟的門檻、加速自動化、甚至把多個能力包成「一套可重複使用的流程」,那麼對企業與一般用戶而言,風險確實可能比「被 AI 生成假消息」更直接。 為什麼「不只是聊天式 AI」?你可以這樣理解差別 許多人談到 AI 風險,第一個想到的是:假資訊、深偽、詐騙話術更像真的。但香港網絡安全中心此類警告的核心,通常更接近「作業層面的威脅」: 自動化的攻擊腳本化:把原本需要技術門檻的動作,變成更易複製、可大量嘗試的流程。...