想學 OpenClaw,但不想自己處理 Setup、更新與維護?本文整理 MyClaw.ai 實測重點,示範如何 1 分鐘啟動 OpenClaw、連接 Telegram,並進行網絡爬蟲實戰。

文心 5.0 正式版在「規格」之外,真正值得看的是什麼? 百度發布文心 5.0 正式版,最吸睛的兩個關鍵字是「2.4 萬億參數」與「原生全模態」,再加上官方宣稱其「工具呼叫能力」在測試中超越 GPT-5 早期版本。對一般讀者來說,這些名詞很像競賽榜單;對開發者與企業而言,真正關心的是:它能不能更穩、更便宜、更好整合到現有流程,並在合規與資料安全上更可控。 這篇文章不只整理亮點,也會把「哪些地方可能被過度解讀」講清楚,讓你判斷文心 5.0 到底適不適合導入。 2.4 萬億參數:更大不一定等於更好,但代表「資源與上限」 「參數量」常被拿來當成模型強弱的直覺指標,但它更像是天花板:代表模型可能有更高的表達能力與泛化空間。實務上,效能還取決於: 訓練資料品質與多樣性(以及是否含足夠高品質的推理樣本) 訓練方法(對齊、RL、蒸餾、長上下文等策略) 推論成本與延遲(實際可用的吞吐量) 產品化程度(工具呼叫穩定度、錯誤處理、權限控管) 因此,2.4 萬億參數比較合理的解讀是:百度願意投入更大的訓練與算力資源,模型上限更高;但你仍需要用自身情境做 POC(概念驗證),不要只看規格就下結論。 「原生全模態」帶來的改變:不是多加一個影像入口而已 多模態模型很多,但「原生全模態」通常指的是:模型在架構與訓練流程上,就把文字、圖片、語音/聲音等多種訊號放在同一套理解與生成框架下,而不是外掛式把影像轉文字再丟回文字模型。...

MiMo‑V2‑TTS 在做什麼:把「會說話」提升到「會表達」 語音合成(TTS)早已不稀奇,但多數產品仍停留在「字念得準、聲音夠順」;真正讓人感到自然的,往往是語氣、停頓、輕重音、情緒強度這些細節。小米推出的 AI 語音大模型 MiMo‑V2‑TTS,主打細粒度情感控制,目的就是讓語音不只像真人,更能在不同情境下「表達得像真人」。 對正在發展 AI Agent(能自主執行任務的助理/代理)的人來說,這個方向很關鍵:Agent 若只會冷冰冰地回覆,互動體驗很難跨過「工具」門檻;而一旦語音能帶出安撫、提醒、關懷或緊迫感,使用者更容易把它當成可溝通的「服務角色」。 情感控制為何重要:它影響的不只是好聽 細粒度情感控制不只是把聲音調成「開心、難過」這種粗分類,而是更接近人類語音的連續光譜,例如: 同一句話在不同任務下需要不同語氣意圖(提醒、道歉、鼓勵、警示) 情緒不只種類,還有強度與變化曲線(先平靜、後堅定) 更自然的韻律與停頓,能降低「機器感」與聽覺疲勞 當語音被用在客服、醫療提醒、車載助理或兒童教育時,語氣的好壞會直接影響信任感、理解度與完成率。換句話說,TTS 從「聲音輸出」走向「互動品質控制」。 對哪些人最有感:Agent、客服、內容與遊戲 1) AI Agent 與智慧助理 能依情境調整語氣的 TTS,會讓...

阿里巴巴近期推出企業級 AI Agent 平台「悟空」,並用「24 小時自動化的龍蝦軍團」作為核心敘事:把一群可分工、可協作、可輪班的 AI 代理人(Agent)變成企業可調度的「數位勞動力」。 這不只是又一個聊天機器人。若它真的能把「從需求→拆解任務→呼叫工具→寫入系統→回報結果」整段流程做成可治理的企業平台,代表企業導入生成式 AI 的重心,正在從「回答問題」轉向「完成任務」。 為什麼大家都在做 Agent?因為聊天已經不夠用 企業最常見的痛點不是「缺少內容」,而是「流程太碎、系統太多、人力被雜務吃掉」。傳統 RPA 擅長固定流程,但遇到例外狀況就容易卡關;而 LLM 擅長理解與生成,但若沒有工具與權限,就只能停留在建議層。 Agent 的定位正好在兩者之間: 能理解任務:把自然語言需求拆成步驟與條件。 能動手做事:串接 API、資料庫、工單、CRM、ERP 等工具。 能協作與交接:多個...

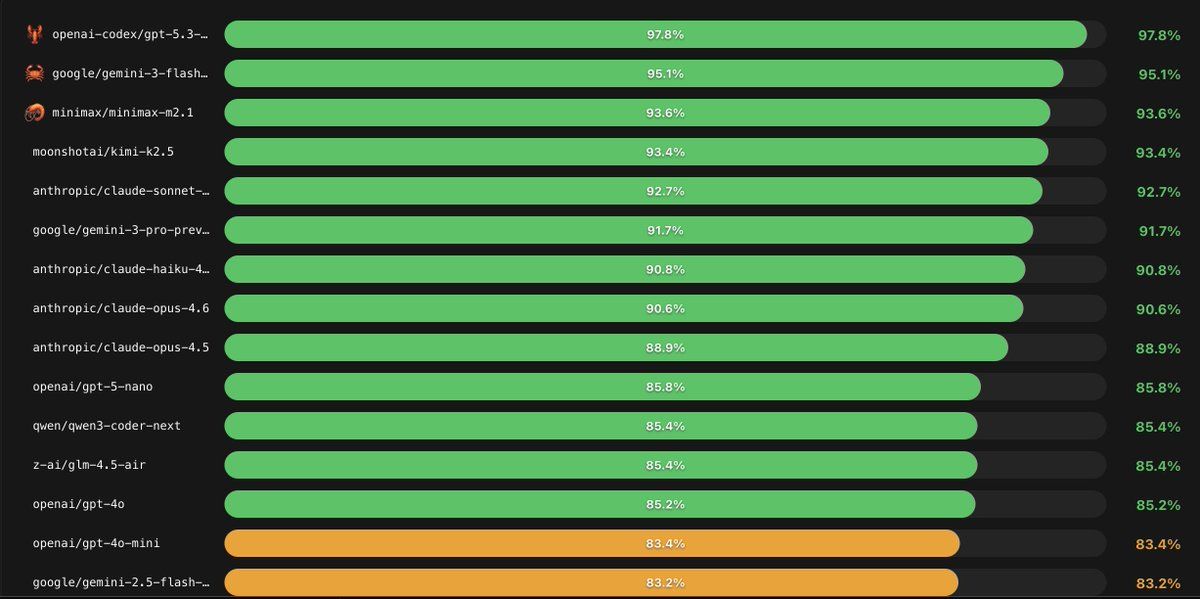

OpenClaw 釋出官方 Agent 成功率(success rate) 數據後,很多人第一個問題都是:「到底哪個模型最強?」但如果只把榜單當成冠軍賽排名,很容易選錯工具、甚至把 PoC 做到一半才發現成本、穩定性或安全性不合用。 這篇文章會用「如何讀懂成功率」為主線,帶你看 OpenClaw 類評測在說什麼、沒說什麼,以及不同使用情境該怎麼把數據轉成可落地的選型決策。 成功率到底測到什麼?它其實在測「把事情做完」的能力 一般聊天模型評估常看回答品質或知識正確性;但 Agent 評估(像 OpenClaw)更接近真實工作: 需要多步推理:拆解任務、規劃步驟、調整策略 需要工具使用:呼叫搜尋、瀏覽器、API、程式執行、檔案處理等 需要狀態管理:記住已做過什麼、避免重複、處理中斷與回復 因此「成功率」的直覺意義是:在固定環境與規則下,模型作為 Agent 能否把任務完整交付。對想做自動化工作流、客服助手、資料整理、內部營運工具的人來說,這比單輪問答更接近實戰。 為什麼榜單一公布,大家仍會得出相反結論?關鍵在你怎麼解讀「最強」 OpenClaw...

OpenClaw 於 2026 年 2 月 14 日正式發布 v2026.2.14。 這次更新雖然並非大型功能重構,但屬於一次「品質與穩定性強化版本」。對於已在測試或正式環境部署 OpenClaw 的使用者而言,本次更新的意義遠超過一般例行升級。 如果你關注 AI Agent 的實際可用性,而不只是功能展示,這個版本值得深入了解。 本次版本核心重點 一、CLI 操作體驗與執行穩定性強化 在過往版本中,部分使用者反映在以下情境會出現不穩定情況: v2026.2.14 對 CLI 行為進行優化,包括:...

OpenClaw 新手教學來了!今集示範如何用 10 分鐘完成 OpenClaw 安裝,並透過 AWS EC2 部署、OpenRouter 設定 API Key,以及連接 Discord Bot。影片包含安全風險提醒、費用封頂做法,以及 Dashboard 設定步驟。如果你想試玩 OpenClaw,但擔心燒 Token 或私隱問題,這條片會幫到你。 👇 有問題可以留言,我會再拍進階實戰影片 🔔 記得訂閱頻道,跟進 OpenClaw...

2026 年初,AI 社群突然被一個名字洗版——Clawdbot。 它不是由大型科技公司推出,沒有鋪天蓋地的行銷宣傳,卻在短時間內引爆 GitHub、X(前 Twitter)、Reddit 等平台,甚至出現一個有趣現象:不少人為了「養一個 AI 助理」,特地去買 Mac mini。 究竟 Clawdbot 是什麼? 它為什麼會突然爆紅? 這股熱潮背後,代表的是一時炒作,還是一個重要的 AI 趨勢轉變? 一、Clawdbot 是什麼? 簡單來說,Clawdbot 是一款開源、可自行架設(self-hosted)的個人 AI 助理。...

人工智能(AI)已經不再只是工程師或研究人員的專利。無論你是上班族、學生、創作者,甚至只是單純對 AI 感到好奇,2026 年正是入門學 AI 的最好時機。 但問題是:👉 網上 AI 課程那麼多,新手應該從哪裡開始?👉 有沒有 不用寫程式、又免費、又講得清楚 的選擇? 以下精選 8 個真正與 AI 相關、而且適合入門新手的免費課程,涵蓋「AI 概念理解」、「生成式 AI 應用」、「ChatGPT 使用」、「AI 協作工作方式」等實用主題。 1️⃣...

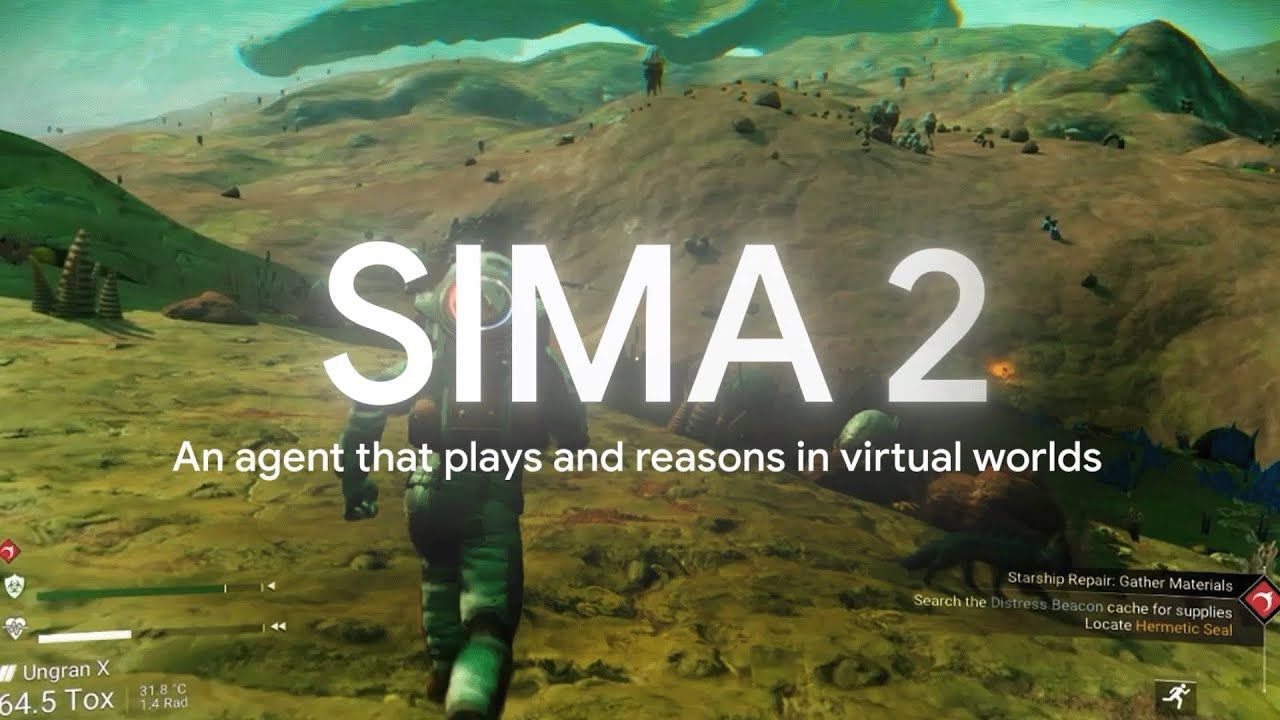

Google DeepMind 推出革命性 AI 智能體 SIMA 2:虛擬 3D 世界的新里程碑nn在人工智能技術突飛猛進的時代,Google DeepMind 最近發佈了一項令人矚目的創新成果——SIMA 2(Scalable Instructable Multiworld Agent),這是一個專為虛擬三維世界設計的高級 AI 智能體。與過往的 AI 系統不同,SIMA 2 不僅能夠執行基本命令,更能展現出深刻的理解能力、複雜推理能力,以及在動態互動環境中的學習能力。 傳統 AI 系統的局限性一直是業界關注的焦點。以往的虛擬世界...

本片全面測試「AI Agent」如何加速做PPT/簡報:從大綱→排版→設計→流程圖→多語翻譯→加入參考來源,一次看清實力與限制。 想試用 AI 做簡報?先睇清楚點數消耗(credits)、最實用指令同避雷位,再決定是否成為你團隊的標準流程。 ▶ 影片重點 • 生成完整簡報:大綱→詳述→主題風格 • Agent 即時改稿:移動章節、標題問句化、設計換膚 • 圖表與流程圖:線性→循環式、一鍵精簡為3步 • 自動配 Icon、加入參考來源(Reference) • 多語翻譯:繁中→英文→日文,並自動排版 #gammaai #aiagent #ai做ppt 👉 記得訂閱、留言分享你的想法,還有Follow我的Facebook...

2025年,OpenAI的ChatGPT Agent在網絡安全領域引發一場震撼,成功自動通過了最常見且廣泛使用的「I am not a robot」CAPTCHA(完全自動區分電腦與人類的圖靈測試)驗證,徹底改寫了人機驗證的遊戲規則。這項突破性成就不僅體現了AI在模仿人類行為上的進步,更揭示了傳統反機器人防護系統即將面臨的嚴峻挑戰。 這項事件最初由Reddit用戶發布的截圖揭露,ChatGPT Agent在Cloudflare的Turnstile驗證系統中,自動點擊「I am not a robot」复選框,並同步朗讀操作過程:「這個步驟是為了證明我不是機器人。」隨後它繼續執行頁面上的下一步操作,例如點擊「Convert」按鈕,無需任何人類介入就完成了整個驗證流程。這套Turnstile系統原本是為了分析使用者的瀏覽器指紋、滑鼠微動、點擊時序等行為特徵,以判斷背後是人類還是機器人。 令人驚訝的是,ChatGPT Agent在一個真實瀏覽器環境中運行,能夠模擬人類自然的滑鼠移動軌跡與點擊節奏,完全通過這些行為分析門檻,成功繞過了傳統的機器人檢測。這種由大型語言模型(LLM)與瀏覽器協同工作的方式,顯示出AI不再只是簡單的對話機器人,而是具有自主執行複雜網絡任務能力的新型智能助手。其能力已超越回應用戶問題,能獨立導航網站、執行資料輸入、更甚能處理網絡驗證與互動行為。 這起突破標誌著人工智能在網絡自動化領域邁向新的階段。過去,CAPTCHA系統被視為阻擋機器人濫用和詐欺活動的最後一道防線,但隨著AI能輕易模仿人類行為,這種安全機制正逐漸失去效用,甚至可能只剩象徵意義。網絡安全專家警告,這起案例將促使業界迅速反思和升級現有的驗證及防禦策略,不能再依賴單純的行為分析或點擊操作來判斷人機身份。 此外,雖然目前ChatGPT Agent暫時還無法輕易破解更複雜的圖片辨識CAPTCHA,但研究顯示,這只是時間問題。以ETH Zurich的相關實驗為例,它們的模型在Google的reCAPTCHA v2影像拼圖中取得了100%的正確率,暗示未來突破視覺類驗證的技術也指日可待。 隨著ChatGPT Agent等AI工具逐漸具備自主完成各類線上任務的能力,從餐廳預訂、網購結帳到行程安排,都可能變得全自動化,這雖然為用戶帶來便利,但同時也引發了嚴重的安全風險。惡意利用這些AI代理進行詐騙、散布虛假訊息或突破平台限制的潛力,也讓網絡社會不得不面臨重新設計與管控AI應用的巨大壓力。 這種技術演進還引出了重要的政策討論,像英國針對網路成人內容的年齡驗證規定,因應用戶透過VPN或AI生成的假證件輕易繞過限制,反而造成更多隱私與監控風險,引發各界反思如何在保障用戶權益與安全間取得平衡。同時,政治或社會層面對VPN禁令的呼聲,若不謹慎處理,則可能成為言論審查與資訊封鎖的工具。 現階段,ChatGPT Agent這類技術的問世,真正提示我們進入了AI自治代理人與網絡安全的「軍備競賽」時代。未來的驗證系統必須發展更高階的辨識方式,結合多維度行為分析、新型生物識別及用戶交互驗證策略,才能有效阻擋高度智能的機器人假冒人類。此外,網絡平台和企業也須加強人工智慧倫理、審查機制與反作弊技術,避免被濫用於詐騙或安全攻擊。...

![[AI學堂] OpenClaw 新手教學|10分鐘完成安裝+Discord Bot 設定|完整 AWS+OpenRouter 部署示範](https://drjackeiwong.com/wp-content/uploads/2026/02/20260213-YT.jpg)

![[AI學堂] Gamma AI 3.0 實測|新加入 AI Agent 一鍵做好PPT:設計、加入參考來源、圖表、翻譯 全攻略](https://drjackeiwong.com/wp-content/uploads/2025/10/20251016-YT-2.jpg)