隨著人工智慧技術的蓬勃發展,OpenAI的ChatGPT在全球廣泛使用,其強大的語言理解能力為用戶帶來極大便利,然而關於隱私與資料安全的顧慮也日益突出。2025年,隨著法規日益嚴格及AI技術普及,了解在使用ChatGPT時不可透露的重要資訊,成為保障個人及企業數據安全的關鍵。 首先,絕對不可透露的個人識別資訊(PII)包括全名、出生日期、身份證號碼、地址、電話及電郵等,這類資料能明確識別個人身份。儘管OpenAI公開表示不會故意保留此類資訊,但系統的資料庫中仍存在被駭客入侵或程式漏洞導致資料外洩的風險。一旦個人敏感資料外洩,可能導致嚴重的身份盜用、金融詐騙及釣魚攻擊,對當事人造成巨大損失。用戶務必避免在ChatGPT中輸入任何可能暴露身份的細節,以降低潛在危害。 其次,密碼及登入憑證亦屬高度敏感資訊,絕不可分享。過去曾爆出超過22.5萬組OpenAI帳號憑證遭惡意軟體竊取,這些憑證被公開在暗網,若遭入侵者利用,不僅可存取完整聊天紀錄,更可能操縱帳號進行進一步攻擊。此外,ChatGPT在資料傳輸過程中存在被截取的風險,員工在商業環境中為尋求工作便利,常直接複製公司文件或機密內容輸入AI,無意間將企業核心機密暴露於風險中。企業應積極推行適當的AI使用政策,並採用企業版ChatGPT來加強數據加密與管理。 健康紀錄、醫療資訊也是敏感範疇,不適合使用於ChatGPT。因為這類資料受到嚴格隱私法規保護,如GDPR(歐盟通用數據保護條例)及HIPAA(美國健康保險攜帶與責任法案),不符合合法分享的標準。ChatGPT目前在遵循GDPR等隱私規範上仍有不足,特別是資料保存時間無明確限制,使用者即便刪除聊天紀錄,資料仍可能被OpenAI保留數十天甚至無限期,形成明顯的安全隱憂。 第四,智慧財產權和商業機密不應在ChatGPT中公開。企業內部的產品規劃、合約條款、專利資料乃至策略文件,一旦被輸入公共或非授權的AI平台,可能遭非法使用或外洩,造成商業損失。即使OpenAI提供暫時性聊天模式及資料不納入模型訓練的選項,這些防護措施並非百分百可靠,故嚴控機密資訊的輸入仍不可避免。 最後,心理諮詢或個人情感類對話亦需慎重。OpenAI的CEO Sam Altman曾表示,使用AI進行的對話目前不具備法律上的保密保障,與心理治療師的專業保密義務截然不同。若用戶在ChatGPT透漏高度私人或心理健康資訊,該數據可能在法律案件中被調閱,缺乏足夠的隱私保護,這對用戶的心理安全構成挑戰。 面對以上潛在風險,建議用戶和企業採取多項措施以減少資料外洩危機: 利用OpenAI設定中的「資料控制」功能,關閉「Improve Model for Everyone」,避免個人資料被用於模型訓練。 使用ChatGPT的「Temporary Chat」模式,確保聊天內容不被永久保存。 企業導入專為商務設計的ChatGPT Team與Enterprise版本,強化資料加密與自訂保存政策。 定期清除聊天紀錄,避免敏感數據累積。 員工教育與規範管理,禁止在聊天過程中輸入任何個人或商業敏感資料。 隨著AI監管政策逐步健全,OpenAI依然面臨政府與用戶強烈要求提升數據合規性的壓力。未來,保障用戶隱私與維護企業安全將成為AI生態不可或缺的基石。唯有用戶提高警覺、合理使用,才能在便利與風險間取得平衡,在AI日益深入生活的年代保護自己與組織的數據安全。 #AI隱私 #數據安全 #ChatGPT風險 #隱私保護...

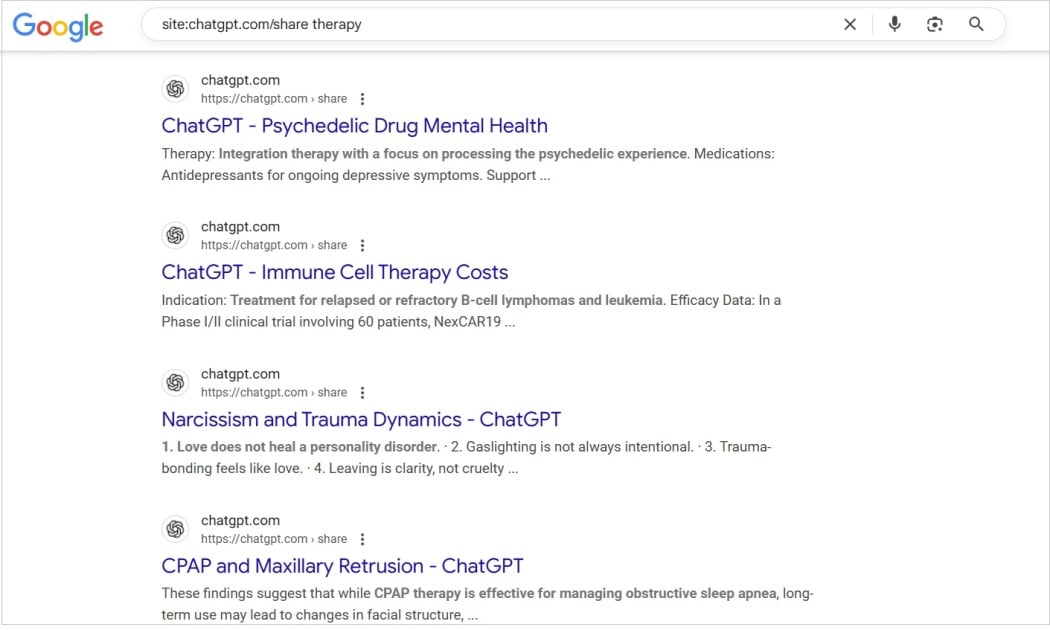

近期有研究發現,ChatGPT用戶透過「分享連結(Shared Links)」功能公開的對話紀錄,竟然被Google與其他搜尋引擎成功索引,造成大量用戶的私人聊天內容在網路上曝光,引發資安與隱私疑慮。 \n \n該功能初衷是讓用戶能夠方便地產生連結,分享自己和ChatGPT的對話內容給他人瀏覽。然而,因為這些分享連結的網頁並未阻止搜尋引擎抓取,導致Google可以透過搜尋「site:chatgpt.com/share」等限定條件,搜出超過5萬筆以上的公開對話。\n \n這些被搜尋出的對話內容範圍甚廣,包括日常問答、專業諮詢、甚至涉及敏感乃至非法的訊息,例如醫療與法律建議、內線交易情資、詐欺自白、網路攻擊計畫以及不當請求等。據《每日電訊報》及其他媒體報導,線上研究員Henk van Ess揭露此風險,認為這類內容原本屬於私密,卻因用戶自行分享功能,反而被廣泛公開並可被全球任何人搜尋到。\n \nOpenAI對此迅速做出回應,表示此分享功能原本只是短期實驗,目的是測試用戶能在保持資訊控制權的同時,便利地分享對話記錄。OpenAI資安長Dane Stucky指出,這項功能存在用戶在不知情下暴露本不打算公開訊息的高風險,因此在2025年7月底緊急移除讓搜尋引擎索引的相關設定,以阻止未經授權的資料被公開。\n \nOpenAI執行長Sam Altman也公開表示,用戶與ChatGPT的對話目前並不享有法律上的保密權限,這和人們在醫師、律師等專業人士前的保密談話大不相同。許多年輕用戶把ChatGPT當成諮商師或人生教練,傾訴各種私事,但目前OpenAI尚未找到方式能在AI對話中有效落實保密機制,這使得隱私保護成為未來亟待解決的挑戰。\n \n此外,OpenAI也提醒用戶,避免在ChatGPT對話中輸入任何敏感個資或機密資訊,尤其不要於公開或分享連結中包含這些資訊,以防止資料外泄。對於曾公開分享的內容,OpenAI已主動聯繫Google等搜尋引擎,要求下架或移除已被索引的對話頁面,努力降低潛在風險。\n \n這次事件也提醒使用AI聊天工具的用戶,謹慎處理個人資料及對話內容,切勿輕易公開或在網路傳播,否則私密性極易受損。ChatGPT的便捷與智慧雖為生活帶來便利,但使用者對於資訊安全的意識必須同步提升。OpenAI未來或將推出更嚴格的保護機制與隱私設計,以加強用戶信任與安全感。\n \n綜觀這起事件,關鍵在於用戶對分享連結功能的理解與操作,以及平台如何管控公開內容的索引權限,兩者缺一不可。對於香港及台灣用戶而言,尤其應重視人工智慧工具的使用規範與數據保護,避免個資意外曝光而造成不必要的損害。這也凸顯了新興科技在便利與隱私保護間的平衡難題,是科技業界和社會共同需要面對的課題。\n\n#ChatGPT隱私風險 #AI對話外洩 #OpenAI資安 #人工智慧分享連結 #數據保護