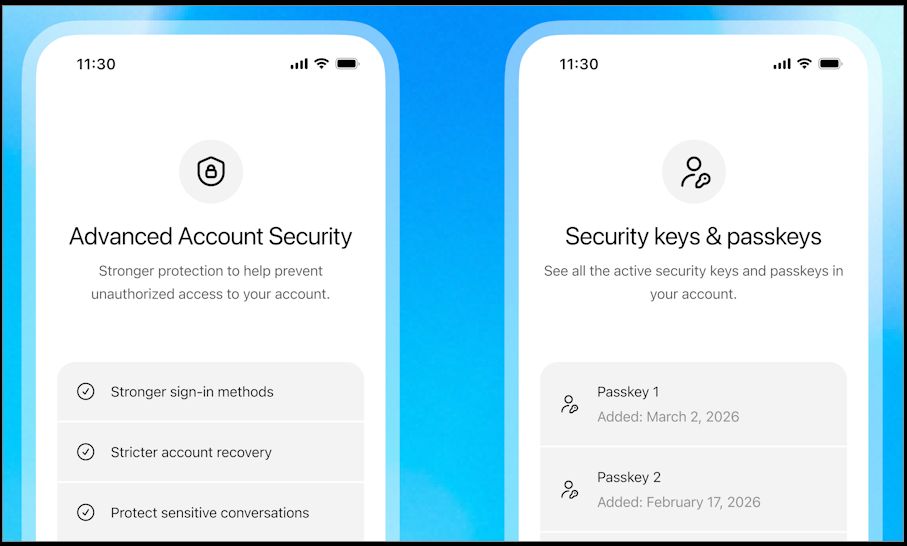

OpenAI 近期推出 **Advanced Account Security**,把 ChatGPT 與 Codex 的「帳號安全門檻」往上抬,重點不是新增一個花俏開關,而是:**對高風險帳號加強登入驗證與帳號恢復(找回)機制**。我認為這是一個明確訊號——生成式 AI 平台開始把「帳號」視為高價值資產:一旦被盜,失去的不只是對話紀錄,而是工作能力、工具權限,甚至可能波及資料品質與訓練流程。 AI 帳號被盜,不是聊天紀錄外洩而已,而是你的工作流程被接管。 ## Advanced Account Security 的主角:把「高風險帳號」的兩個入口鎖更緊 這次更新的主線很清楚: 1. **登入(Login)更難被冒用**:當系統判定帳號風險較高或登入情境異常時,會提高通過門檻。 2. **帳號恢復(Recovery)更難被社工突破**:找回流程變得更謹慎,降低被釣魚、SIM 卡交換、客服社工等手法鑽漏洞的機會。...

ChatGPT Images 2.0 不只是 AI 生圖工具。本文以酒店 staycation campaign 作實測,示範如何由一份活動需求生成完整視覺素材,包括海報、平台比例轉換、FAQ 資訊圖、A/B 測試圖及文字優先級設計。

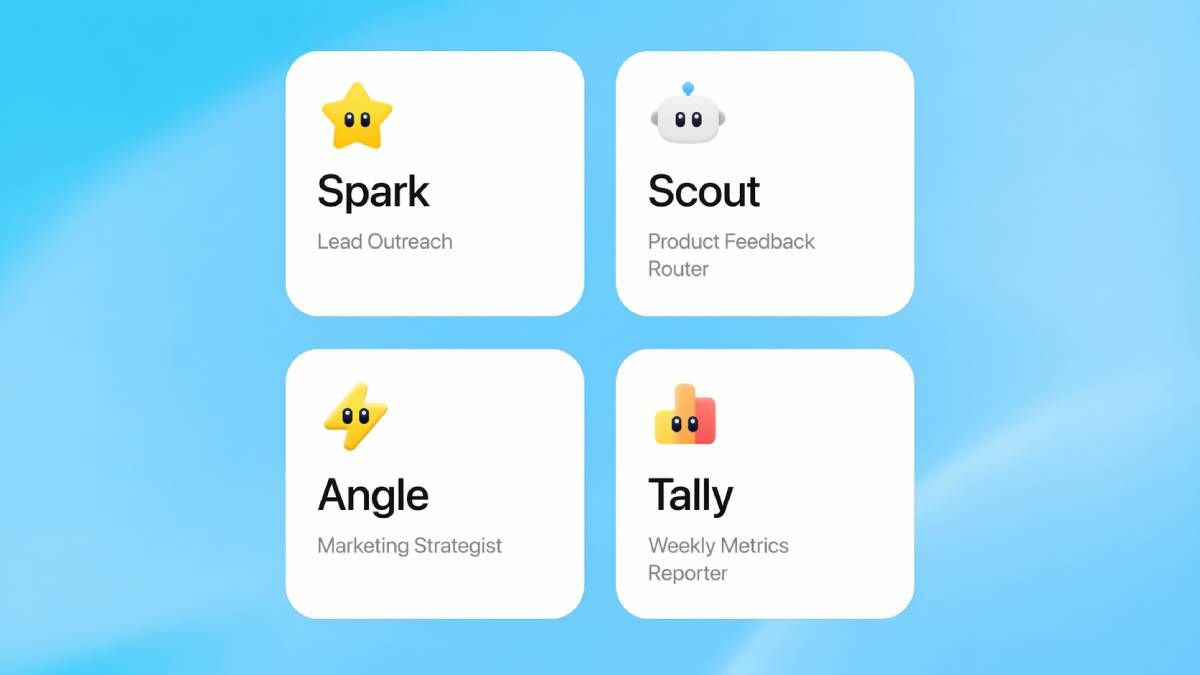

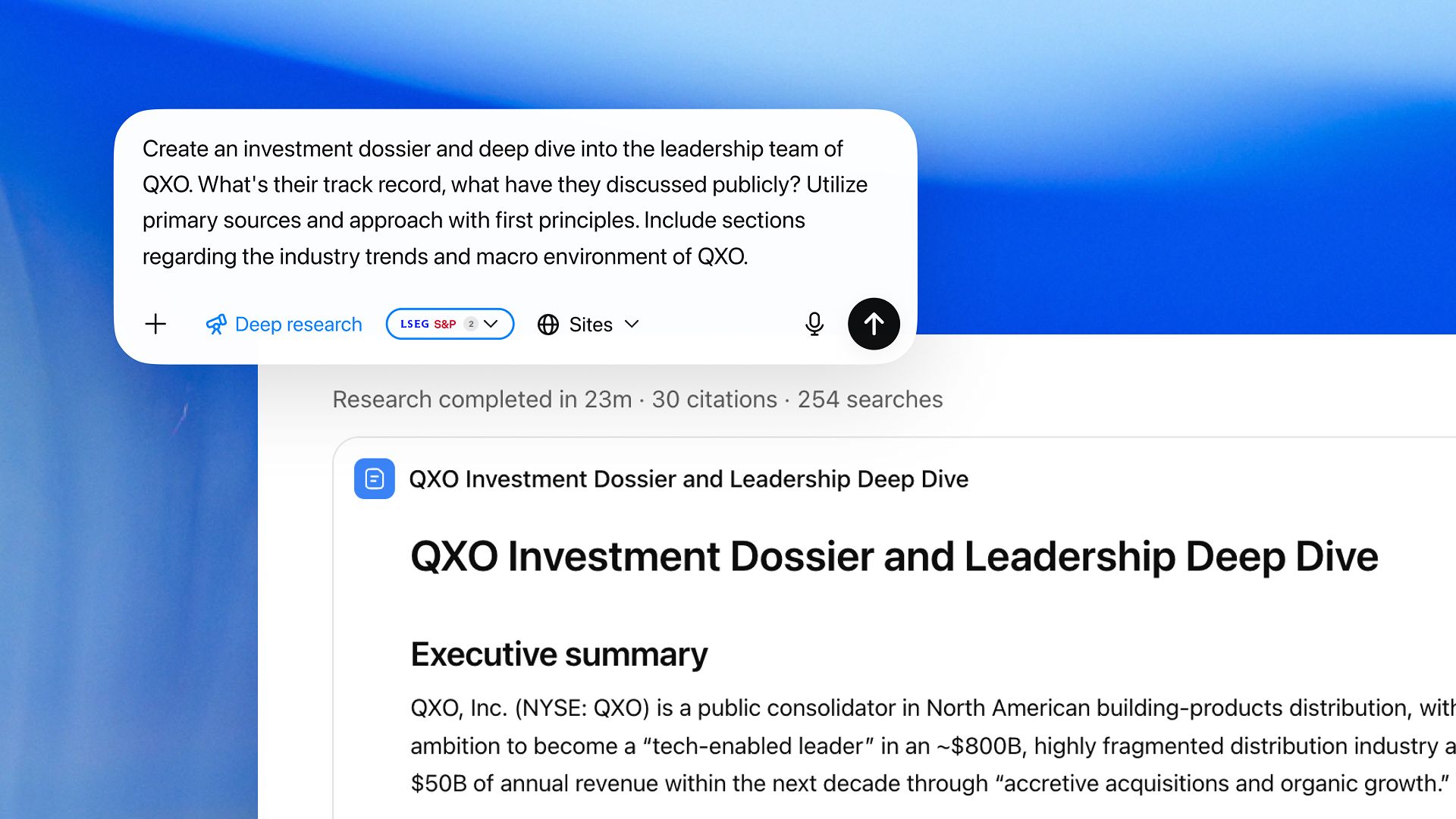

ChatGPT 迎來正式版「工作空間代理(Workspace Agents)」:你不再只是跟 AI 對話,而是能在同一個工作空間裡,設計可重複執行的跨團隊任務,並用權限控管把「能做什麼、能看到什麼、做到哪一步要停下來等人核准」說清楚。最值得先留意的不是它會不會更聰明,而是它終於把代理最難落地的部分——邊界與責任——做成產品。我的判斷是:這次更新的主角不是自動化本身,而是「可被團隊信任的自動化」。 代理的價值不在於它能做多少事,而在於它知道哪些事不能做。 沒有權限邊界的 AI 代理,只是把人為失誤自動化。 Workspace Agents 到底新了什麼:把「個人助理」升級成「團隊可用的執行者」 過去多數人用 ChatGPT,是臨時問答、臨時產出;就算你寫了再漂亮的提示詞,也很難把它變成「團隊共同使用、可交接、可稽核」的流程。 Workspace Agents 的變化可以一句話講完:代理從你的聊天視窗走進工作空間,變成可被設計、可被授權、可被追蹤的工作單位。這跟近期香港來自 OpenAI 在 Codex 上推進「背景運作、多代理並行、記憶、外掛整合」的方向其實一致,只是這次把焦點放在團隊協作與控管上。 這次更新最值得注意的 3 個升級點(而且都跟「可控」有關)...

ChatGPT Images 2.0 這次最明確的升級,是「精準度」與「文字排版」一起變得可用:你不再只是在抽卡式地拿到一張好看但不能上線的圖,而是更容易拿到能放進簡報、廣告素材、產品頁的版本。我的判斷是:生成影像進入下一階段的門檻,不在更華麗的風格,而在「能不能穩定把文字放對、把指示做對」。而這次更新正好打到這個痛點。 以前卡住你的,往往不是美感,而是「可控性」 很多人對 AI 生成圖的失望,都不是因為畫不出「漂亮」,而是畫不出「可用」。最常見的兩種翻車: 文字一上去就崩壞:招牌、海報標題、按鈕文案,全都像亂碼或歪斜字。 指令越寫越長,畫面越不聽話:你要「左上角放 Logo、右側留白、標題兩行、字級層次清楚」,結果模型把重點全吞掉。 一句話:AI 影像最大的差距,從來不是風格,而是可控性。 這次更新最值得注意的 4 個升級點 以下四點,才是你會在工作場景裡立刻感覺到「比較能交付」的原因。 1) 文字渲染更可靠:短文字、標籤、標題更像真的 這次主打「文字排版全面進化」,最直接的體感是:短字串的成功率變高。像是「新品上市」「限時 48 小時」「NT$ 990」這種過往最容易變形的內容,現在更容易保持可讀、字形一致。 文字排版能不能用,決定了生成圖像能不能上線。...

OpenAI 如果真的走向 IPO(首次公開募股),影響不只是一家 AI 公司「上市不上市」而已,而是整個生成式 AI 產業的定價邏輯、合作模式與監管尺度,都可能因此被重新校準。 以下整理 IPO 前你最需要先釐清的 5 個關鍵面向,讓你在看新聞、讀招股書(若未來提交)或評估產業趨勢時,不會只停留在「估值幾千億」這種表層討論。 先看懂:OpenAI 不是典型「一家公司」的架構 OpenAI 的組織結構長期以來就與一般新創不同:它不是單純的 C-Corp 直接募資、直接上市那麼直覺。過去的「非營利母體+營利子公司」設計,核心目的在於把「使命」放在股東利益之前,並透過治理架構限制逐利。 一旦進入 IPO 路徑,市場會追問的第一件事就是: 控制權與董事會如何安排:誰能任命董事?誰擁有最終決策權? 投資人權益如何被定義:若仍存在使命優先條款,會如何影響股東權利? 是否涉及結構調整或重組:任何結構變動都可能牽動既有股東、員工與合作夥伴的權利重分配。...

QuitGPT 並不是一句情緒化的口號,而是一種「用腳投票」的使用者行動:有人刻意減少或停止使用 ChatGPT,轉而改用其他生成式 AI(例如 Claude、Gemini、Copilot、Perplexity,或各類開源/可自架模型)。表面上像是換工具,背後其實牽動的是科技權力集中、內容治理、資料使用、以及使用者能否保有選擇權。 這股趨勢之所以值得關注,不在於「哪個模型比較強」,而在於它讓原本只存在於政策圈與學術圈的議題,被大量一般使用者、創作者與企業採購單位直接面對:當生成式 AI 成為基礎設施,我們還能不能不使用某一家?能不能要求更透明、更可被問責? QuitGPT 在抵制什麼?抵制的其實是「不可見的代價」 許多參與 QuitGPT 的人,並非否認 ChatGPT 的產品力,而是對其背後的治理方式與權力結構感到不安。常見訴求大致集中在三個層面: 政治與治理疑慮:包含平台如何處理敏感議題、是否存在偏好或審查、決策機制是否透明,以及公司與政府、監管、國安議題的距離與互動。 道德與勞動問題:例如訓練資料可能涉及未授權內容、創作者收益與署名、標註與內容審核的人力勞動條件等。 使用者主權與依賴風險:當你把寫作、客服、資料整理、甚至決策輔助都外包給單一供應商,價格、政策、服務可用性與資料保護條款的任何變動,都可能直接影響你的工作與營運。 這使 QuitGPT 更像一場「對平台型 AI 的治理抗議」,而不只是單一產品的好惡。 為什麼矛頭常指向...

很多人不是不想用 Siri,而是常遇到這幾種「卡關」: 指令一多就容易聽錯、或只回傳搜尋結果 跨 App 的流程(整理、改寫、規劃、摘要)做不到位 回覆不夠像「助理」,更像「語音搜尋」 如果你想在 iPhone 上用更強的 AI(例如 ChatGPT、Gemini 等)來取代 Siri 的日常工作,關鍵不是只換一個 App,而是把「叫得出來」與「做得完」這兩件事接起來。以下 3 招,分別解決:語音召喚入口、把 AI 變成可執行的流程、把入口放到你最常用的位置。 招式一:用「聲控」把自訂口令變成你的喚醒詞(最接近「不用 Siri 也能喊」) Siri...

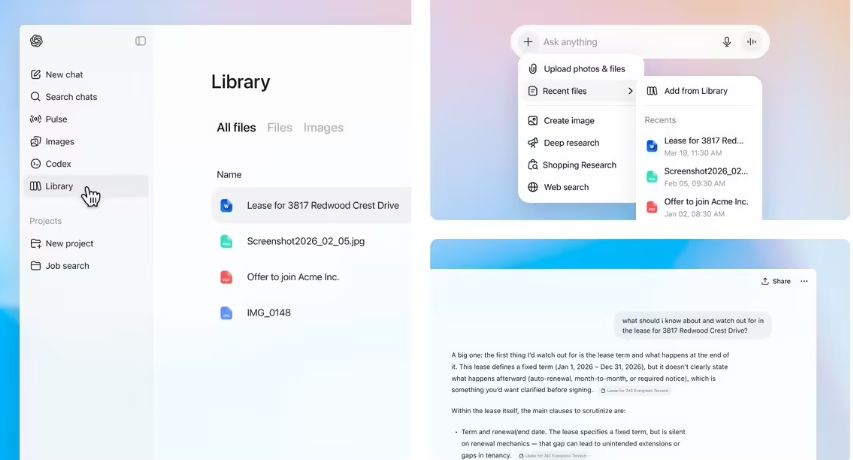

ChatGPT 近期推出「圖庫」雲端功能,主打自動保存你在對話中產生或上傳的檔案與影像,並且能在不同對話間快速調用。這看似只是「多一個存檔位置」,但對內容產製、設計協作、行銷素材管理與知識工作者的日常流程,影響其實很直接:你不再需要回去翻舊對話找附件,也更容易把 ChatGPT 變成一個可持續累積的「素材工作台」。 「圖庫」到底解決了什麼痛點? 以往使用 ChatGPT 做內容或設計輔助,常見情境是: 你在某次對話中產出圖片、簡報、表格或草稿,隔天要再用卻找不到原本那段對話 同一份素材要在不同任務中重複上傳(耗時、版本容易亂) 團隊內部要對齊「這張圖是最新版嗎?」常常靠人工命名或丟到另一個雲端硬碟才安心 「圖庫」把這些問題收斂成一件事:把對話內的檔案與影像從『一次性附件』,提升為『可重複使用的資產』。當你能跨對話即時調用素材,很多工作就會從「每次重做」變成「持續迭代」。 內容行銷與品牌團隊:素材迭代速度會明顯變快 對內容行銷來說,最常被浪費時間的不是寫,而是「找」。例如: 文章用的主視覺、資訊圖表、短影音封面圖 不同渠道需要的尺寸版本(1:1、4:5、16:9) 同一組活動的 EDM 圖檔、Banner、社群貼文視覺 有了圖庫後,你可以在新對話直接叫出先前用過的視覺,請 ChatGPT: 依不同渠道快速改尺寸與版面(並保留一致的品牌元素) 針對同一張圖產出多版本文案與 CTA,做...

在生成式 AI 快速滲透辦公軟體的今天,ChatGPT Excel 外掛與進階財務數據整合,正在重塑金融專業人士的日常工作。對於長期仰賴 Excel 進行財務建模與投資分析的產業來說,這不僅是工具升級,而是一場工作流程與風險管理邏輯的結構性變革。 為何「ChatGPT for Excel」是財務團隊的轉折點 金融與企業財務部門幾乎離不開 Excel: 從三表模型、估值模型、預算編列到風險壓力測試,試算表是整個決策流程的「運算引擎」。但過去幾年,Excel 也暴露出幾個痛點: 建模門檻高,新人需要數月甚至數年才能熟練 場景分析與版本控制繁瑣,極易出錯 財務數據來源分散,在不同系統與平台間來回複製貼上 高階人員浪費大量時間在重複性、機械化操作 ChatGPT for Excel 外掛的出現,等於把一個懂財務、懂 Excel 的...

大型語言模型蒸餾正成為當前 AI 戰略版圖上的關鍵詞,特別是在中美大模型競爭與技術擴散的脈絡下。當我們討論中國大型語言模型能否「追上甚至超越」美國前沿模型時,蒸餾究竟是決定性武器,還是被誇大的助攻工具,是一個值得冷靜拆解的問題。 本文聚焦於一個核心提問:蒸餾對大型語言模型的真正影響有多大? 什麼是大型語言模型蒸餾?從「知識轉移」到「合成資料」 在工程實務中,「蒸餾」已遠遠超出教科書中狹義的知識蒸餾定義。如今談的大型語言模型蒸餾,大致包含以下幾層意義: 使用更強模型的輸出,去訓練較小或較弱的模型 大量生成高品質合成資料(synthetic data),再用來微調或後訓練 在特定能力上進行「能力搬運」,例如推理、Agent 行為、工具調用等 換句話說,蒸餾已經不只是「壓縮一個模型」,而更像是用算力把一部分模型能力轉成資料資產,再讓自己的模型去學。 在當前 LLM 開發流程中,蒸餾與合成資料的重要性體現在: 補足人類標註資料的成本與稀缺 快速試驗新能力(如長鏈推理、複雜工具編排) 讓中型模型在特定場景逼近或超越巨型模型表現 也因此,當談到中國大型語言模型的突飛猛進時,外界自然會把目光聚焦到:這些模型到底從美國前沿 API 蒸餾了多少能力? 蒸餾操作的真實規模:數十億還是數千億 Tokens? 近期有國際公司公開指出,多家中國實驗室透過...

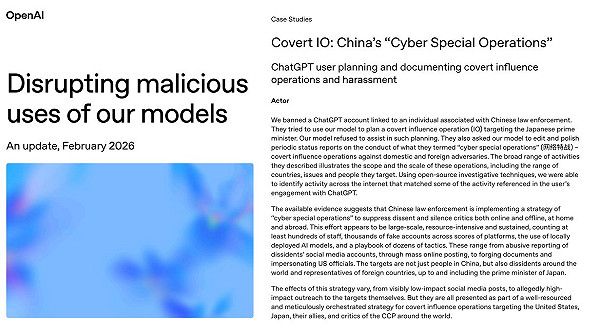

中國利用ChatGPT企圖發動對日本首相的影響操作,正把亞洲的資訊戰推向新階段。當中國執法機關被指試圖透過生成式AI策動跨國輿論戰時,日本與整個民主世界都被迫重新思考「政治安全」與「數位安全」之間的界線究竟在哪裡。 中國利用ChatGPT鎖定日本首相的案例:訊號大於成效 在最新曝光的一起事件中,一名與中國執法單位相關的使用者,被指多次利用大型語言模型,要求協助設計一場針對日本首相高市早苗的線上影響操作。內容包含: 批量生成負面留言與輿論帶風向文案 捏造關於移民政策與生活成本的民怨投訴 將高市描繪成極右派、軍國主義與歷史修正主義者 利用關稅與對美國不滿情緒,將憤怒導向日本政府 同時加入歌頌內蒙古人權與經濟狀況的宣傳內容 由於模型本身的安全防護拒絕了這類明顯帶有操弄目的的請求,相關帳號最後遭到封鎖。但後續發現,同一名使用者之後仍回到系統,請求協助潤飾「行動成果報告」,內容顯示該場影響操作已改用其他本地AI工具繼續推進。這透露出一個關鍵事實:就算某一款國際主流AI系統設有限制,真正有意進行資訊戰的行為者,仍可輕易改用不設防或本地部署的模型來達成目的。 更值得注意的是,這名使用者在報告中提到,相關「特別行動」橫跨數百個海外與中國國內平台,以數千個帳號散布數萬篇內容,甚至對在外異議人士、人權團體與批評者展開長期騷擾與抹黑。從資訊戰角度看,這已不再是零星的「網路帶風向」,而是工業化的「數位鎮壓作戰」。 從網路水軍到生成式AI:影響操作的全面升級 中國的線上影響操作並非今日才出現。過去多年,外界已多次揭露,大量「網路水軍」與虛假帳號長期在各國社群平台上推送親中敘事、攻擊批評者,並干預他國政治議題。不同的是,生成式AI的出現,讓這種操作從「人海戰術」升級為「演算法放大」。 在這起針對日本首相的案件中,可以清楚看到幾項關鍵升級趨勢: 內容產能倍增:AI可以在短時間內生成大量不同語氣、不同語言版本的貼文,大幅降低「洗版」成本。 語言與在地化門檻下降:透過自動翻譯與在地化調整,外國操作者可以「講出像當地人會說的話」,降低被識破的難度。 精準投放與心理操作:在掌握關鍵詞、熱門議題後,AI能快速產出貼近特定族群焦慮的敘事,例如「年輕世代被社福負擔壓垮」這類情緒化說法。 內部作業也AI化:不只對外發文,連內部行動報告、成效追蹤與策略調整也由AI協助撰寫,讓整個資訊戰行動更像一條完整的「數位產線」。 這些能力疊加起來,即使單一行動的外部成效有限(例如數萬篇貼文中真正有高互動者極少),也象徵一種長期、結構化的施壓機制:讓所有批評者都知道,自己隨時可能成為下一波「輿論攻擊」的目標。 為何鎖定日本首相高市早苗? 高市早苗成為中國影響操作鎖定的對象,絕非偶然。近年來,她在國安與對中政策上的立場鮮明,包括: 對台灣安全採取較為明確的支持姿態 將可能的台海危機視為日本的「生存威脅」 對中國內部人權議題,例如內蒙古民族政策,提出公開批評 這些立場直接撞上北京的「紅線」,在戰略思維上就會被視為必須被削弱公信力的對象。於是,我們在這次曝光的行動計畫中看到幾個典型手法:...

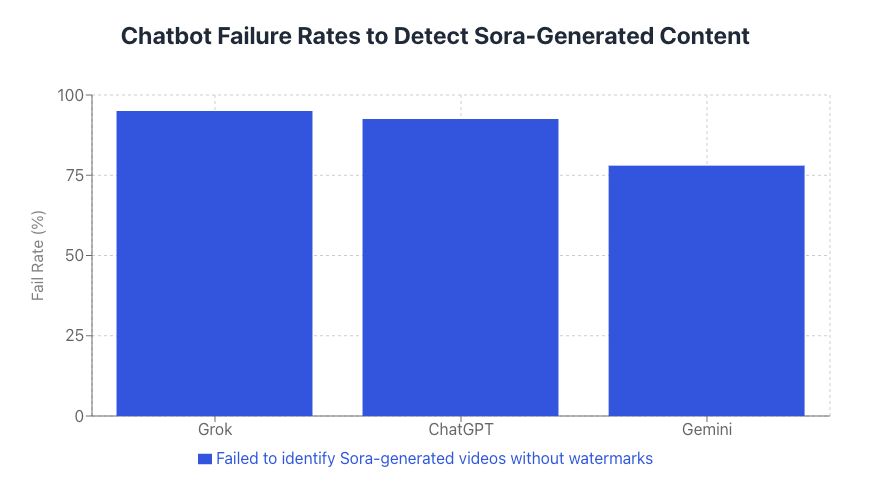

AI 聊天機器人辨識 AI 生成影片的能力,正在成為資訊安全與選舉公信力的關鍵議題。當深偽技術與文字轉影片模型愈來愈強大時,如果連 AI 聊天機器人本身都難以分辨 AI 生成影片與真實畫面,我們對「數位真相」的基本假設就必須全面重寫。 AI 聊天機器人為何難以辨識 AI 生成影片? 多數人直覺會以為:既然聊天機器人是 AI,理論上應該更懂得如何識破 AI 生成影片。事實剛好相反,現階段的主流程設計,主要是為了「理解與生成內容」,而不是為了「鑑定真偽」。 技術架構上的天生盲點 當前主流 AI 聊天機器人(包括 ChatGPT、Gemini、Grok 等)多半是: 以文字大型語言模型為核心 再疊加影像、影片理解能力,變成多模態模型...