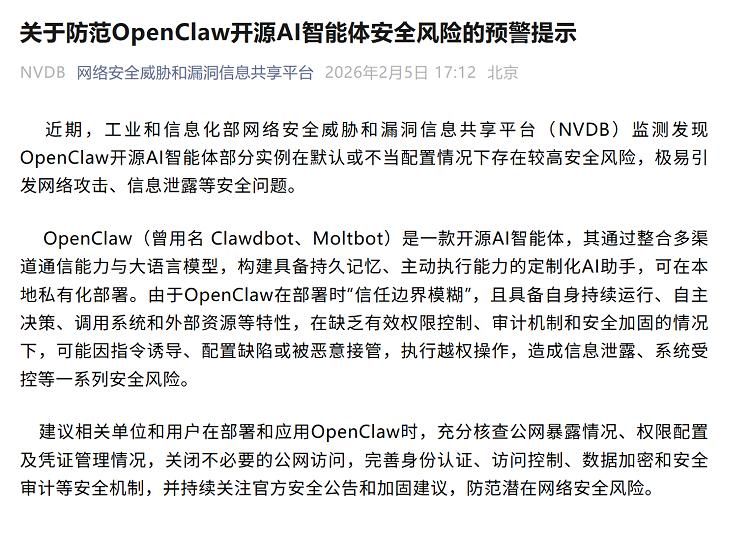

OpenClaw 被警示,問題不只在工具本身 開源 AI 智能體 OpenClaw 近日因配置風險受到官方安全警告,再次提醒市場一件常被低估的事:AI 系統的風險,很多時候不是模型能力本身,而是部署方式、權限設計與周邊元件的安全管理。 對許多企業來說,選擇開源智能體框架的原因很直接:可客製、可私有化、可降低授權成本,還能更快串接內部知識庫、工單系統、CRM、文件平台或自動化流程。不過,正因為這類系統通常需要接觸 API、資料庫、外部工具、執行環境與管理後台,一旦預設設定不當、驗證機制不足,或暴露了不該公開的服務介面,就可能把 AI 從提升效率的助手,變成內網風險的入口。 這次警示的價值,不在於單一專案是否要立刻停用,而在於它點出了當前企業導入 AI 智能體時最現實的盲點:很多團隊重視功能上線速度,卻沒有用同等標準檢查安全邊界。 為什麼 OpenClaw 這類開源智能體特別需要注意配置安全? OpenClaw 類型的工具通常不只是單純聊天介面,而是具有「代理執行」能力的 AI 系統。它可能具備以下特性: 可讀取本地或私有知識庫 可呼叫外部...

Claude Code Security 之所以引發討論,不只因為它把「AI 寫程式」拉進企業開發流程,更關鍵的是:它把資安從事後的掃描與稽核,往前推到「需求—撰寫—提交—部署」的每一步。 在過去,多數團隊依賴 SAST/DAST、依賴套件掃描、WAF 或雲端防護來補洞;但 AI 生成程式碼的普及,讓漏洞不再只是「工程師不小心」,而是「產出速度暴增、審查壓力倍增」。Claude Code Security 所代表的趨勢,是把安全規範、資料邊界與修補建議,直接嵌入 AI 輔助開發之中,形成「安全即預設值(secure by default)」的新工作方式。 從工具到流程:它在改變什麼? Claude Code Security 的價值通常不在「多一套掃描器」,而在於把安全決策前移並具體化: 在撰寫階段即提醒風險:例如輸入驗證、SQL/NoSQL 注入、XSS、SSRF、權限繞過、祕密金鑰外洩等,讓開發者在提交前就修掉。...