Sonnet 4.6:中型大模型躍升為主流 AI 助手的關鍵一役 Sonnet 4.6 的推出,不只是單純的模型升級,而是整個 Claude 生態系策略的又一次調整。對多數開發者與一般使用者而言,未來日常接觸到的 AI 助手,很大機率就是這個中型的 Sonnet 4.6,而不是最頂級的旗艦模型。 這樣的選擇背後,反映了生成式 AI 正走向「實用優先」的階段:速度、成本、可靠性與可控性,開始比「排行榜上誰最高分」更重要。 Sonnet 4.6 的定位:在效能與成本之間找到甜蜜點 Sonnet 系列一直被定位在「中型模型」,介於輕量的 Haiku 與頂級的 Opus...

AI slop 時代:當無臉 YouTube 頻道淹沒真正的使用者生成內容 在影音平台上,「AI slop」這個詞正快速竄起,用來形容大量低品質、沒有靈魂的 AI 生成內容。AI slop 不只是單純的 AI 影片,而是一整套靠演算法和自動化工具堆砌出來的內容生產模式,尤其在無臉 YouTube 頻道上特別猖獗。 這股潮流,正在改寫使用者生成內容的生態,也在悄悄改變你每天刷到的每一支影片。 什麼是 AI slop?從內容革命到內容污染 所謂 AI slop,可以概括為: 高度依賴生成式 AI...

人工智能(AI)已經不再只是工程師或研究人員的專利。無論你是上班族、學生、創作者,甚至只是單純對 AI 感到好奇,2026 年正是入門學 AI 的最好時機。 但問題是:👉 網上 AI 課程那麼多,新手應該從哪裡開始?👉 有沒有 不用寫程式、又免費、又講得清楚 的選擇? 以下精選 8 個真正與 AI 相關、而且適合入門新手的免費課程,涵蓋「AI 概念理解」、「生成式 AI 應用」、「ChatGPT 使用」、「AI 協作工作方式」等實用主題。 1️⃣...

德國慕尼黑地方法院在2025年11月11日作出一項備受矚目的判決,裁定OpenAI在未經授權的情況下,使用受版權保護的德國歌曲歌詞訓練其生成式AI模型ChatGPT,構成對版權法的侵犯。這項判決被視為歐洲首宗直接針對AI訓練與輸出內容的版權爭議案,為AI產業與版權持有者之間的法律界線帶來明確指引,也預示未來AI公司在歐洲市場的合規策略將面臨重大挑戰。 案件由德國主要音樂版權集體管理組織GEMA提出,指控OpenAI在訓練ChatGPT時,使用了包括「Atemlos」和「Wie schön, dass du geboren bist」等九首知名德國歌曲的歌詞。GEMA指出,只要使用者輸入簡單提示,ChatGPT便能完整輸出這些受保護的歌詞,顯示模型已將這些內容「記憶」並儲存於其參數之中。法院在審理後,認定這種「記憶化」(memorisation)行為已構成《德國著作權法》(UrhG)第16條所定義的「重製」行為,即使歌詞並非以傳統檔案形式儲存,而是以模型內部的統計參數呈現,仍屬於版權法規範範圍。 法院進一步指出,當ChatGPT將這些歌詞輸出給使用者時,屬於透過網路向公眾提供作品,構成《德國著作權法》第19a條及《歐盟資訊社會指令》(InfoSoc Directive)第3條所定義的「公開傳播」行為。這意味著,AI模型不僅在訓練階段可能涉及版權問題,其後續的輸出行為同樣需要取得授權。 在判決中,法院也明確駁回OpenAI主張的「文本與數據挖掘例外」(text-and-data-mining exception,TDM exception)適用性。根據德國《著作權法》第44b條,TDM例外僅允許為分析目的而製作的準備性複製,但一旦模型能重現受保護作品的實質內容,且影響權利人的合法經濟利益,便超出例外範圍。法院強調,AI模型的記憶與輸出行為已干擾權利人的商業利益,因此不能援引TDM例外作為免責依據。 此外,法院也拒絕OpenAI將責任歸咎於使用者的論點,認為AI平台營運商在模型架構與資料集選擇上具有主導權,應負起主要責任。判決結果包括要求OpenAI停止在德國境內儲存未經授權的德國歌詞,並須在當地報紙刊登判決內容,同時承認GEMA有權求償損害賠償或授權費用。雖然具體賠償金額尚未公布,但外界預期可能達到相當高的水準。 這項判決對AI產業的影響深遠。首先,它明確將AI模型的「記憶化」行為納入版權法規範,提高AI公司在資料來源與模型訓練上的合規門檻。其次,它強化了版權持有者在歐洲的執法能力,未來AI公司若想在歐洲市場營運,必須更嚴格審查訓練資料,並積極與版權集體管理組織協商授權。此外,判決也促使AI公司加強技術防護,例如去重複化(deduplication)、正規化(regularisation)、針對性防記憶技術,以及強化提示與輸出過濾機制,特別是針對短篇作品如歌詞與詩歌。 對於GEMA與其他版權集體管理組織而言,這項判決提供了雙重執法工具:不僅可針對訓練階段的記憶化行為提出主張,也能針對模型輸出的侵權內容進行追訴。然而,由於OpenAI已公開表示不認同判決結果,並考慮提出上訴,未來法律爭議仍可能持續,相關判例的發展值得持續關注。 總體而言,這項判決不僅是德國版權法的里程碑,也為歐洲乃至全球AI與版權的平衡帶來新的思考方向。AI公司必須重新評估其資料來源與模型設計,而版權持有者則獲得更強的法律武器,以保護其創作成果。 #OpenAI #GEMA #版權法 #AI訓練 #生成式AI

在 AI 大模型時代,OpenAI、Google DeepMind 等西方巨頭早已佔據全球視野,但 屬於中國、甚至能真正走向世界舞台的 AI 公司 卻也正在快速崛起。其中最受矚目的非 MiniMax 莫屬。一家成立短短四年、業務版圖跨越全球、並將於 2026 年 1 月在香港掛牌上市 的 AI 初創企業,它不只是中國本土科技發展的縮影,更可能成為 中國版 OpenAI 的核心代表。 一、MiniMax 是誰?一家不只「做模型」的 AI...

在生成式 AI 競賽持續升溫之際,GPT Image 1.5 圖像生成模型的推出,象徵 AI 圖像生成已從有趣玩具正式走向專業級「創意基礎設施」。對企業、創作者與開發者而言,這不再只是「能不能生成一張圖」的問題,而是「能不能穩定、快速、可控地把腦中的畫面變成資產」。 GPT Image 1.5:從文生圖玩具到專業級圖像生成模型 過去幾年,大多數 AI 圖像生成工具都有一個共同痛點:只要你下達第二次指令,整張圖幾乎會被「重繪」。這讓許多專業使用情境——品牌視覺、角色設計、商品攝影模擬——都難以真正落地。 GPT Image 1.5 的核心價值,就是試圖解決這個「無法穩定迭代」的問題,同時在三個關鍵面向上升級: 更精準的指令追隨能力 更細膩的局部編輯與視覺一致性 更快的圖像生成速度(官方宣稱可達數倍提升) 換句話說,它不只是「畫一張新圖」,而是「讓你有能力持續把同一個概念打磨成可用作品」。 精準指令與細膩編輯:創作者真正需要的不是「驚喜」,而是「可控」 對影像工作者來說,「可控」比「驚喜」更重要。GPT...

人工智慧(Artificial Intelligence, AI)經常被比喻為「文字計算機」(calculator for words),這個形容雖然形象,但其實存在相當大的誤解。此比喻本質上將AI視作一個純粹自動計算的工具,像是數學計算機般機械且無誤,然而事實卻遠比這複雜。AI,尤其是生成式AI(Generative AI),在自然語言處理與文本生成上的能力,更像是統計模式的高度模擬,而非簡單的數字運算,這牽涉到語言的概率與聯想網絡,而非單純的絕對正確答案。 首先,計算機運作基於明確、可預測的數學規則。當我們輸入888 ÷ 8,輸出必定是111,且無誤差。相較之下,生成式AI在產生文字時會根據大量語言資料訓練出的統計規律,來預測下一個最可能出現的詞語或片語,這導致其輸出深具人類語言的自然流暢感,但卻無法保證內容的事實正確性,且存在「幻覺」(hallucinations)的風險,即出現錯誤或虛構的資訊,而這是計算機所不曾有的現象。 這個差別關鍵在於,計算機產生的答案是唯一且準確,而生成式AI產生的內容是概率性的、不唯一的,甚至可能會帶有說服性與意圖,引發倫理與社會上的思考與挑戰。若將AI簡化為計算機式的工具,便忽略了它對資訊真偽的脆弱、對認知與判斷造成的影響,與其帶來的社會責任問題。這種認知上的簡化容易使人們對AI缺乏批判思考,忽略了AI在教育、傳播等領域的一些潛在風險。 語言本身具有高度的統計特性。人類在日常交談中,會不自覺地選用某些搭配詞彙(collocations),例如「鹽和胡椒」比「胡椒和鹽」更常見,人腦通過潛在的概率計算來判斷語言的自然性。生成式AI正是基於這種概率規律來模仿人類語言,因此即使它並非「思考者」或「夢想家」,仍能產出極具人類語感的語句,讓互動感覺自然且具情感色彩,這也解釋了為何AI的回答有時會讓人覺得「像人一樣」。 然而,這種「像人一樣」的流暢度並不代表AI具備真正的理解力或推理能力。AI缺乏意識、自我反思或價值判斷,所有的運作都是根據海量資料的統計分析。這與人類的思維方式截然不同,亦使得AI在面對未曾遇見過的情境時可能產生錯誤或誤導。因此,不能期待生成式AI能代替人類進行批判性思考和道德判斷。 在教育領域,AI引發了「工具與核心能力」的議題。以計算機為例,雖然計算機幫助學生快速完成數學計算,但若過度依賴會削弱基本算術能力,同理,若學生僅依賴AI生成文本而非自己思考,可能影響寫作與邏輯表達能力。因此,AI應被用作補充人類智慧的工具,幫助激發創意或提供初步構思,而非完全取代學生的學習過程。 從社會層面看,生成式AI的快速普及讓人們面臨「快速發展卻後果未明」的困境。雖然AI能降低部分工作負擔,提升效率,但同時也帶來錯誤信息傳播、認知偏誤與倫理風險。與計算機不同,AI公司與平台必須承擔更多的透明度、審核以及治理責任,確保AI系統的安全和公平使用。 總結來說,將生成式AI簡化成只是一台「文字計算機」並不準確。AI的運作基於大量的語言模型和機率運算,具備模擬人類語言的能力,但同時也帶有「幻覺」風險和倫理挑戰。理性看待AI,需要既看到其強大效用,也警覺其局限與潛在危害。對香港及台灣的讀者而言,理解這些特性有助於更有效地運用AI,避免盲目依賴,並促進更負責任的技術發展與教育規劃。 #人工智慧 #生成式AI #語言模型 #教育科技 #科技倫理

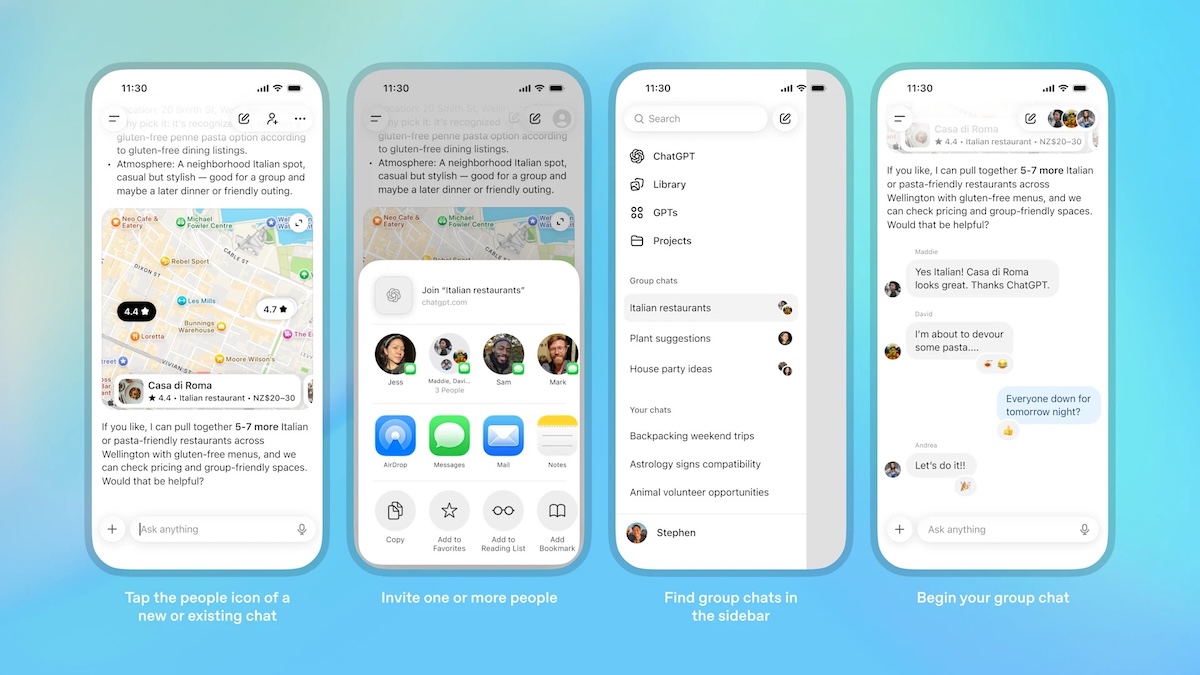

OpenAI 近期為 ChatGPT 推出了一項備受矚目的新功能——群組聊天(Group Chats),讓多人可以同時在同一個對話空間中與 ChatGPT 互動,大幅提升了團隊協作與日常溝通的便利性。這項功能目前已在台灣、日本、韓國及紐西蘭等市場率先試行,無論是免費版、ChatGPT Go、Plus 或 Pro 方案的用戶,都能在手機版與網頁版上體驗,而電腦版則尚未開放。這項更新不僅讓 ChatGPT 從過去的一對一助手,進化為多人協作的智慧夥伴,更為工作、學習與生活帶來全新的可能性。 群組聊天功能的核心在於「多人同步參與」。使用者可以邀請 1 至 20 人加入同一個聊天室,無論是與朋友規劃出國旅行、與同事討論專案進度,或是與家人共同決定晚餐菜單,都能在同一個空間中即時交流。ChatGPT 會根據對話情境,自動判斷何時出聲回應、何時保持安靜,避免訊息轟炸。若需要 ChatGPT 提供協助,只需在對話中提及「ChatGPT」或使用「@ChatGPT」,系統便會立即回應。這項設計讓 AI 的參與更自然,也更符合真實的群體溝通節奏。 在技術層面,群組聊天的回應由...

OpenAI近期公佈了一項驚人的里程碑:其平台API使用的總token數量超過了一兆,一個具有指標意義的數字,彰顯了全球企業對生成式人工智能(Generative AI)解決方案的極大依賴與信任。這次的公告不僅揭示了OpenAI技術生態的快速擴張,也點出了一批在此過程中扮演關鍵角色的30大重度用戶企業,這些企業都達到了超過一兆token的使用量級,足見其AI應用的深度與廣度。 在這30家“超級用戶”企業中,涵蓋了多個行業與知名品牌,從教育、科技、電商、金融到人力資源,展現了AI技術的多元化應用。諸如Salesforce、Shopify、Canva和HubSpot等企業,憑藉其強大的業務系統與數據處理能力,使得AI成為提升效率與創新競爭力的重要武器。例如,Salesforce利用OpenAI的API為客戶服務平台導入智能聊天機器人、自動化銷售分析等功能,顯著降低了人力成本並提升即時互動品質。 此外,教育科技領域的Duolingo也名列此榜,作為語言學習平台,Duolingo透過大量自然語言處理(NLP)token的使用,持續優化語言學習體驗,做到因材施教和實時互動,這為用戶創造了更加沉浸且個性化的學習流程。零售與電商巨頭Shopify則積極將AI應用於優化客戶推薦與庫存管理,大幅提升訂單轉換率和顧客滿意度。這些企業不僅從技術層面帶來突破,更實質性地影響了消費者日常生活與商業操作。 OpenAI為了表彰這些在token數量突破重要門檻的企業和團隊,推行了名為“Tokens of Appreciation”的獎勵計劃。例如,當企業的API使用量達到10億、100億乃至100萬億token時,OpenAI會授予象徵性的實體獎牌,以鼓勵與肯定其對AI生態系統的貢獻與投入。這不僅是對企業技術運用規模的認可,同時也象徵著AI應用在商業領域內的普及及高效。 這一兆token的意義不僅是技術數據的累積,更代表了生成式AI在風起雲湧的數位時代中,如何成為推動業務升級與創新的核心引擎。根據OpenAI執行長Sam Altman在周年慶典上的致辭,此成就象徵了數以百計的團隊和開發者共同奮鬥的成果,也標誌著AI從理論走向大規模商用的歷史性飛躍。 對於華語市場,尤其是香港和台灣的企業而言,此消息昭示著未來的AI採用趨勢與市場機會。隨著API使用量的指標性增長,多元化AI服務的落地將成為企業必須跟進的趨勢。利用OpenAI平台的強大計算及語言生成能力,企業可在客戶服務、內容創作、數據分析及自動化運營中取得顯著優勢。面對全球經濟數位轉型,積極擁抱與整合生成式AI的策略將是提升競爭力的重要途徑。 綜合來看,此次公佈的30大用戶清單,不只是數據背後的冷冰印記,更是生成式AI被實際應用於解決複雜問題、推動產業創新的最佳例證。這些企業依托於OpenAI的技術,打造出多樣且高效的AI應用場景,促使整個生態系呈現出勃勃生機。未來,隨著技術的進一步提升與深化,生成式AI的影響力將更全面且深遠,繼續驅動全球數字經濟的蛻變與成長。 #AI技術 #OpenAI #生成式人工智能 #企業數位化 #API應用

Deloitte 正面迎接 AI 的機遇與挑戰 引言 隨著人工智慧(AI)的快速發展,各大企業正積極探索其應用潛力。Deloitte,一家著名的管理顧問公司,正全力投入 AI 的研究和應用。雖然 Deloitte 曾因使用 AI 寫作出現問題而遭遇挫折,但這並未阻礙其在 AI 領域的進一步發展。事實上,這次事件更被視為企業界對 AI 使用的警示和學習機會。 AI 的商業應用挑戰與機遇 如今,AI 已成為企業戰略中的重要組成部分。Deloitte 的調查顯示,許多企業領導者認為 AI 對於企業成功至關重要。然而,實際上只有少數企業成功地將 AI...

可口可樂(Coca-Cola)於2025年推出全新假日全球廣告活動,以嶄新的AI科技結合溫馨敘事,向辛勤付出、默默無聞的節日幕後工作者致敬。該活動命名為「Refresh Your Holidays」,透過三支主要影片展現節慶氛圍,深化人與人之間的真誠連結,將聖誕季節的忙碌轉化為歡樂與感動的時刻。 此次活動的影片包含全新故事《A Holiday Memory》,以及兩支基於1995年經典廣告《The Holidays Are Coming》的AI重製版。這些影片不僅帶來懷舊氛圍,也融合前沿生成式人工智能(Generative AI)技術,實現前所未有的創作自由與精準視覺呈現。尤其在《A Holiday Memory》中,故事焦點是一位忙碌的母親在準備節日慶典過程中,透過一瓶冰涼的可口可樂及一個神奇的裝飾品,重新找回節日的精神內涵,觸動觀眾的情感共鳴。 值得一提的是,Coca-Cola再次啟用其標誌性的聖誕卡車造型,並通過AI技術重新塑造,展現節日氣氛與視覺魔力。這一創新由美國舊金山的Secret Level和Silverside AI兩家工作室協力完成。AI技術不僅精準重現經典畫面,更引入真實物理動態與電影鏡頭語言,讓視覺與敘事達到高度協調,迎合不同市場與目標族群的觀影需求。 Coca-Cola強調,運用AI不取代人類創意,而是在創作流程中賦予創作者更大自主權與創新空間。全球生成式AI副總裁Pratik Thakar表示,品牌利用先進的生成式AI,從攝影構圖、物理真實感到敘事節奏全方位把控,推動傳統製片技術的革新,這不僅是電影製作,更是創意與技術的未來革命。 除了影片以外,Coca-Cola 2025年假日活動還重啟沉浸式體驗,聖誕卡車巡迴世界各地社區,讓消費者親身感受節日氣氛,進一步強化品牌與社群的情感連結。此舉延續品牌多年來以節慶作為核心,成功塑造深植人心的經典形象。 分析指出,Coca-Cola透過結合AI技術與經典故事講述,既保留品牌的溫度與回憶,也順應數位創新的潮流,成功將傳統節日廣告提升到新高度。尤其在亞洲及北美市場,這種結合科技與人文的廣告策略預計將有效促進消費者參與感及品牌好感度。 總體而言,Coca-Cola 2025年節慶廣告展現了品牌如何在數位時代運用尖端技術,為觀眾帶來既熟悉又充滿驚喜的視聽饗宴,強調節日背後那群無名英雄的付出,使品牌故事更具深度與感染力。這樣的創新配置不僅展示了未來廣告製作的可能性,也為品牌與消費者建立了更加持久而有意義的連結。 #CocaCola #AI廣告...

OpenAI 於2025年首次公開了關於 ChatGPT 用戶行為的龐大數據分析,這項全球規模最大的生成式 AI 使用研究涵蓋了2024年5月至2025年6月期間,逾百萬名用戶的匿名互動紀錄,揭示了生成式 AI 如何在日常生活、產業應用及教育領域深刻影響用戶行為與需求。這份報告的關鍵洞察不僅反映技術進步,更成為台灣及香港企業推動數位轉型、以及提升 AI 素養教育的寶貴指標。 nn首先,ChatGPT 用戶人數規模驚人,至2025年7月,周活躍用戶已達7億,每週訊息量達180億條,呈現由小眾技術轉向大眾工具的躍遷現象。在用戶結構上,女性用戶比例已從2024年初的37%躍升至2025年中超過一半(52%),而低收入國家用戶的增長速度是高收入國家的四倍以上,顯示生成式 AI 正以極快速度普及於全球不同經濟層次的市場。 nn從使用類型分析,約75%的對話內容圍繞實用指導、資訊搜尋與寫作協助,其中特別突出的是寫作輔助功能,佔工作相關訊息的40%。且約三分之二的寫作需求並非完全從零開始創作,而是以修改或優化用戶原本文本為主,這顯示 ChatGPT 在提升工作效率及內容品質上扮演重要角色。 nn這份研究亦深入比較不同職業及教育背景用戶的使用習慣,發現無論是研究生學歷與否,亦無論職業類別,決策支持和問題解決始終是最常見的核心工作應用。具體來說,研究生學歷者提出問題的比例比學士學歷以下用戶高出約2個百分點;此外,計算機相關職業的工作訊息中高達47%是提問形式,明顯高於非專業職業的32%。這反映生成式 AI 在協助專業人士做決策與分析上具備強勁的價值。 nn經濟學家的研究還強調,生成式 AI 所帶來的福利效益巨大。非工作用途已超過70%且持續快速成長,顯示 AI...