企業 AI 代理管理平台正在成為新一代企業數位轉型的核心關鍵。對想要系統性導入生成式 AI 的組織而言,光有大型語言模型不再足夠,真正的戰場已經移轉到「如何建構與管理 AI 代理」這一層基礎設施。 企業為何需要 AI 代理管理平台? 過去兩年,多數企業導入生成式 AI 的方式,大多停留在聊天機器人、問答助理或單一流程自動化工具。這些應用固然有價值,但難以在全公司規模上真正改變工作方式。AI 代理管理平台的出現,正是為了解決這個瓶頸。 一個成熟的企業級 AI 代理管理平台,至少要做到: 讓企業能批量建立、部署與維運多個 AI 代理 統一控管這些代理能存取的資料與系統 監控、追蹤、調整代理行為與績效 與既有 IT、雲端與安全架構順暢整合...

用AI出貓正迅速成為香港學界的新難題,尤其在口試與寫作評核上愈演愈烈。當學生利用生成式AI寫演講稿、作文甚至整份報告時,老師與同學面對的,不只是一次單純的作弊事件,而是一場關於信任、公平與教育方向的大考驗。 為何學生愈來愈傾向用AI出貓? 在不少家長和老師眼中,「用AI出貓」似乎難以理解,但對學生來說,這往往只是「順手一試」的選擇。背後有幾個關鍵原因: 工具極度易得:智能手機、平板、家中電腦隨處可見,只要輸入題目,AI便能在幾秒內生成完整演講稿或文章。 學業與評分壓力沉重:呈分試、升中派位、校內排名等壓力,令部分學生寧願鋌而走險,以「靚分數」為首要目標。 對AI出貓的道德感模糊:不少學生會認為:「我只是用AI幫手改寫,不算抄襲。」這種灰色地帶令紀律教育更具挑戰。 家長與老師對AI理解不足:成年人本身對AI工具的掌握有限,更難向子女清楚解釋「何謂合理使用、何謂作弊」。 當上述因素交織,「用AI出貓」便從個別學生的秘密行為,逐漸變成班級之間口耳相傳的小道「攻略」。 口試與演講評核:AI出貓最易「出事」的場景 語文說話評估、演講考試,本來是要測試學生的語言組織、即場表達與臨場反應。但在AI盛行的年代,以下幾個風險急速上升: 有學生提早得知題目,用AI生成完整演講稿再背誦。 有學生在候考期間偷用手機,輸入題目後即時取得「完美稿」。 老師若未有嚴密監察與清楚規範,很難第一時間察覺內容是否「人手」或「AI製造」。 一旦有人用AI出貓被揭發,學校為維持評核公平,很可能只能選擇「全班重考」。在未有成熟處理機制之前,這種集體後果往往會產生幾重副作用: 守規矩的學生感到極度不公平 班級氣氛轉趨緊張與對立,互相猜疑 家長對學校判斷與安排提出質疑 這些看似只是一宗學校紀律個案,其實折射出整個制度對AI時代準備不足的脆弱。 AI出貓與傳統作弊有何不同? 有人會問:用AI出貓,不就是另一種「抄答案」嗎?事實上,兩者有幾個關鍵差異: 1. AI是「隱形槍手」 傳統作弊常見的是: 把小抄帶入考場...

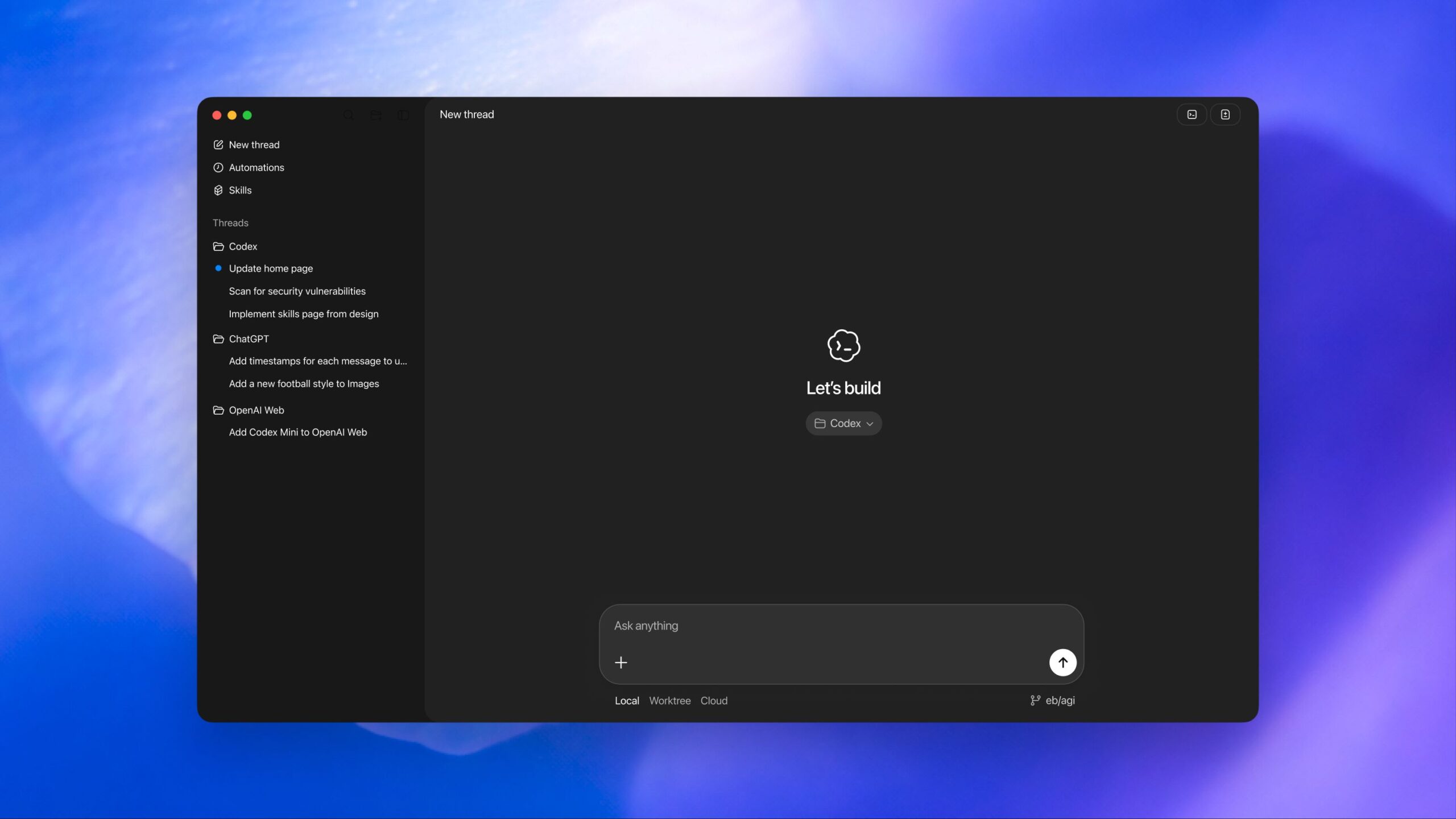

OpenAI Codex 應用程式一週破百萬下載:AI 程式碼生成的臨界點 OpenAI Codex 應用程式在上線首週就突破一百萬下載,凸顯 AI 程式碼生成工具已從實驗玩具,正式躍升為主流開發者工具。對於軟體產業來說,這不只是亮眼的下載數字,而是一個象徵:開發流程正在被 AI 重寫。 在這個關鍵時刻,理解 OpenAI Codex 應用程式為何能爆發式成長、它如何改變開發者生態,以及企業應該採取什麼策略,就成了每一位技術主管與工程師無法忽視的課題。 為何 OpenAI Codex 應用程式能在一週內衝上百萬下載? AI 輔助開發工具並非新概念,但 OpenAI Codex 應用程式的爆發,代表幾股力量同時到位。...

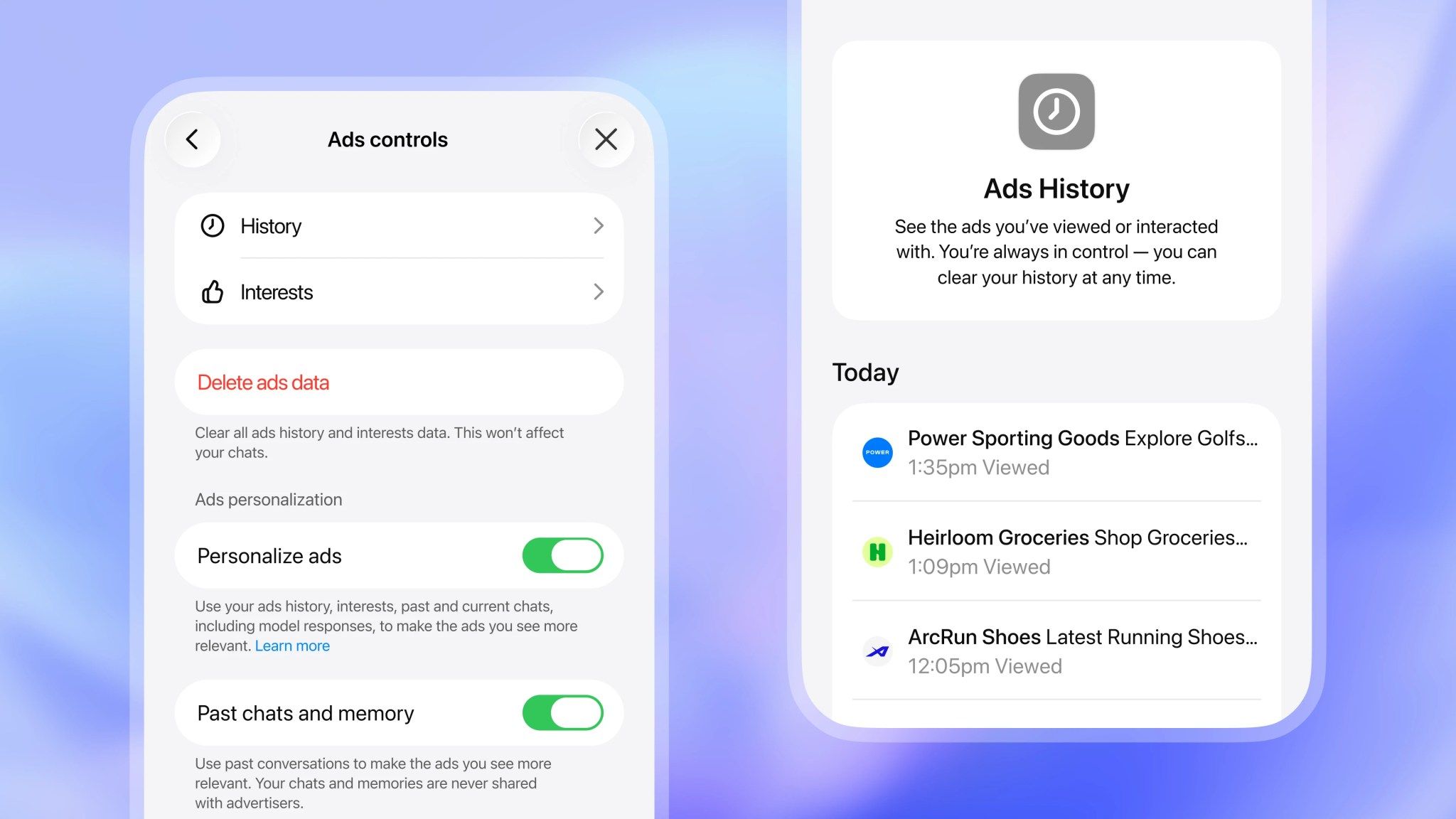

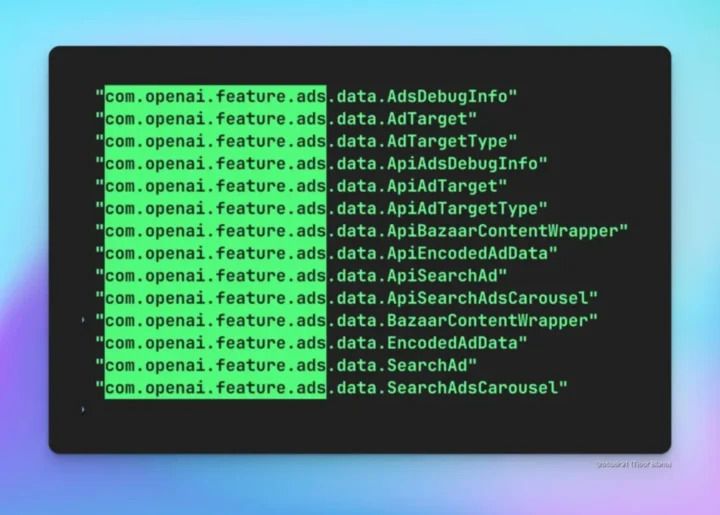

當 ChatGPT 廣告 正式出現在對話介面裡,生成式 AI 的商業模式也邁入了全新的階段。對使用者、品牌與整體數位廣告產業而言,這不只是介面多了一塊「贊助內容」,而是關於信任、隱私與權力分配的大型實驗。 ChatGPT 廣告是怎麼推出的? 目前廣告首先鎖定美國的免費方案與低價訂閱層級,較高階的付費方案則暫時不顯示廣告,形成「付費免廣告、免費看廣告」的典型分層模式。 平台同時宣稱幾個關鍵原則: 廣告不會影響 ChatGPT 回答內容 廣告會被清楚標示為「贊助」或類似標記 廣告與「自然回答」在版面上有視覺區隔 廣告主只會看到彙總的成效數據,而非個別對話內容 這些設計,目的在降低「演算法被廣告商買走」的疑慮,維持 ChatGPT 作為問答工具的基本信任。 為什麼 ChatGPT 需要廣告? 生成式 AI...

在過去一年,AI 程式代理的演進速度遠超多數開發者的想像,而「代理式程式開發(agentic coding)」正成為關鍵字。隨著 OpenAI 在 macOS 推出全新的 Codex 應用程式,代理式程式開發不再只是概念,而是直接落地到開發者每天打開的桌面環境。 什麼是「代理式程式開發(agentic coding)」? 傳統的 AI 程式工具,多半停留在「自動完成」與「聊天問答」階段,本質上仍是輔助型工具;代理式程式開發則不同,它強調的是「可自主執行任務的程式代理(AI agents)」。 在代理式程式開發中: 開發者描述目標(例如:為專案新增一個登入流程) AI 程式代理會自己: 理解既有程式碼結構 查詢相關 API 或範例 寫出多個檔案、修改設定、執行測試...

生成式 AI 時代的「ChatGPT 廣告」難題:便利、金錢與信任的三角拉扯 生成式 AI 正在成為新一代網絡入口,而「ChatGPT 廣告」這個關鍵字,已經不再只是遙遠的想像。當聊天機械人從實驗玩具變成日常基礎設施,如何變現、是否應該加入廣告,以及廣告會如何改變我們獲取資訊的方式,正在成為產業與用戶都無法迴避的現實問題。 ChatGPT 廣告:從理想訂閱制走向混合模式 早期的生成式 AI 服務,喜歡把自己包裝成「高級訂閱工具」: 你付月費,我給你乾淨、不被廣告干擾的體驗。 但隨著模型變大、用戶暴增、雲端運算與 GPU 成本居高不下,單靠訂閱費支撐一切變得愈來愈困難。 於是,以下幾個現實因素開始推動「ChatGPT 廣告」模式浮上檯面: 推理成本(Inference cost)仍非常昂貴:每一次對話背後都是大量運算,即使成本逐年下降,用戶一多仍然是天文數字。 免費用戶占比高:多數人習慣免費使用,真正願意付費的比例往往只是少數菁英或重度使用者。 投資人期望現金流:燒錢換增長可以撐一陣子,但不能永遠,最現實的收入模式仍然是廣告與電商分成。 結果是:...

人工智慧正從螢幕裡走出來,下一個戰場是 AI 硬體,而「OpenAI AI 筆」無疑成為最受矚目的想像之一。當語言模型已足夠強大,真正的問題變成:我們將如何「握住」這種智慧,讓它自然地融入日常生活? 為什麼 AI 硬體會選擇「筆」這個形態? 在眾多 AI 硬體形態中,AI 筆看起來或許不起眼,卻極具戰略意義。筆是一種跨語言、跨世代的通用介面:學生、設計師、經理人都習慣拿筆,這讓 AI 筆一出生就擁有極高的行為相容性。 與其再發明一台需要學習的新設備,不如讓 AI 直接附著在我們已熟悉的動作上: 書寫 圈選 劃記 簽名 當這些動作都能被 AI 即時理解、轉寫、整理並回饋,AI...

真人社群媒體正成為科技業下一個高風險賭注。當充斥機器人帳號與假內容的社群平台逐漸失去信任,主打「只允許真人」的新一代社群服務,開始被視為重建網路信任的可能解方。 為何「真人社群媒體」突然變得重要? 近兩年,社群平台正面臨三個同時惡化的問題: – 機器人帳號與假帳號失控成長 – 由 AI 生成的內容難以分辨 – 使用者對演算法與平台決策的信任急速下滑 傳統做法多半只是強化「風紀股」功能:下架內容、封鎖帳號、要求手機號碼與電子郵件驗證。但在生成式 AI 爆發後,這些手段已越來越無力。只要能買到一批門號或簡訊服務,機器人帳號就能源源不絕地被自動建立。 因此,「真人社群媒體」的核心不再是調整演算法,而是換一個根本邏輯: 不是問「這則貼文真的假的?」而是先問「發文的到底是不是人?」 生物特徵驗證:從「是真人」開始的社群設計 為了實現只允許真人的社群平台,最直接的技術路徑就是「生物特徵驗證」。也就是以人的臉部、虹膜等不可輕易複製的特徵,作為「這是一個真實個體」的憑證。 與傳統社群平台相比,兩者的邏輯差異明顯: 傳統社群平台 依賴手機、電子郵件、裝置指紋、行為模式 認證的是「一組帳號是否看起來像正常使用者」 容許一個人持有多個帳號,甚至完全匿名 真人社群媒體...

人工智慧與太空科技的估值戰正進入白熱化階段,而 SpaceX 估值 8000 億美元 的傳聞,無疑把這場新創競賽推向高潮。當一家公司還未上市卻被市場視為價值高達數千億美元時,我們看的不只是數字,而是資本市場對未來科技權力版圖的押注。 SpaceX 估值 8000 億美元:不只是數字遊戲 市場傳出,SpaceX 正啟動新一輪二級股權出售,目標估值上看 8000 億美元,意圖重奪「全球最有價值未上市科技公司」的頭銜。這個數字幾乎等同於一家超大型上市科技巨頭,卻發生在仍屬私人持有的新創身上,極具指標意義。 為何這個估值如此關鍵? 它意味 SpaceX 可能超越 OpenAI,成為全球最受矚目的未上市企業 它重新界定了太空科技在資本市場中的地位,不再只是「燒錢夢想」,而是可被視為現金流與網路基礎建設公司 它向全球投資人釋出信號:前沿科技(AI、太空、國防、深度科技)正在取代傳統網路平台,成為估值新高地 值得注意的是,這類估值往往不是透過傳統 IPO 定價,而是透過內部股份或二級股權出售在非公開市場形成。也因此,它同時帶有價格發現與市場行銷的雙重功能。...

AI 安全準備正在成為生成式 AI 時代最關鍵的議題之一。當大型模型能力急速提升,企業開始意識到,沒有「AI 安全準備」的治理架構,商業野心隨時可能被安全事件與公關風暴吞噬。 為何 AI 安全準備升級為高階主管職位? 當一家領先的 AI 公司公開對外招募「Head of Preparedness(準備度負責人)」這樣的高階主管時,真正釋放出的訊號是: AI 風險不再只是法遵或研究部門的小題目,而是攸關企業存亡的核心戰略。 這類職位的核心任務,通常涵蓋: 盤點前沿 AI 能力帶來的新型風險 從電腦安全到生物風險建立跨領域風險地圖 持續監測模型是否開始展現自我改進、自我強化等高風險跡象 評估 AI 對使用者心理健康與社會穩定的潛在衝擊...

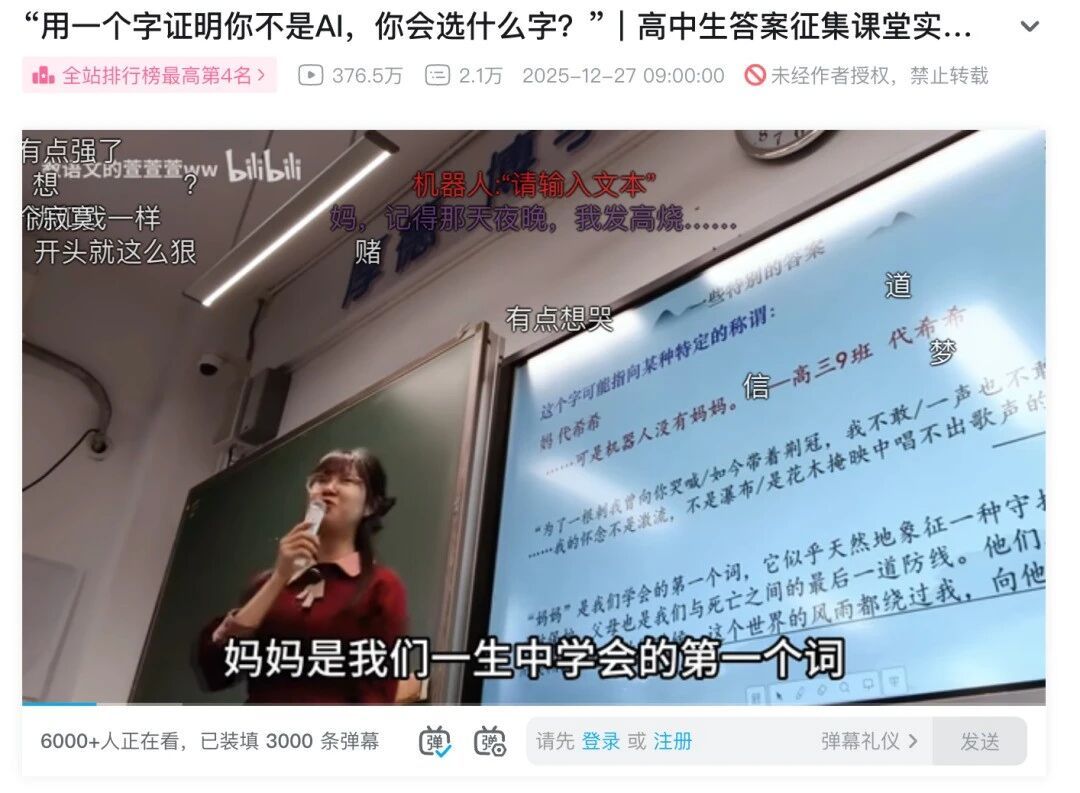

在生成式人工智慧快速滲透的今天,「用一個字證明你不是AI」這樣的提問之所以在網路上流傳,背後其實是我們對人性價值的集體焦慮與追問。當你認真思考要選哪一個字,等於在重新界定:在人與AI之間,什麼才是真正不可被複製的差異。 用一個字證明你不是AI:為何這個提問刺中人心 從語文課、社群平台到各種討論場合,「用一個字證明你不是AI」迅速變成一種時代小測驗。它看似遊戲,卻有幾個關鍵特點: 逼你在最小單位里,濃縮對「人」的理解 不是問專業技能,而是問情感與存在 不是考知識,而是考生命經驗 真正有趣的是,人們給出的字,往往不是「智」「算」「腦」這類和能力相關的詞,而是圍繞情感、關係、時間感與不完美展開。這本身,就是對AI時代最溫柔也最倔強的回應。 人類與AI的差異:不在算力,而在人性的重量 AI可以在幾秒鐘完成寫作、翻譯、繪圖,甚至模仿人的語氣與風格,但它依然缺少幾個關鍵維度: 害怕失去的恐懼 無法預測的情緒起伏 因牽掛而被拉長的時間感 為了毫無功利的理由而停下腳步 當人們試圖用一個字證明自己不是AI時,真正被強調的,往往不是高效,而是那種「明明低效、卻又無可替代」的人性。 「媽」:被守護與面對死亡的勇氣 很多人第一反應會選「媽」這個字,理由看似簡單:AI沒有媽媽。但這個選擇其實指向更深的東西—— 第一個喊出口的稱呼,往往連結著安全感 父母像是一道擋在我們與死亡之間的防線 當那道防線不在,人開始真切面對有限的人生 AI不會在醫院病房門外徹夜守候,不會在父母老去時被迫學會堅強。血緣、依戀、失去,構成了人類情感最深的斷層線,也勾勒出「媽」字背後難以言說的重量。 這種重量,無法用任何演算法訓練出來,只能靠一次次真實的心痛積累。 「急」與「慢」:人類對時間的主觀拉扯 如果要再用一個字證明你不是AI,有人會選「急」。例如: 在醫院等待檢查結果時,每一分鐘都像被拉長...

生成式 AI 正在快速滲入搜尋、辦公、購物與娛樂服務,然而真正該被討論的,是「AI 廣告攔截器」何時出現,而不是哪個聊天機器人最聰明。當 AI 廣告與個人化推薦緊密綁在一起,誰能替使用者擋下不透明的商業影響力,將成為 2026 年之後的關鍵議題。 大模型燒錢現實:AI 廣告為何幾乎無可避免? 生成式 AI 看起來像雲端服務,但本質更接近「隨用隨燒」的超級電廠。每一次提問背後,都對應到昂貴的 GPU、龐大的電力與資料中心維護成本。 過去兩年,產業一度相信: – 用戶訂閱制(例如每月固定付費) – 企業 API 計價 可以支撐大多數生成式 AI 的營運。但很快就發現幾個殘酷事實:...