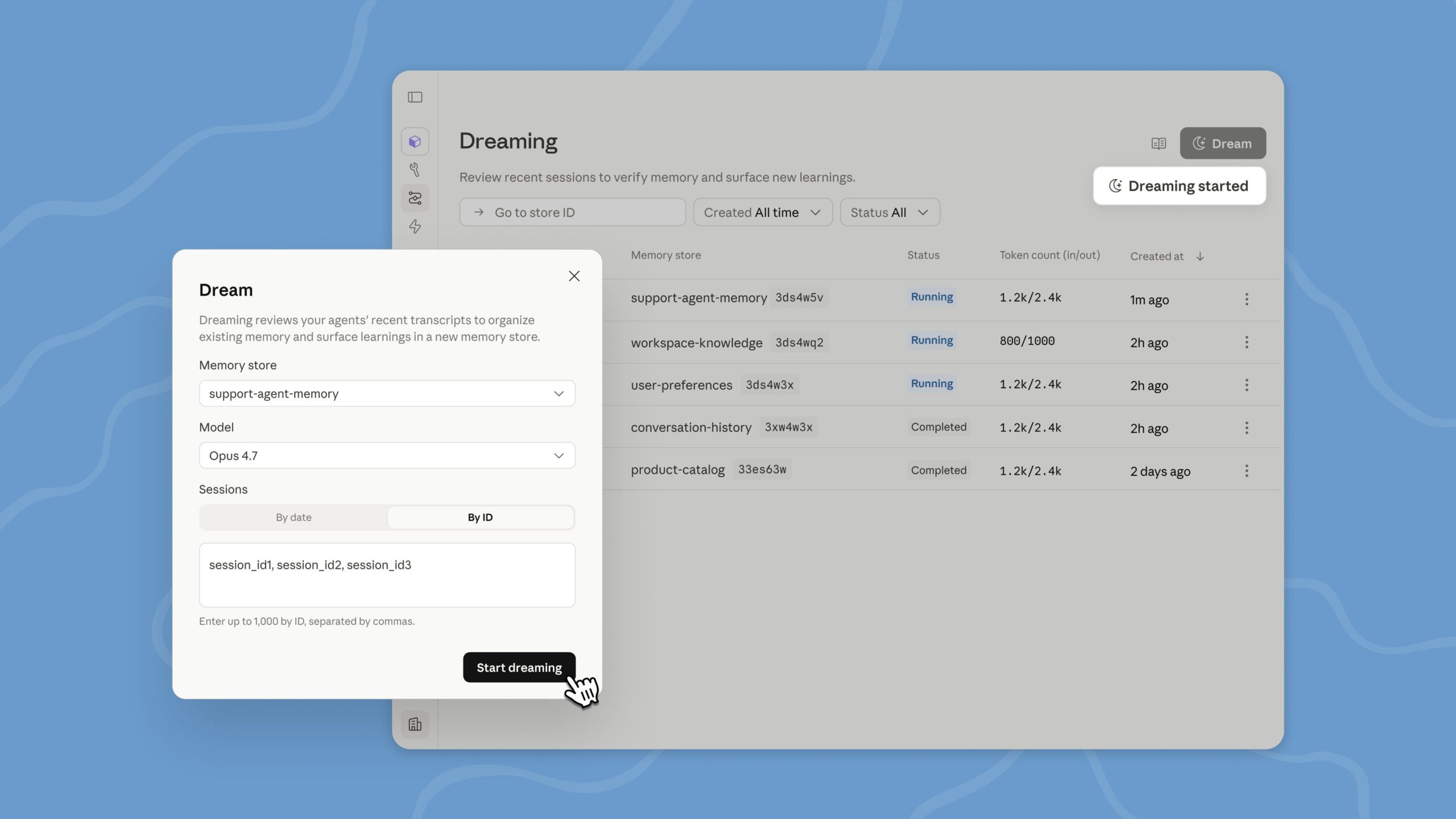

Anthropic 最近做了一件聽起來很科幻、但實際上非常務實的事:他們教 Claude 學會「做夢」。 不是真的讓 AI 像人類一樣作夢,而是讓 Claude 在任務間的空檔,自動對自己的記憶進行重新整理、歸檔、壓縮與重組。這個機制在內部被稱為 Dreaming,目的是解決大型語言模型在長時間工作中最常碰到的問題——上下文混亂、記憶錯位、決策退化。 而目前看到的測試結果,確實值得認真看待。 Claude「做夢」到底在做什麼 簡單來說,Dreaming 不是讓 Claude 去幻想或創作,而是讓它在沒有新指令的短暫空閒時段中,對自己剛才處理過的資訊做一次「內部清理」。它會做三件事: 壓縮記憶:把冗長但不再需要的對話歷史或中間步驟摘要化,不再佔據有限的上下文權重空間。 重新標記重要資訊:判斷哪些資訊對後續任務真正關鍵,並提升它們在記憶中的優先級。 修復邏輯不一致:如果 Claude 在過程中留下互相矛盾的判斷或輸出,它會趁機修正,避免後續出錯。 這不是一個背景批次進行的流程。Dreaming 是高度動態的,每次「夢」都是根據當前的任務情境與記憶結構即時產生的。換句話說,它不是在跑一個固定的腳本,而是像人類在睡前回想今天發生的事一樣,有選擇性地、有結構地重組資訊。 為什麼「自動整理記憶」反而更可靠...