Anthropic 推出 Claude Opus 4.7,把重點放在「更可靠地完成複雜任務」:推理、編碼、視覺理解與指令遵循都宣稱再進化。對企業與開發團隊來說,最重要的不是口號,而是:你能不能用可量化的方式,驗證它真的更好用、且更好控。

在 Opus 4.7 之前,Anthropic 已經用 Claude 3.7 Sonnet 打出「混合推理」與更強的工程協作(例如可在 API 控制思考時間、以及終端機導向的 Claude Code)這條路線,並在 SWE-bench 等測試上獲得相當亮眼的成績與討論度(例如報導提到 SWE-bench 70.3%)developer.cloud.tencent.com。Opus 4.7 若定位在更高階的旗艦能力,接下來就該用更嚴格的 KPI 來看它的「升級含金量」。

把「升級」變成可驗證:三類指標,最能看出 Opus 4.7 的差異

1) 推理能力:看「答對」之外,更要看「穩定度」

推理升級常見陷阱是:單次看起來很強,但換一種問法就崩;或是會答、但不會自我校正。要量化 Opus 4.7 的推理進步,建議你用兩層指標:

- 正確率(Accuracy):挑你業務最在意的題型(規則推導、表格決策、條款比對、跨段落推論),建立小型題庫做 A/B。

- 一致性(Consistency):同一題以 3~5 種問法重測,計算答案一致比例;再加入「提供反例」或「要求列出假設」的指令,看它是否會自我修正。

實務上,推理升級帶來的最大影響不只是更會解題,而是:你可以用更少的提示詞補丁(prompt patch),讓模型在流程裡更穩定地跑完。對客服、法遵、內控或報表自動化特別有感。

2) 編碼能力:用「專案修 Bug」而不是只看寫片段

如果 Opus 4.7 的編碼升級是真的,最應該反映在「貼近真實工程」的任務上,而不只是生成一段看起來像樣的程式碼。

可量化的三個方向:

- 修 Bug 成功率:用你們過去的 issue/PR(可匿名化)建立回放集,測「一次就修對」的比例。

- 測試通過率:同一任務輸出後直接跑單元測試/整合測試,記錄通過率與修正輪數。

- 變更風險:比對修改範圍(diff 大小)、是否動到不該動的檔案、是否引入相依性問題。

你也可以把 SWE-bench 這類基準測試視為參考座標:先前 Claude 3.7 Sonnet 的 SWE-bench 成績被多篇報導引用,顯示 Anthropic 很重視「能修真實專案問題」的敘事developer.cloud.tencent.com。Opus 4.7 若要證明旗艦價值,最好也能在同類任務上展現更高的可交付性(可在你自己的 repo 上做內部基準)。

應用面:

– 開發者:把 Opus 4.7 放在「需求釐清→產生測試→實作→自我檢查」的鏈條裡,而不是只當 autocomplete。

– 產品/技術 PM:用它做「規格轉驗收測試案例」與「風險清單」,可直接量化產出(案例覆蓋率、缺漏率)。

3) 視覺理解與指令遵循:用「看懂+照做」的合格率

多模態真正難的是:模型看得懂圖片,但最後沒有照你的規則輸出(格式錯、漏欄位、忽略限制)。因此建議把視覺與指令遵循一起測。

你可以用三種常見素材建立測試集:

- 截圖類(後台、App、錯誤訊息):要求它指出 UI 元件、重現步驟、產出可直接貼到 Jira 的工單格式。

- 文件/表格/圖表:要求它抽取欄位並輸出 JSON/CSV,測「欄位正確率」與「格式合規率」。

- 流程規範圖(架構圖、流程圖):要求它依照規範生成 checklist 或 SOP。

量化指標建議用:

– 抽取正確率(例如欄位比對)

– 格式合規率(JSON schema / 正規表示式驗證)

– 違規率(明確要求不做的事是否仍做了,例如不可外洩個資、不可臆測)

這會直接影響「能不能把 Opus 4.7 放進半自動/全自動流程」。因為只要格式不穩、指令不聽話,你的下游系統(資料庫、工單、RPA)就會頻繁出錯。

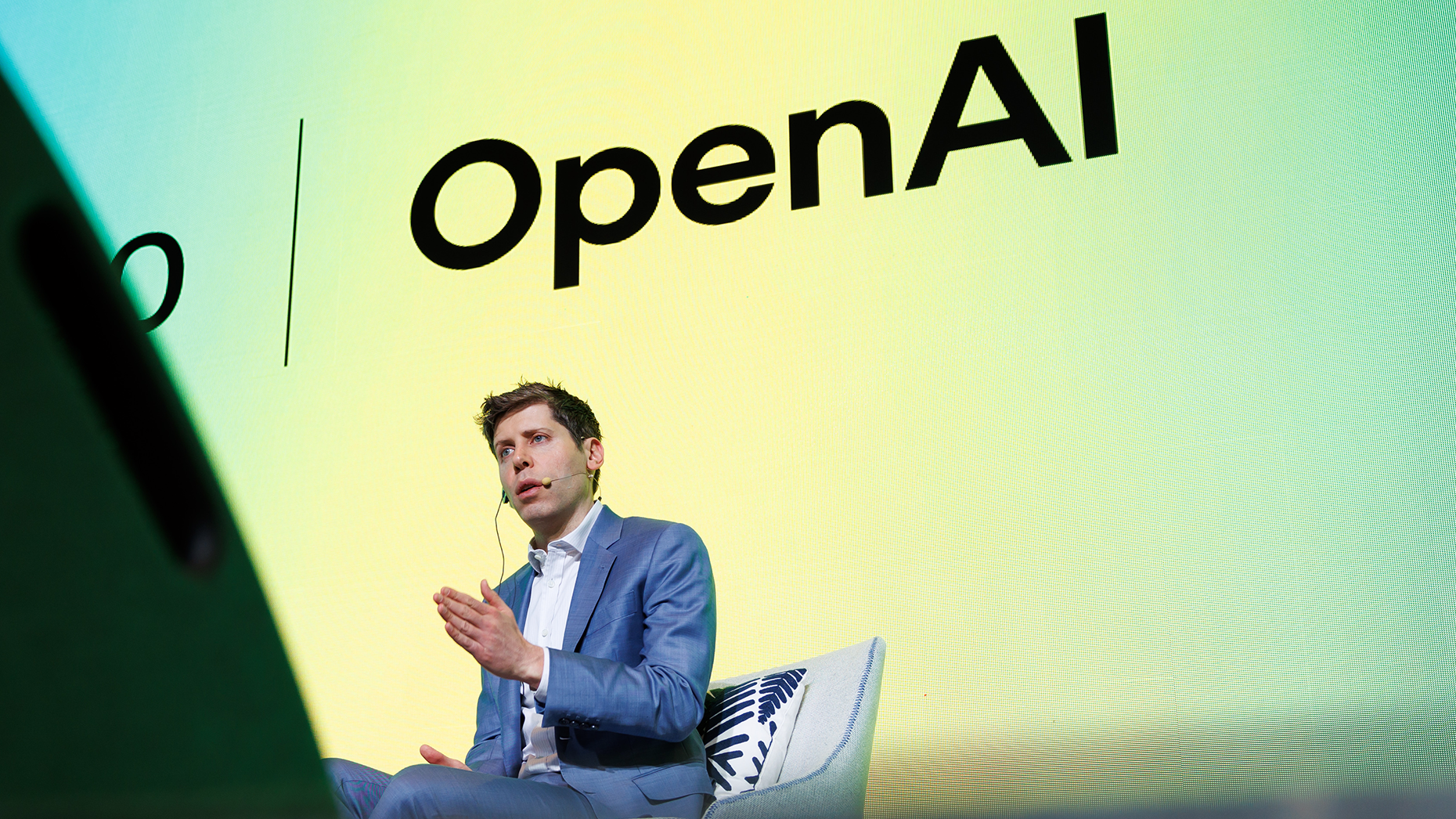

競品環境:長上下文與 Agent 化正在逼近「工作流程」戰場

近期各家都在強化「更長上下文」與「代理(Agent)能力」的敘事。部分媒體報導 OpenAI 的 GPT-5 著重推理切換、多模態與更長上下文,並強調降低幻覺與提升工程測試表現flash.fkdcheg.com;也有文章提到 GPT-6 走向更大上下文與更強的 Agent 整合(但這類資訊常帶行銷口吻,建議以官方公告交叉驗證)techroomage.com。

在這樣的趨勢下,Opus 4.7 的價值判準會更務實:它能否在你既有流程裡,提供更少返工、更少人工複核、以及更高的可控性,而不只是「看起來更聰明」。

導入時最常被忽略的三個風險

- 成本與延遲:旗艦模型通常更貴、更慢。若你要把它放到 CI、客服即時回覆或大量批次處理,務必先算清楚「每次任務成本」與「尖峰延遲」。

- 多模態提示注入(Prompt Injection):圖片裡可能藏指令(例如截圖含惡意文字),導致模型偏離規則。做「系統提示鎖定+輸出驗證+敏感操作需人工確認」會更安全。

- 看似更準,卻更難被發現的錯:推理更流暢時,錯誤也可能更有說服力。建議針對關鍵任務加入「反向驗證」(例如要求列出依據來源、用規則檢查輸出、或用第二模型交叉比對)。

我的觀察:別急著追新,先把「可量化升級」變成你自己的標準

Opus 4.7 是否值得換,取決於你能不能把它放進你的 KPI:

- 如果你在意高風險決策、複雜工單、跨文件比對,推理一致性與指令遵循的提升會比「多答對幾題」更關鍵。

- 如果你在意工程交付,就用測試通過率、修 bug 一次成功率、diff 風險來說話。

- 如果你在意看圖做事(報表、截圖、文件抽取),就把格式合規率與抽取正確率拉到可自動化的門檻。

真正會贏的團隊,不是第一個換模型,而是第一個把模型能力「制度化量測」的人:模型可以換,但你的測試集、你的品質閘門、你的風險控管會留下來,越用越值錢。

追蹤以下平台,獲得最新AI資訊:

Facebook: https://www.facebook.com/drjackeiwong/

Instagram: https://www.instagram.com/drjackeiwong/

Threads: https://www.threads.net/@drjackeiwong/

YouTube: https://www.youtube.com/@drjackeiwong/

Website: https://drjackeiwong.com/