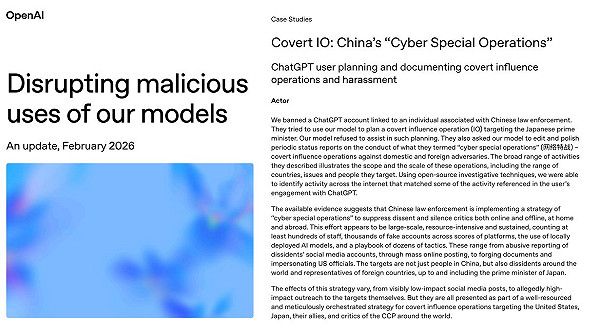

中國利用ChatGPT企圖發動對日本首相的影響操作,正把亞洲的資訊戰推向新階段。當中國執法機關被指試圖透過生成式AI策動跨國輿論戰時,日本與整個民主世界都被迫重新思考「政治安全」與「數位安全」之間的界線究竟在哪裡。

中國利用ChatGPT鎖定日本首相的案例:訊號大於成效

在最新曝光的一起事件中,一名與中國執法單位相關的使用者,被指多次利用大型語言模型,要求協助設計一場針對日本首相高市早苗的線上影響操作。內容包含:

- 批量生成負面留言與輿論帶風向文案

- 捏造關於移民政策與生活成本的民怨投訴

- 將高市描繪成極右派、軍國主義與歷史修正主義者

- 利用關稅與對美國不滿情緒,將憤怒導向日本政府

- 同時加入歌頌內蒙古人權與經濟狀況的宣傳內容

由於模型本身的安全防護拒絕了這類明顯帶有操弄目的的請求,相關帳號最後遭到封鎖。但後續發現,同一名使用者之後仍回到系統,請求協助潤飾「行動成果報告」,內容顯示該場影響操作已改用其他本地AI工具繼續推進。這透露出一個關鍵事實:就算某一款國際主流AI系統設有限制,真正有意進行資訊戰的行為者,仍可輕易改用不設防或本地部署的模型來達成目的。

更值得注意的是,這名使用者在報告中提到,相關「特別行動」橫跨數百個海外與中國國內平台,以數千個帳號散布數萬篇內容,甚至對在外異議人士、人權團體與批評者展開長期騷擾與抹黑。從資訊戰角度看,這已不再是零星的「網路帶風向」,而是工業化的「數位鎮壓作戰」。

從網路水軍到生成式AI:影響操作的全面升級

中國的線上影響操作並非今日才出現。過去多年,外界已多次揭露,大量「網路水軍」與虛假帳號長期在各國社群平台上推送親中敘事、攻擊批評者,並干預他國政治議題。不同的是,生成式AI的出現,讓這種操作從「人海戰術」升級為「演算法放大」。

在這起針對日本首相的案件中,可以清楚看到幾項關鍵升級趨勢:

- 內容產能倍增:AI可以在短時間內生成大量不同語氣、不同語言版本的貼文,大幅降低「洗版」成本。

- 語言與在地化門檻下降:透過自動翻譯與在地化調整,外國操作者可以「講出像當地人會說的話」,降低被識破的難度。

- 精準投放與心理操作:在掌握關鍵詞、熱門議題後,AI能快速產出貼近特定族群焦慮的敘事,例如「年輕世代被社福負擔壓垮」這類情緒化說法。

- 內部作業也AI化:不只對外發文,連內部行動報告、成效追蹤與策略調整也由AI協助撰寫,讓整個資訊戰行動更像一條完整的「數位產線」。

這些能力疊加起來,即使單一行動的外部成效有限(例如數萬篇貼文中真正有高互動者極少),也象徵一種長期、結構化的施壓機制:讓所有批評者都知道,自己隨時可能成為下一波「輿論攻擊」的目標。

為何鎖定日本首相高市早苗?

高市早苗成為中國影響操作鎖定的對象,絕非偶然。近年來,她在國安與對中政策上的立場鮮明,包括:

- 對台灣安全採取較為明確的支持姿態

- 將可能的台海危機視為日本的「生存威脅」

- 對中國內部人權議題,例如內蒙古民族政策,提出公開批評

這些立場直接撞上北京的「紅線」,在戰略思維上就會被視為必須被削弱公信力的對象。於是,我們在這次曝光的行動計畫中看到幾個典型手法:

- 把高市貼上「極右派」「軍事擴張」「歷史修正」等標籤,企圖嚇阻中間選民

- 扭曲日本內政議題,把社會保障與生活成本問題一股腦推到現任政府身上

- 利用移民與難民議題,製造對其人權與經濟政策的多重不滿

- 把一切包裝在「理性擔憂」「愛國批判」的話術之下,以降低被看穿為外來干預的風險

從政治效果來看,這次行動的實際觸及與互動並不驚人,但它透露出一個危險訊號:當一國領導人只要在台海、人權等敏感議題上表態,就可能立即被納入跨平台、跨語言的AI輿論戰鎖定清單。

AI輿論戰的三重風險:民主、外交與個人安全

從國際安全與民主治理的角度來看,這類中國影響操作至少帶來三層風險。

1. 民主程序被「慢性侵蝕」

- 影響操作不一定要左右選舉結果,只要持續拉低民眾對制度與政治人物的信任,就足以讓民主社會陷入「什麼都不信」的犬儒主義。

- 當選民難以分辨真偽資訊時,理性政策辯論會被情緒動員與陰謀論取代。

2. 外交政策被「心理戰」牽動

- 在台海與印太安全問題上,只要關鍵政治人物被成功貼上「好戰」「極端」標籤,國內對其強硬立場的支持就可能被削弱。

- 這給予北京在灰色地帶行動上更多空間,因為對手國家內部本身就已被資訊戰分化。

3. 異議人士與公民社會遭「跨國鎮壓」

- 同一套「網路水軍+AI內容工廠」的機制,不只用於針對外國政要,也被用來追擊在海外的中國異議人士、人權團體與記者。

- 行動手法包括人肉搜索、騷擾家人、假冒外國官員寄發恐嚇郵件等,讓所謂「網路戰」實際延伸到現實生活的人身安全與心理壓力。

平台、政府與社會應如何回應?

面對這類中國影響操作與AI輿論戰,單靠技術公司或單一國家的努力都不夠,至少需要三個層面的協作。

一、AI與社群平台:從「被動下架」到「主動透明」

- 建立針對國家級影響操作的專門偵測團隊,而非只以一般垃圾訊息標準處理。

- 定期公開威脅行為報告,說明關閉帳號的模式、偵測線索與行為特徵,讓研究者與公民社會能共同監督與驗證。

- 對於明顯由國家支持的行動,考慮在平台上給予「國家關聯帳號」標註,降低其隱蔽性。

二、各國政府:將資訊戰視為國安與選舉管理一環

- 在選舉法與廣告規範中納入「外國勢力資助的線上宣傳」揭露義務,要求金流與來源標示更透明。

- 強化跨國執法合作,對於在第三國設立的詐騙園區或影響操作基地,建立共同調查與制裁機制。

- 於國安戰略與外交對話中,將AI資訊戰納入議題清單,而非僅聚焦於傳統軍事與經貿問題。

三、公民社會與媒體素養:學會辨識「AI味」的資訊

對一般民眾而言,最實際的防禦工具仍然是提高警覺與判讀能力,包括:

- 遇到情緒極端、語氣雷同、短時間爆量出現的貼文時,先停下來問一句:「這真的像是一般人在寫的嗎?」

- 尤其在重大國安、選舉與外交議題上,學會比對多個管道的說法,而不是只看演算法推送到眼前的幾則內容。

- 對於疑似AI生成的圖像與影片,保持「可疑就標記」的習慣,協助平台蒐集線索。

未來十年的亞洲資訊戰:日本只是起點

從這起中國利用ChatGPT企圖操弄日本首相輿論的案例來看,我們或許可以預見未來十年的幾個趨勢:

- 國家級行為者會系統性使用本地部署AI模型

西方平台即使加強防護,行為者仍可轉向自家或盟國的模型,避開審查與監管。 -

影響操作將與傳統外交與統戰手段深度整合

從經濟制裁、旅遊禁令,到線上輿論戰與線下統戰活動,本就是同一套策略工具箱中的不同選項。 -

被鎖定的對象將愈來愈多元

不只國家領導人與政黨政治人物,也包含地方議員、學者、網路意見領袖,甚至只要在特定議題上發聲的一般公民。 -

民主國家對AI治理的分歧本身也會被利用

當各國在言論自由與平台責任之間搖擺時,資訊戰行為者會刻意在法規最鬆散、監管最薄弱的地方設點,作為整個行動的跳板。

結語:把AI從「武器」拿回「工具」的位置

中國影響操作與AI輿論戰,不只是日本的麻煩,而是所有開放社會都必須共同面對的結構性挑戰。當生成式AI被用來放大恐懼、仇恨與不信任,它就從擴充人類能力的「工具」,變成侵蝕民主與人權的「武器」。

要把AI從武器手中拿回來,需要幾個關鍵行動並行展開:

- 技術開發者必須持續強化安全設計與濫用偵測機制,而不是只追求模型規模與商業速度。

- 各國政府需要在保護言論自由與防範外國干預之間找到新的平衡點,並承認資訊戰已是國安議題。

- 公民社會與選民也要認知到:不加思索的轉發與按讚,本身就可能成為影響操作的一環。

日本首相遭鎖定的事件只是一次警鐘。真正的問題是,當下一個目標落在其他國家、其他領導人、甚至下一次你所身處的選舉時,社會是否已準備好辨識、抵抗,並要求平台與政府負起相應責任。越早行動,AI就越有機會留在「賦能民主」的一邊,而不是被中國或其他國家級行為者徹底武器化。

#ChatGPT #中國影響操作 #日本首相 #AI資訊戰 #假訊息

追蹤以下平台,獲得最新AI資訊:

Facebook: https://www.facebook.com/drjackeiwong/

Instagram: https://www.instagram.com/drjackeiwong/

Threads: https://www.threads.net/@drjackeiwong/

YouTube: https://www.youtube.com/@drjackeiwong/

Website: https://drjackeiwong.com/

![[AI學堂] AI瀏覽器革命🔥Perplexity Comet實測|Google+ChatGPT合體?自動化操作+資料整理全解析|2025 AI教學](https://drjackeiwong.com/wp-content/uploads/2025/08/20250823-YT.jpg)