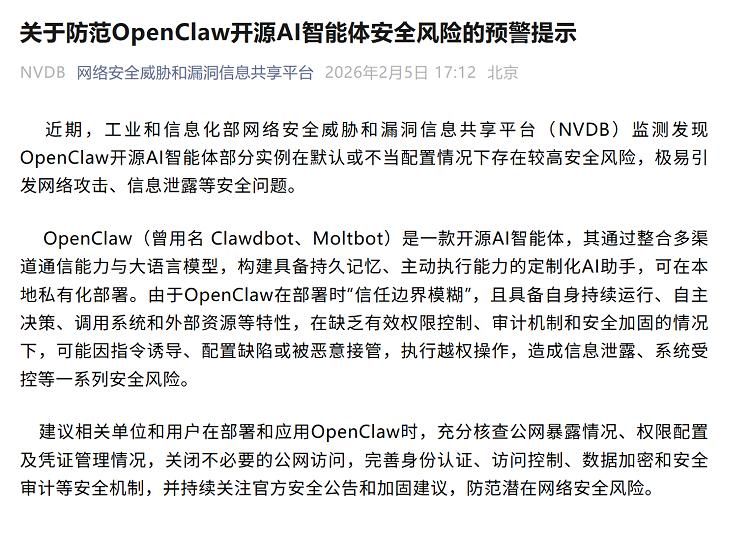

OpenClaw 被警示,問題不只在工具本身

開源 AI 智能體 OpenClaw 近日因配置風險受到官方安全警告,再次提醒市場一件常被低估的事:AI 系統的風險,很多時候不是模型能力本身,而是部署方式、權限設計與周邊元件的安全管理。

對許多企業來說,選擇開源智能體框架的原因很直接:可客製、可私有化、可降低授權成本,還能更快串接內部知識庫、工單系統、CRM、文件平台或自動化流程。不過,正因為這類系統通常需要接觸 API、資料庫、外部工具、執行環境與管理後台,一旦預設設定不當、驗證機制不足,或暴露了不該公開的服務介面,就可能把 AI 從提升效率的助手,變成內網風險的入口。

這次警示的價值,不在於單一專案是否要立刻停用,而在於它點出了當前企業導入 AI 智能體時最現實的盲點:很多團隊重視功能上線速度,卻沒有用同等標準檢查安全邊界。

為什麼 OpenClaw 這類開源智能體特別需要注意配置安全?

OpenClaw 類型的工具通常不只是單純聊天介面,而是具有「代理執行」能力的 AI 系統。它可能具備以下特性:

- 可讀取本地或私有知識庫

- 可呼叫外部 API 與第三方服務

- 可與工作流、自動化平台串接

- 可由管理介面調整模型、工具權限與執行設定

- 可部署在企業內部伺服器或雲端環境

這些能力越強,代表其可觸及的資源越多。若系統管理員在部署時採用預設帳密、未限制管理端口、未妥善設定存取權限,或把測試環境直接暴露到公網,就可能讓外部攻擊者有機會進一步探查系統、取得敏感資訊,甚至利用智能體所串接的工具執行更多動作。

換句話說,風險未必是「OpenClaw 會主動造成問題」,而是部署者是否把它放在一個安全的架構中運行。

私有化部署不是天然安全,反而更考驗治理能力

不少企業一聽到「私有化部署」,直覺會認為比公有雲更安全。這種理解只對了一半。

私有化的確有機會讓資料不離開企業環境,也能更細緻地控制模型、日誌、權限與整合方式。但它並不等於自動安全。實際上,當企業自己接手部署與維運責任後,也等於必須自己承擔:

- 主機與容器安全

- 網路分段與存取控管

- 憑證、金鑰與密碼管理

- 套件版本與漏洞修補

- 日誌稽核與異常偵測

- 外掛、插件與第三方工具的風險

若組織本身缺乏 DevSecOps、資安治理或 AI 平台維運經驗,私有化很可能只是把風險從外部供應商轉移回自己身上,並沒有真正消失。

因此,這次 OpenClaw 的配置風險警示,對企業最重要的啟示不是「開源不能用」,而是開源 AI 要用,就不能只從功能導向出發。

哪些情境最容易踩到雷?

從企業實際導入經驗來看,以下幾種情境最容易形成高風險:

測試環境直接變正式環境

很多團隊先在內部快速架一套 OpenClaw 測試版,原本只是給少數人驗證流程,但後來因為「先能用再說」,逐漸接上正式資料與真實權限。這種情況下,臨時設定往往沒有補齊,卻已經承載了正式用途。

管理介面暴露在外網

若部署時未限制來源 IP、未加上 VPN、零信任驗證或多因素登入,管理後台一旦可被外部掃描到,就可能成為攻擊目標。

工具權限開得過大

AI 智能體若可呼叫 shell、資料庫、內部 API、文件系統或自動化腳本,而系統未對可執行動作做細緻限制,就可能產生權限濫用風險。

金鑰與憑證管理鬆散

不少開發者習慣把 API key、資料庫密碼或雲端存取憑證放在環境變數、設定檔甚至程式碼中。若版本庫、日誌或管理頁面外洩,影響範圍通常不只一個 AI 服務。

忽略開源套件供應鏈風險

OpenClaw 本身即使沒有重大漏洞,周邊依賴套件、容器映像、插件或整合模組也可能成為弱點來源。這是目前開源 AI 生態很常見、但容易被忽略的風險層。

這件事對哪些讀者特別重要?

對企業 IT 與資安團隊

這不是單純的產品新聞,而是內部治理議題。若公司正在導入智能客服、內部知識助理、研發助手或自動化 AI Agent,現在就應盤點部署架構是否存在預設暴露、權限過大或未修補弱點的問題。

對開發團隊與 MLOps/平台工程人員

AI 系統已不再只是模型調參與推論效能的問題。你需要把身份驗證、服務隔離、秘密管理、依賴掃描與版本控管一起納入交付流程。部署 AI Agent,本質上是部署一個能與多系統互動的應用平台。

對中小企業與新創團隊

如果資安資源有限,看到開源工具功能完整、可快速上線,確實很有吸引力。但也正因為資源有限,更要避免在尚未建立基本防護前,就把系統直接接上內部正式資料。否則節省下來的授權費,可能很快會被事故處理成本吞掉。

對顧問、系統整合商與代建服務商

協助客戶部署 AI 智能體時,若只交付可運作的功能,不同步交付安全基線、更新流程與權限設計,後續責任與信任風險都會很高。市場接下來比的不只是「能不能做」,而是「能不能安全地做」。

值得關注的不只是漏洞,還有 AI 智能體的放大效應

傳統資訊系統發生配置錯誤,可能影響的是單一服務;但 AI 智能體的特殊之處,在於它常常扮演多個系統的操作中介。

例如,一個企業內部 Agent 若同時能查知識庫、讀專案文件、發送通知、建立工單、執行自動化任務,那麼一個小小的配置錯誤,可能導致的就不是單點資料外洩,而是多個系統被串連利用。這也是為什麼近來各國監管與資安機構越來越重視 AI 應用層與代理層的安全問題。

更現實的是,很多組織在導入 AI 時,會優先思考「能否取代人力操作」,但越接近取代人工執行,越代表系統需要更高權限。高權限加上低治理,就是智能體時代最危險的組合。

企業現在可以怎麼做?

若你的團隊正在評估或已部署 OpenClaw、AutoGPT 類工具、工作流 Agent 或其他開源智能體平台,以下幾件事值得立即檢查:

- 確認管理介面是否對外暴露:限制來源、加入 VPN 或零信任控管,不要讓後台可被任意掃描。

- 檢查預設設定與帳密:停用預設帳號、強制強密碼與多因素驗證。

- 最小權限設計:讓智能體只拿到完成任務所需的最低權限,不要為了方便一次全開。

- 分離測試與正式環境:避免 POC 原型一路沿用成正式環境。

- 落實秘密管理:把 API key、token、憑證移出程式碼與公開設定檔。

- 建立版本更新與漏洞掃描流程:不只掃主程式,也要掃容器、依賴套件與插件。

- 保留稽核日誌:記錄誰透過智能體執行了什麼操作,方便事後追查。

- 對高風險操作加上人工確認:像是刪除資料、批次寄送、修改設定等,不建議完全自動化。

這些做法看似基礎,卻正是許多 AI 導入專案最容易省略的部分。

這是否代表開源 AI 智能體不值得採用?

未必。開源方案依然有很高的實用價值,尤其對於重視資料主權、客製化能力與成本彈性的企業來說,吸引力仍然很大。

真正的問題從來不是「開源」三個字,而是企業是否把它當成正式生產系統來治理。若團隊具備成熟的部署能力、資安流程與持續維運機制,開源智能體仍可能是極具效率與策略價值的選擇。相反地,如果只因為能快速上線就貿然導入,再好的工具也可能成為隱患。

我的觀察:AI 導入下一階段,安全將從附加題變成必答題

OpenClaw 被提出配置風險警示,表面上看是一次個別事件,但放在更大的產業脈絡裡,它反映的是一個明確趨勢:AI 應用正在從「試用展示」走向「深度連接企業內部系統」。當 AI 不再只是回答問題,而是開始讀資料、調系統、做決策、跑流程,安全治理就不可能留到最後再補。

接下來,企業評估 AI 平台時,應該把安全問題提早到選型階段:

- 是否支援細緻權限控管?

- 是否容易做網路隔離?

- 是否有清楚的更新與修補機制?

- 是否能記錄與追蹤 Agent 行為?

- 是否適合納入現有的資安合規流程?

能回答這些問題的團隊,才比較有機會把 AI 智能體從概念驗證,真正帶進可持續、可擴張、也可被信任的企業環境。

對多數組織而言,這次警示最值得記住的一句話或許是:私有化部署不是安全保證,安全配置才是。

追蹤以下平台,獲得最新AI資訊:

Facebook: https://www.facebook.com/drjackeiwong/

Instagram: https://www.instagram.com/drjackeiwong/

Threads: https://www.threads.net/@drjackeiwong/

YouTube: https://www.youtube.com/@drjackeiwong/

Website: https://drjackeiwong.com/