AI 安全準備正在成為生成式 AI 時代最關鍵的議題之一。當大型模型能力急速提升,企業開始意識到,沒有「AI 安全準備」的治理架構,商業野心隨時可能被安全事件與公關風暴吞噬。 為何 AI 安全準備升級為高階主管職位? 當一家領先的 AI 公司公開對外招募「Head of Preparedness(準備度負責人)」這樣的高階主管時,真正釋放出的訊號是: AI 風險不再只是法遵或研究部門的小題目,而是攸關企業存亡的核心戰略。 這類職位的核心任務,通常涵蓋: 盤點前沿 AI 能力帶來的新型風險 從電腦安全到生物風險建立跨領域風險地圖 持續監測模型是否開始展現自我改進、自我強化等高風險跡象 評估 AI 對使用者心理健康與社會穩定的潛在衝擊...

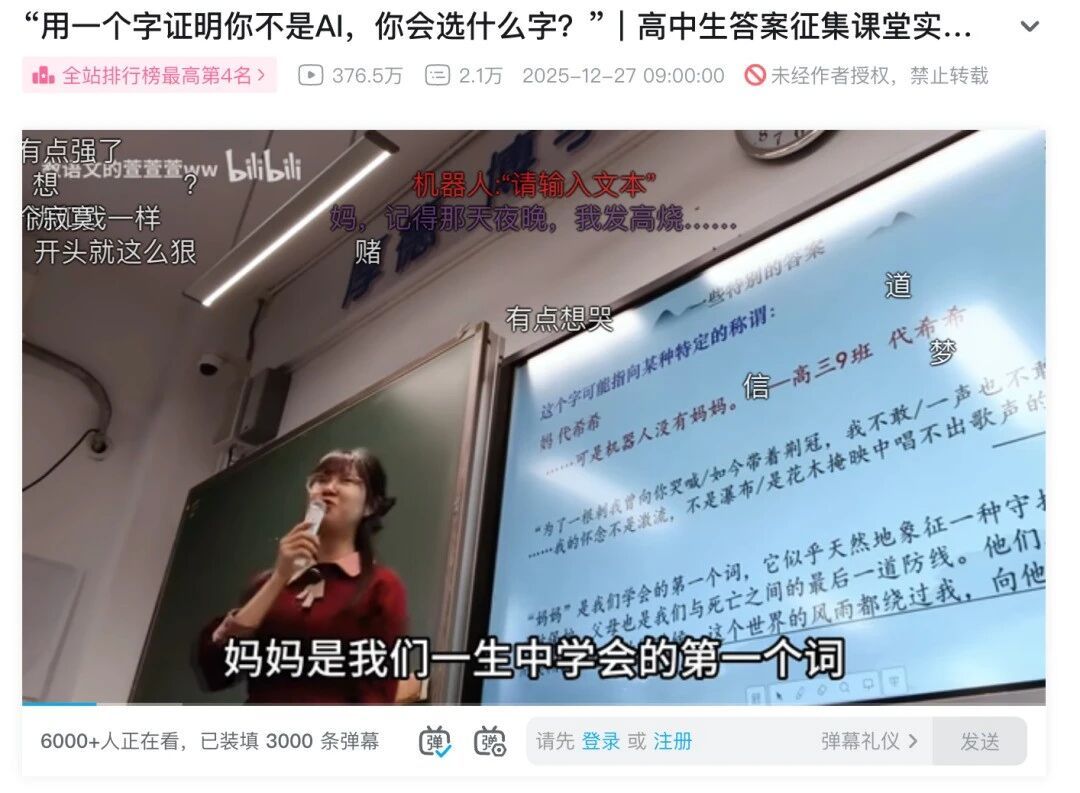

在生成式人工智慧快速滲透的今天,「用一個字證明你不是AI」這樣的提問之所以在網路上流傳,背後其實是我們對人性價值的集體焦慮與追問。當你認真思考要選哪一個字,等於在重新界定:在人與AI之間,什麼才是真正不可被複製的差異。 用一個字證明你不是AI:為何這個提問刺中人心 從語文課、社群平台到各種討論場合,「用一個字證明你不是AI」迅速變成一種時代小測驗。它看似遊戲,卻有幾個關鍵特點: 逼你在最小單位里,濃縮對「人」的理解 不是問專業技能,而是問情感與存在 不是考知識,而是考生命經驗 真正有趣的是,人們給出的字,往往不是「智」「算」「腦」這類和能力相關的詞,而是圍繞情感、關係、時間感與不完美展開。這本身,就是對AI時代最溫柔也最倔強的回應。 人類與AI的差異:不在算力,而在人性的重量 AI可以在幾秒鐘完成寫作、翻譯、繪圖,甚至模仿人的語氣與風格,但它依然缺少幾個關鍵維度: 害怕失去的恐懼 無法預測的情緒起伏 因牽掛而被拉長的時間感 為了毫無功利的理由而停下腳步 當人們試圖用一個字證明自己不是AI時,真正被強調的,往往不是高效,而是那種「明明低效、卻又無可替代」的人性。 「媽」:被守護與面對死亡的勇氣 很多人第一反應會選「媽」這個字,理由看似簡單:AI沒有媽媽。但這個選擇其實指向更深的東西—— 第一個喊出口的稱呼,往往連結著安全感 父母像是一道擋在我們與死亡之間的防線 當那道防線不在,人開始真切面對有限的人生 AI不會在醫院病房門外徹夜守候,不會在父母老去時被迫學會堅強。血緣、依戀、失去,構成了人類情感最深的斷層線,也勾勒出「媽」字背後難以言說的重量。 這種重量,無法用任何演算法訓練出來,只能靠一次次真實的心痛積累。 「急」與「慢」:人類對時間的主觀拉扯 如果要再用一個字證明你不是AI,有人會選「急」。例如: 在醫院等待檢查結果時,每一分鐘都像被拉長...

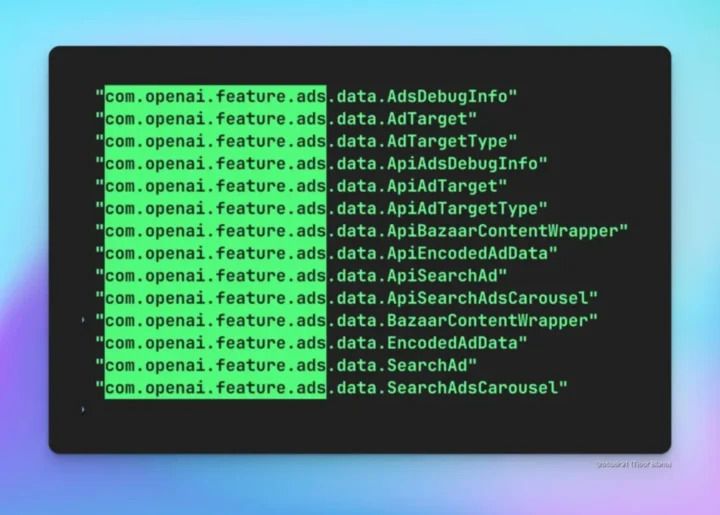

生成式 AI 正在快速滲入搜尋、辦公、購物與娛樂服務,然而真正該被討論的,是「AI 廣告攔截器」何時出現,而不是哪個聊天機器人最聰明。當 AI 廣告與個人化推薦緊密綁在一起,誰能替使用者擋下不透明的商業影響力,將成為 2026 年之後的關鍵議題。 大模型燒錢現實:AI 廣告為何幾乎無可避免? 生成式 AI 看起來像雲端服務,但本質更接近「隨用隨燒」的超級電廠。每一次提問背後,都對應到昂貴的 GPU、龐大的電力與資料中心維護成本。 過去兩年,產業一度相信: – 用戶訂閱制(例如每月固定付費) – 企業 API 計價 可以支撐大多數生成式 AI 的營運。但很快就發現幾個殘酷事實:...

人工智能(AI)已經不再只是工程師或研究人員的專利。無論你是上班族、學生、創作者,甚至只是單純對 AI 感到好奇,2026 年正是入門學 AI 的最好時機。 但問題是:👉 網上 AI 課程那麼多,新手應該從哪裡開始?👉 有沒有 不用寫程式、又免費、又講得清楚 的選擇? 以下精選 8 個真正與 AI 相關、而且適合入門新手的免費課程,涵蓋「AI 概念理解」、「生成式 AI 應用」、「ChatGPT 使用」、「AI 協作工作方式」等實用主題。 1️⃣...

AI 兒少保護的新門檻:ChatGPT 年齡預測 功能代表什麼? ChatGPT 年齡預測 功能的推出,標誌著生成式 AI 進入一個更重視兒少保護的新階段。當聊天機器人越來越像「24 小時不下線的陪伴者」,平台是否有能力分辨對方是 13 歲還是 30 歲,就不再只是產品細節,而是直接關係到未成年用戶的安全與心理健康。 在這樣的背景下,用 AI 來預測使用者年齡,並據此啟動不同強度的內容過濾與安全保護機制,已經成為大型平台不得不面對的現實選擇。 為何生成式 AI 需要「年齡預測」來保護未成年用戶? 生成式 AI 的對話能力愈來愈強,孩子在深夜與 ChatGPT...

OpenAI 認證正成為企業縮短 AI 技能差距的關鍵工具。面對生成式 AI 的爆炸性成長,OpenAI 推出全新的 AI 認證標準與 AI Foundations 認證課程,目標是在 2030 年前為 1,000 萬名美國勞工建立可驗證的 AI 能力,正面迎戰「AI 技能差距」問題。 為何 OpenAI 要用認證來解決 AI 技能差距?...

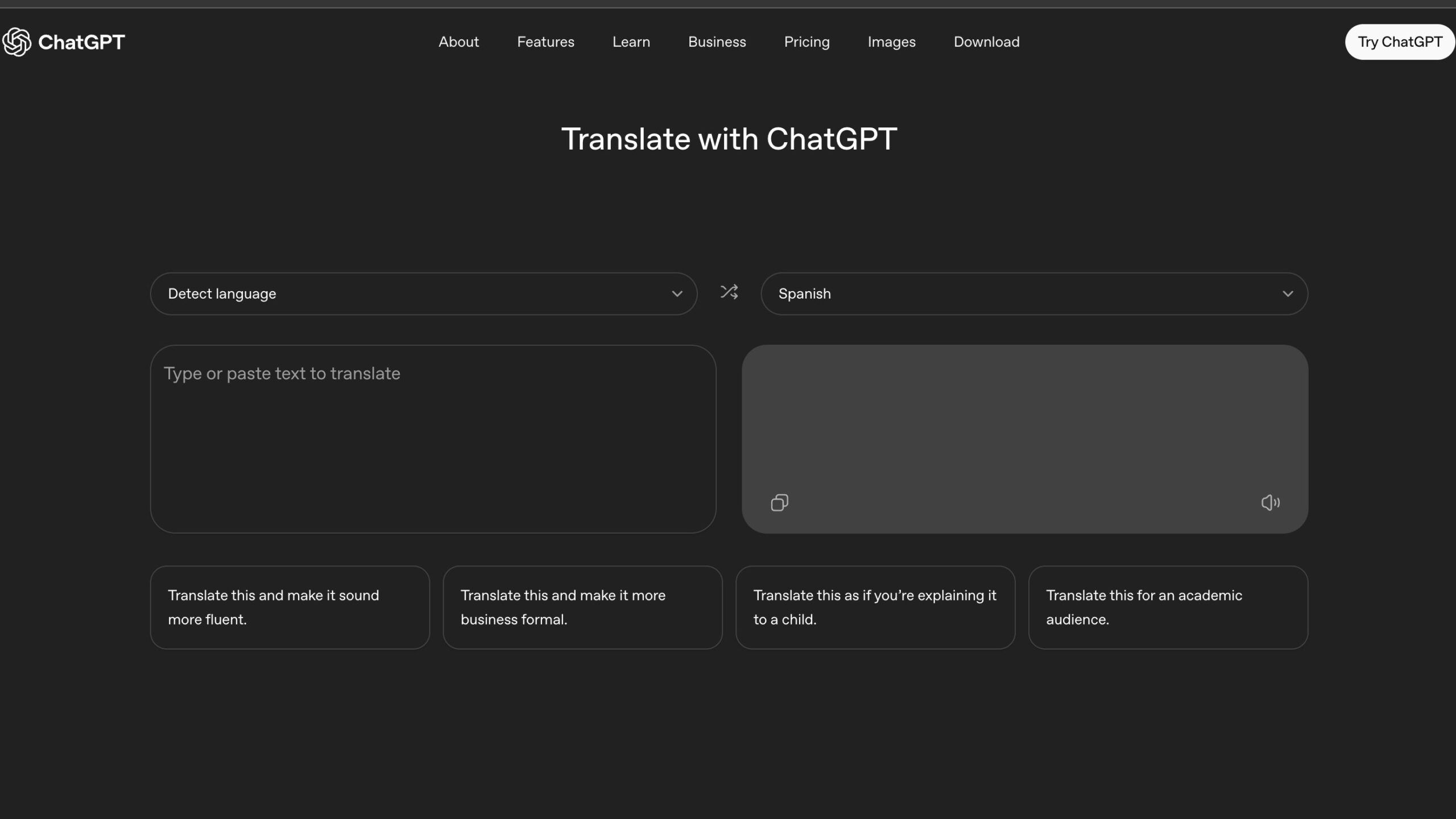

ChatGPT 翻譯正在改寫我們對線上翻譯工具的想像。隨著 ChatGPT Translate 正式成為獨立翻譯服務,它也被清楚地放在與 Google 翻譯正面對決的位置上。 ChatGPT Translate 是什麼?介面與基本功能 從使用者角度看,ChatGPT Translate 極其直覺: 左邊輸入框:輸入或貼上原文 右邊輸出框:顯示目標語言翻譯 自動偵測語言:大多數情況下不需手動選擇來源語言 支援超過 50 種語言的雙向翻譯 在桌面瀏覽器上,目前核心是純文字翻譯;若改用手機瀏覽器開啟,則可直接用麥克風說話,由系統先語音轉文字,再進行翻譯。這些元素都十分「Google 翻譯式」──快速、直接、零門檻。 真正有趣的地方,發生在翻譯完成之後。 與 Google...

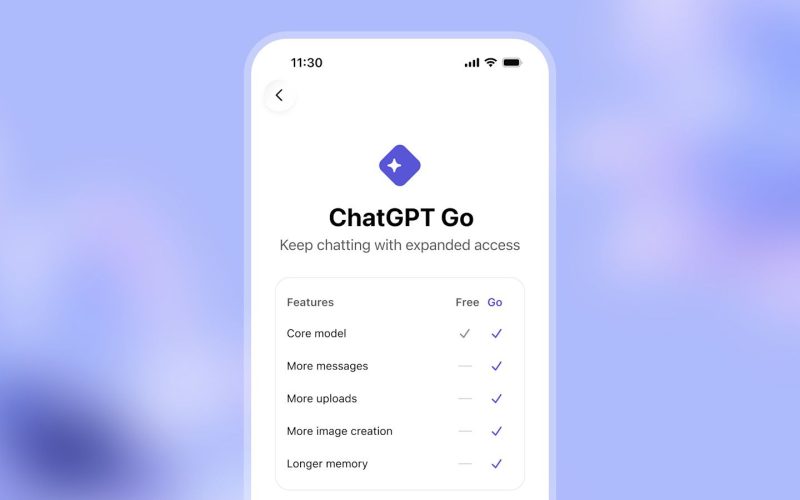

OpenAI 最新推出的 ChatGPT Go 訂閱方案已 全球上線,旨在讓更多用戶以更低成本體驗進階 AI 功能。這對希望提升工作效率、內容創作及學習生產力的你來說,是 2026 年不可忽視的 AI 趨勢。 📌 什麼是 ChatGPT Go? ChatGPT Go 是 OpenAI 推出的 低價付費訂閱方案,定位介於免費版與 Plus(每月約 $20...

背景:AI 工具在教育中的普及與隱憂 近年來人工智能(AI)工具迅速融入教育領域,成為師生日常學習的重要輔助。根據近期調查,超過九成的香港中小學教師與學生都曾使用 AI 工具,當中教師使用比例超過九成,學生更接近全面使用,顯示 AI 已深度滲透教與學過程。不少學生甚至坦言「沒有 AI 就難以完成功課」,可見 AI 在校園裡的重要性。 然而,AI 普及同時也引發教育界的隱憂:許多教師擔心學生過度依賴 AI,導致獨立思考和解難能力退化。本篇將深入分析教師觀點、AI 工具於課堂的應用現況、現行指引、心理與教育理論觀點,以及如何平衡 AI 使用與學生思維能力培養的策略與國際經驗。 教師觀點與憂慮:依賴 AI 削弱學生思維能力? 調查顯示,教育工作者對學生使用 AI 工具抱持審慎態度。超過七成受訪教師直言,學生過度倚賴 AI...

AI 眼鏡在考場作弊的想像,已經不再只是科幻橋段。當一副搭載大型語言模型的 AI 眼鏡,可以在大學期末考中迅速「讀題、解題、出答案」,整個高等教育評量體系都被迫重新審視:我們到底在考什麼,又能否繼續假裝這一切與 AI 無關? AI 眼鏡考試作弊:從技術炫技變成教育痛點 要理解 AI 眼鏡作弊為何衝擊如此巨大,先看清這個裝置的組成並不神祕。典型的 AI 眼鏡通常包含: 內建攝影鏡頭,用來拍攝試卷或螢幕內容 微型顯示螢幕,把 AI 回傳的答案投射到鏡片邊緣 麥克風與喇叭,支援語音輸入與語音提示 與手機或雲端伺服器的持續連線,將影像上傳給大型語言模型推理 在這樣的架構下,一名學生只要低頭看題目,AI 眼鏡就能: 自動截取試題畫面 傳送到後端模型進行理解與推理 於數秒內將解題步驟與答案回傳到鏡片顯示...

德國慕尼黑地方法院在2025年11月11日作出一項備受矚目的判決,裁定OpenAI在未經授權的情況下,使用受版權保護的德國歌曲歌詞訓練其生成式AI模型ChatGPT,構成對版權法的侵犯。這項判決被視為歐洲首宗直接針對AI訓練與輸出內容的版權爭議案,為AI產業與版權持有者之間的法律界線帶來明確指引,也預示未來AI公司在歐洲市場的合規策略將面臨重大挑戰。 案件由德國主要音樂版權集體管理組織GEMA提出,指控OpenAI在訓練ChatGPT時,使用了包括「Atemlos」和「Wie schön, dass du geboren bist」等九首知名德國歌曲的歌詞。GEMA指出,只要使用者輸入簡單提示,ChatGPT便能完整輸出這些受保護的歌詞,顯示模型已將這些內容「記憶」並儲存於其參數之中。法院在審理後,認定這種「記憶化」(memorisation)行為已構成《德國著作權法》(UrhG)第16條所定義的「重製」行為,即使歌詞並非以傳統檔案形式儲存,而是以模型內部的統計參數呈現,仍屬於版權法規範範圍。 法院進一步指出,當ChatGPT將這些歌詞輸出給使用者時,屬於透過網路向公眾提供作品,構成《德國著作權法》第19a條及《歐盟資訊社會指令》(InfoSoc Directive)第3條所定義的「公開傳播」行為。這意味著,AI模型不僅在訓練階段可能涉及版權問題,其後續的輸出行為同樣需要取得授權。 在判決中,法院也明確駁回OpenAI主張的「文本與數據挖掘例外」(text-and-data-mining exception,TDM exception)適用性。根據德國《著作權法》第44b條,TDM例外僅允許為分析目的而製作的準備性複製,但一旦模型能重現受保護作品的實質內容,且影響權利人的合法經濟利益,便超出例外範圍。法院強調,AI模型的記憶與輸出行為已干擾權利人的商業利益,因此不能援引TDM例外作為免責依據。 此外,法院也拒絕OpenAI將責任歸咎於使用者的論點,認為AI平台營運商在模型架構與資料集選擇上具有主導權,應負起主要責任。判決結果包括要求OpenAI停止在德國境內儲存未經授權的德國歌詞,並須在當地報紙刊登判決內容,同時承認GEMA有權求償損害賠償或授權費用。雖然具體賠償金額尚未公布,但外界預期可能達到相當高的水準。 這項判決對AI產業的影響深遠。首先,它明確將AI模型的「記憶化」行為納入版權法規範,提高AI公司在資料來源與模型訓練上的合規門檻。其次,它強化了版權持有者在歐洲的執法能力,未來AI公司若想在歐洲市場營運,必須更嚴格審查訓練資料,並積極與版權集體管理組織協商授權。此外,判決也促使AI公司加強技術防護,例如去重複化(deduplication)、正規化(regularisation)、針對性防記憶技術,以及強化提示與輸出過濾機制,特別是針對短篇作品如歌詞與詩歌。 對於GEMA與其他版權集體管理組織而言,這項判決提供了雙重執法工具:不僅可針對訓練階段的記憶化行為提出主張,也能針對模型輸出的侵權內容進行追訴。然而,由於OpenAI已公開表示不認同判決結果,並考慮提出上訴,未來法律爭議仍可能持續,相關判例的發展值得持續關注。 總體而言,這項判決不僅是德國版權法的里程碑,也為歐洲乃至全球AI與版權的平衡帶來新的思考方向。AI公司必須重新評估其資料來源與模型設計,而版權持有者則獲得更強的法律武器,以保護其創作成果。 #OpenAI #GEMA #版權法 #AI訓練 #生成式AI

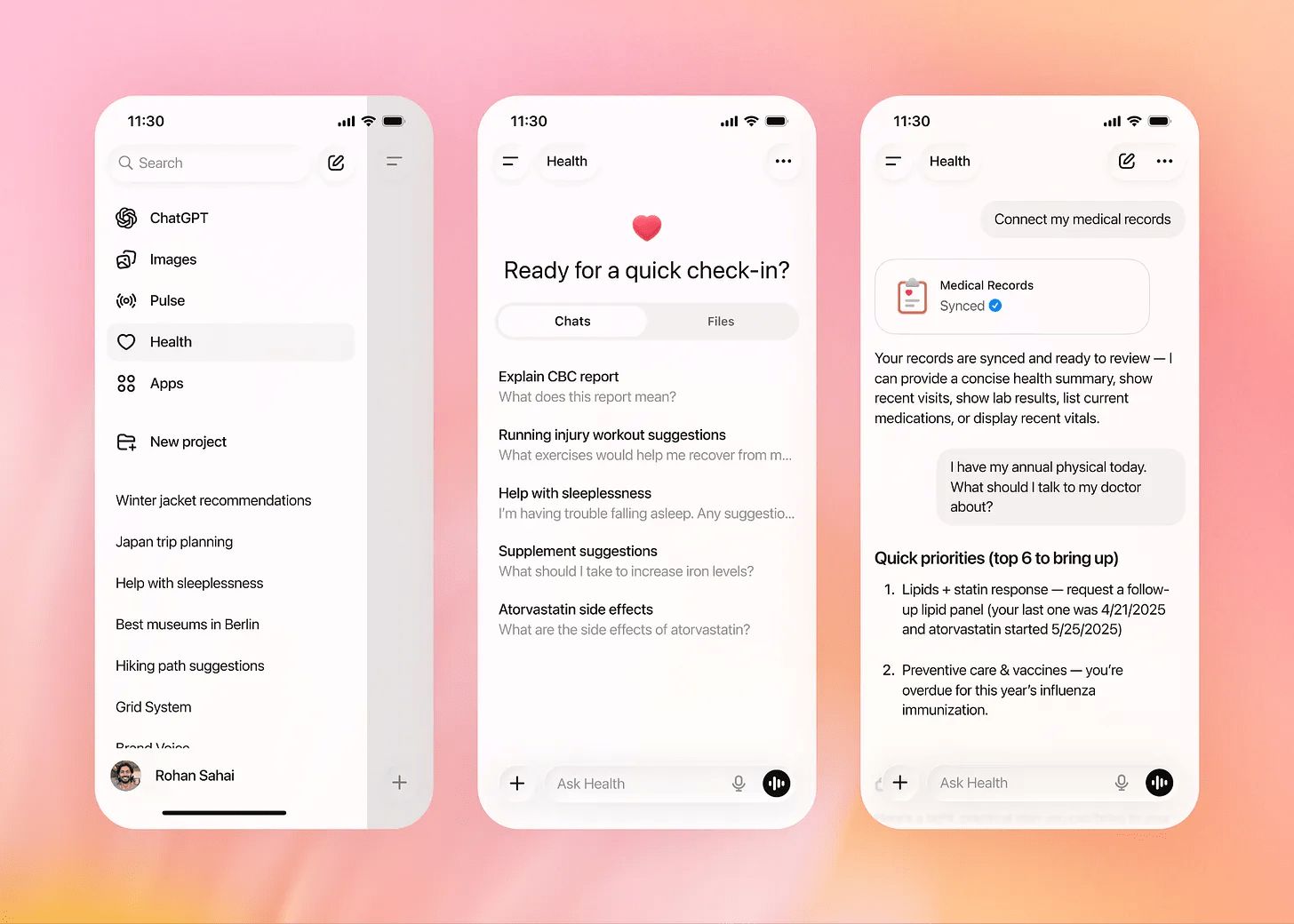

生成式 AI 正在快速改變我們獲取健康資訊的方式,而「ChatGPT Health」正是這股浪潮中最受矚目的新產品之一。對於已經習慣向聊天機器人詢問症狀、飲食與運動建議的使用者而言,ChatGPT Health 象徵著一個更專注於健康諮詢的 AI 空間,有望重塑大眾與醫療體系的互動模式。根據產品方說法,目前每週已有約 2.3 億名使用者向該平台詢問健康與保健相關問題,足以顯示需求的龐大與急迫。 為何會出現專門的 ChatGPT Health? 長期以來,多數人面對健康困惑時的路徑,大致是: 先上網搜尋症狀 在眾多互相矛盾的資訊中焦慮加劇 若情況許可,才進一步預約門診 這樣的模式有幾個結構性問題: 醫療資源分布不均,偏鄉與弱勢族群更難就醫 門診時間有限,醫師難以充分回答所有生活與保健問題 診與診之間缺乏延續性,病人常在漫長空窗期自行上網「拼湊」答案 生成式 AI 聊天機器人被大量用於健康諮詢,正是因為它填補了資訊與情緒上的空缺:任何時間都能問、回應具對話感、又比搜尋結果更具結構。然而,當所有主題的對話都混在同一個聊天歷史中,健康資訊的隱私、情境與專注度,都難以獲得妥善處理。...