「離線跑 AI」這件事,近一年從極客玩具快速變成企業與個人都在關注的部署選項。若你看到「Google Gemma 4 正式登場」的消息(以下以 Gemma 4 作為新一代 Gemma 系列的稱呼),最值得關注的其實不只是模型變強,而是它代表 Google 也把可在本機/邊緣裝置運行的生成式 AI推到更前線:不依賴雲端、降低成本、縮短延遲,並把更多資料留在使用者端。 為什麼「離線 AI」突然變成剛需? 過去多數生成式 AI 都以雲端 API 為主:好處是省掉硬體與維運,壞處是費用不可控、延遲與速率受限,還要面對資料出境與合規稽核。 離線(或半離線、私有化)部署之所以受到追捧,通常出於三個現實因素: 隱私與合規壓力:客服對話、內部文件、醫療或金融資料一旦上雲,就會牽涉資安政策、個資告知、資料保存與跨境傳輸等議題。 成本結構改變:API 用量一上去,長期費用可能比買一台有...

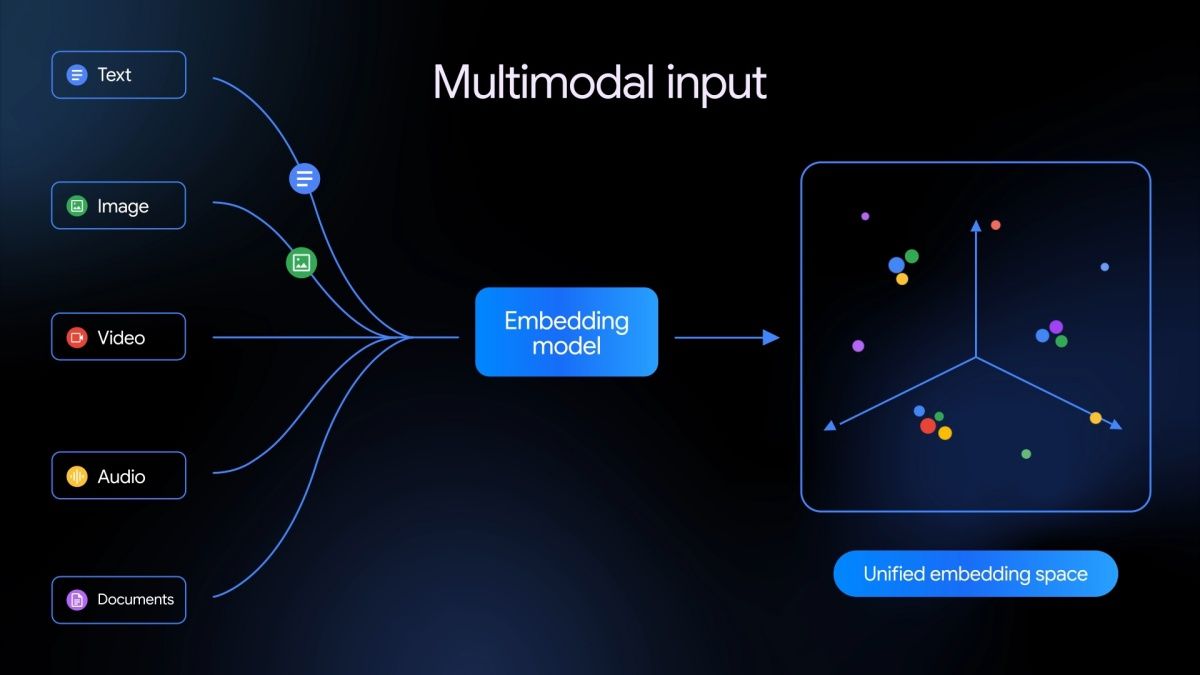

Gemini Embedding 2 的關鍵:把「看得懂」變成可搜尋、可比對、可檢索 Google 發佈 Gemini Embedding 2,主打「原生多模態嵌入(multimodal embeddings)」與「跨語言語義對齊」。如果你平常接觸的是生成式 AI(寫文、摘要、對話),嵌入模型看起來像配角;但在企業實務裡,嵌入往往才是把內容變成「可被系統使用」的核心。 嵌入的本質,是把文字、圖片或影音內容轉成向量(vector),讓系統能用「距離/相似度」做:搜尋、分類、推薦、去重、聚類、RAG 檢索等。而 Gemini Embedding 2 的賣點在於:它不只把多種資料型態塞進同一套向量空間,還強調能跨語言對齊語義,讓「中文描述找英文影片」、「用日文查到圖片」這類需求更接近可用。 為什麼「原生多模態」比「先轉文字再嵌入」重要? 過去常見做法是: – 圖片先跑 OCR 或 caption(產生文字描述)...

Google 推出 Gemini 3.1 Flash Live,主打更自然的即時語音互動,並強調對話能「接得住」——不只是把你說的話轉成文字再回答,而是更像人與人交談:能跟上語氣與上下文、在多輪對話裡延續思路,減少前後不一致或突然跳題的狀況。 這種「Live」型語音能力之所以值得關注,關鍵在於它把生成式 AI 從「你問我答」推向「共同完成一件事」。當回應延遲更低、對話銜接更順,AI 才可能成為真正可用的語音助理,而不是只有在展示時好看、實際使用卻容易打斷你的工具。 更自然的背後:不是更會講話,而是更會「跟你一起走」 過去許多語音機器人最大的問題,往往不是語音辨識不準,而是對話狀態管理: 你講到一半改口,系統容易把前後當成兩個任務 你用「那個、剛剛說的」這類指涉詞,AI 無法穩定追到同一個主題 你要它先記住條件、再一步步推進,結果中途忘記先前結論 Gemini 3.1 Flash Live 如果能更好地延續脈絡,就代表它在「多輪對話的持續理解」與「回覆節奏」上更接近人類對話:你不需要每句話都重新下指令,對話成本會明顯下降。 哪些情境最先受益?三類「需要連續性」的語音工作流 這類模型最有價值的地方,通常不是閒聊,而是連續任務: 1)...

Google Nano Banana Pro 是 2025 年最受注目的 AI 圖像生成工具,支援 4K 超高清輸出、多圖融合、文字渲染,而今集我會以「真實工作室改造」作為示範,帶你一步步測試它的準繩度與生成能力。無論你係新手定創作者,都可以跟住今集學識點樣用 Nano Banana Pro 做出 專業級背景設計。 在影片中,我會展示整個改造過程:由輸入原始背景、調整櫃位、重新擺設、加燈光效果,到最後生成完整的工作室佈景。今集亦會分享 使用 Nano Banana Pro 時最常見嘅錯誤、調 Prompt 技巧、如何應付生成不準確,務求讓你學識最實用嘅操作方法。(廣東話教學)...

![[AI學堂] Google Nano Banana Pro 實測|AI 改造工作室,新手都做到專業級效果(廣東話教學 2025)](https://drjackeiwong.com/wp-content/uploads/2025/11/20251125-YT.jpg)