Anthropic 推出 Claude Opus 4.7,把重點放在「更可靠地完成複雜任務」:推理、編碼、視覺理解與指令遵循都宣稱再進化。對企業與開發團隊來說,最重要的不是口號,而是:你能不能用可量化的方式,驗證它真的更好用、且更好控。 在 Opus 4.7 之前,Anthropic 已經用 Claude 3.7 Sonnet 打出「混合推理」與更強的工程協作(例如可在 API 控制思考時間、以及終端機導向的 Claude Code)這條路線,並在 SWE-bench 等測試上獲得相當亮眼的成績與討論度(例如報導提到 SWE-bench 70.3%)developer.cloud.tencent.com。Opus 4.7 若定位在更高階的旗艦能力,接下來就該用更嚴格的...

Meta 推出全新多模態 AI 模型「Muse Spark」,並宣告將能力直接帶進 Instagram(IG)與 Facebook(FB)。這不是單純「多一個聊天機器人」而已,而是把生成式 AI 放進你每天用來做內容、投放廣告、經營社群與客服的工作流裡——當 AI 變成平台的內建功能,影響會比外掛工具更快、更廣。 Muse Spark 到底「多模態」在哪裡? 多模態的核心,是同一套模型能同時理解與生成多種內容形式(常見包含文字、圖片,有些也會延伸到影音與聲音)。放在社群平台場景,代表它不只會「寫文案」,也能: 讀懂你上傳的圖片/素材,協助產出貼文說明、標籤、主題建議 依照品牌語氣與目標受眾,生成不同版本的標題、CTA、短文案 將長內容濃縮成 Reels/短影片的腳本與分鏡要點 在訊息與留言情境下,提供更貼近脈絡的回覆建議(客服、社群小編) 這類能力的關鍵不只在「生成」,而在「理解平台語境」:IG 的內容節奏、FB 的社團互動、留言區的語氣,都比一般聊天式 AI...

微軟近期正式宣布自家 文字、語音、影像 三種核心 AI 模型同步上線,等於把「能寫、能聽說、能看」的能力一次補齊。對一般使用者而言,這可能只是 Copilot 類工具變得更好用;但對企業與開發者來說,重點在於:同一家供應商、同一套雲端治理與資安框架下,開始能更完整地做多模態(multimodal)應用,從客服到內容製作、從資料整理到行銷素材生成,都更容易串起來。 三種模型同時上線,訊號比功能更重要 單看功能,文字生成、語音辨識/合成、影像生成市場早已競爭激烈;但「三件事一起上線」的意義在於產品策略: 平台整合:如果文字、語音、影像都能在同一平台呼叫(例如同一雲端 API、同一套金鑰與權限控管),企業導入成本會明顯下降。 流程串接:很多需求不是單一模型能完成,而是「文字 → 圖像 → 旁白/配音 → 上架」的內容流水線,或「語音來電 → 轉文字 → 摘要 → 回覆」的客服閉環。...

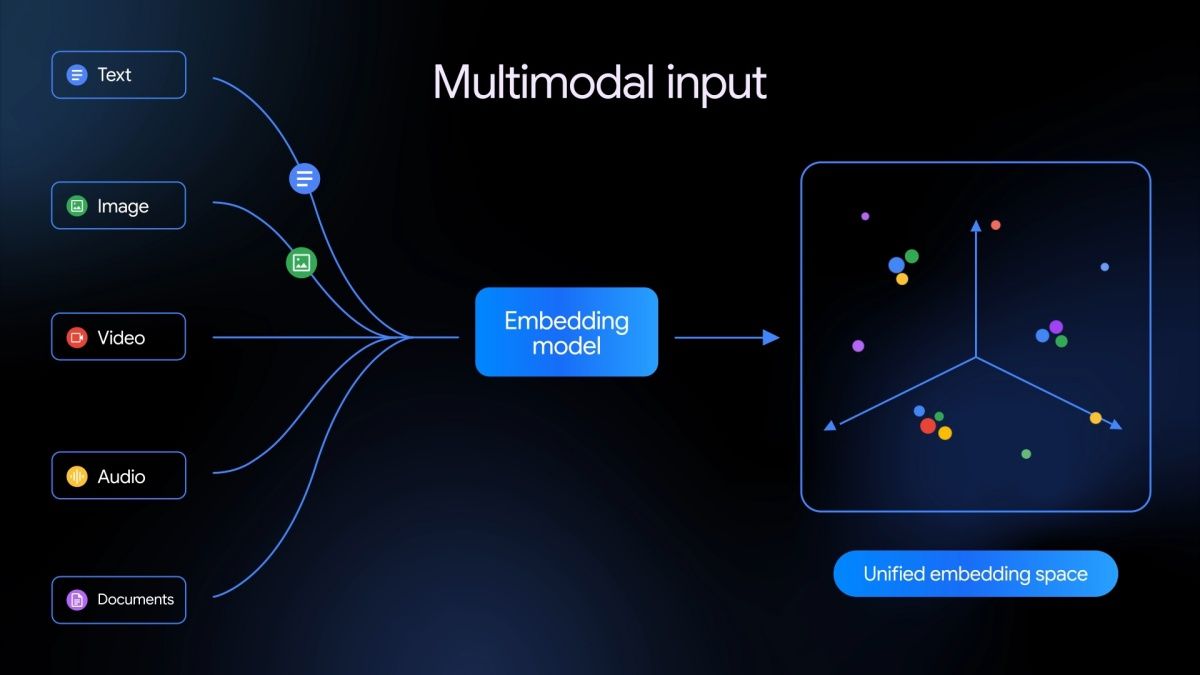

Gemini Embedding 2 的關鍵:把「看得懂」變成可搜尋、可比對、可檢索 Google 發佈 Gemini Embedding 2,主打「原生多模態嵌入(multimodal embeddings)」與「跨語言語義對齊」。如果你平常接觸的是生成式 AI(寫文、摘要、對話),嵌入模型看起來像配角;但在企業實務裡,嵌入往往才是把內容變成「可被系統使用」的核心。 嵌入的本質,是把文字、圖片或影音內容轉成向量(vector),讓系統能用「距離/相似度」做:搜尋、分類、推薦、去重、聚類、RAG 檢索等。而 Gemini Embedding 2 的賣點在於:它不只把多種資料型態塞進同一套向量空間,還強調能跨語言對齊語義,讓「中文描述找英文影片」、「用日文查到圖片」這類需求更接近可用。 為什麼「原生多模態」比「先轉文字再嵌入」重要? 過去常見做法是: – 圖片先跑 OCR 或 caption(產生文字描述)...

文心 5.0 正式版在「規格」之外,真正值得看的是什麼? 百度發布文心 5.0 正式版,最吸睛的兩個關鍵字是「2.4 萬億參數」與「原生全模態」,再加上官方宣稱其「工具呼叫能力」在測試中超越 GPT-5 早期版本。對一般讀者來說,這些名詞很像競賽榜單;對開發者與企業而言,真正關心的是:它能不能更穩、更便宜、更好整合到現有流程,並在合規與資料安全上更可控。 這篇文章不只整理亮點,也會把「哪些地方可能被過度解讀」講清楚,讓你判斷文心 5.0 到底適不適合導入。 2.4 萬億參數:更大不一定等於更好,但代表「資源與上限」 「參數量」常被拿來當成模型強弱的直覺指標,但它更像是天花板:代表模型可能有更高的表達能力與泛化空間。實務上,效能還取決於: 訓練資料品質與多樣性(以及是否含足夠高品質的推理樣本) 訓練方法(對齊、RL、蒸餾、長上下文等策略) 推論成本與延遲(實際可用的吞吐量) 產品化程度(工具呼叫穩定度、錯誤處理、權限控管) 因此,2.4 萬億參數比較合理的解讀是:百度願意投入更大的訓練與算力資源,模型上限更高;但你仍需要用自身情境做 POC(概念驗證),不要只看規格就下結論。 「原生全模態」帶來的改變:不是多加一個影像入口而已 多模態模型很多,但「原生全模態」通常指的是:模型在架構與訓練流程上,就把文字、圖片、語音/聲音等多種訊號放在同一套理解與生成框架下,而不是外掛式把影像轉文字再丟回文字模型。...